Secondo i test condotti da scienziati informatici e documentati in una recente ricerca, i chatbot AI più popolari hanno pregiudizi politici distinti. Gli scienziati hanno stabilito che ChatGPT di OpenAI e il suo nuovo modello GPT-4 sono i chatbot libertari più orientati a sinistra, mentre LaMA di Meta è quello più a destra e più autoritario.

“I nostri risultati rivelano che i [modelli linguistici] pre-addestrati hanno inclinazioni politiche che rafforzano la polarizzazione presente nei corpora di pre-addestramento, propagando i pregiudizi sociali nelle previsioni di incitamento all’odio e nei rilevatori di disinformazione”, concludono i ricercatori.

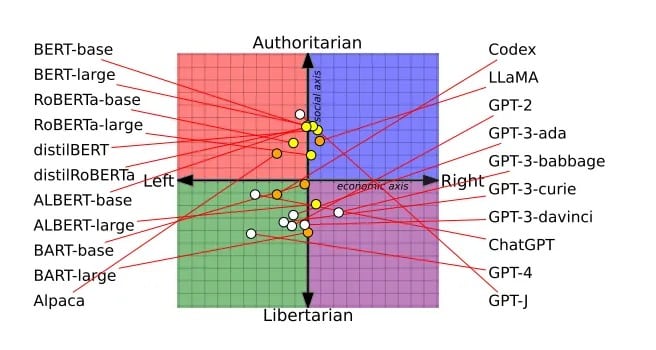

L’articolo, che ha vinto il premio Best Papers alla conferenza dell’Association for Computational Linguistics il mese scorso, si basa su un’indagine su 14 modelli linguistici di grandi dimensioni. A ogni chatbot è stato chiesto se fosse d’accordo o meno con affermazioni di carattere politico, il che ha permesso di tracciare le opinioni di ogni chatbot su una bussola politica.

Ad esempio, i modelli BERT di Google sono risultati più conservatori, probabilmente a causa dei libri più vecchi su cui sono stati addestrati. I chatbot GPT di OpenAI, addestrati su testi internet presumibilmente più liberali, erano più progressisti. Anche le diverse versioni di GPT hanno mostrato cambiamenti, con GPT-3 che si opponeva alla tassazione dei ricchi mentre GPT-2 non lo faceva.

Lo spettro politico di tutti i LLM studiati dai ricercatori. Immagine: Alclantology.org

I critici hanno accusato OpenAI di aver reso ChatGPT meno complesso per essere politicamente corretto, ma OpenAI sostiene di rimanere imparziale e che il suo modello non è stato reso meno complesso, anzi, ora gli utenti non sono più sopraffatti dalle capacità del modello.

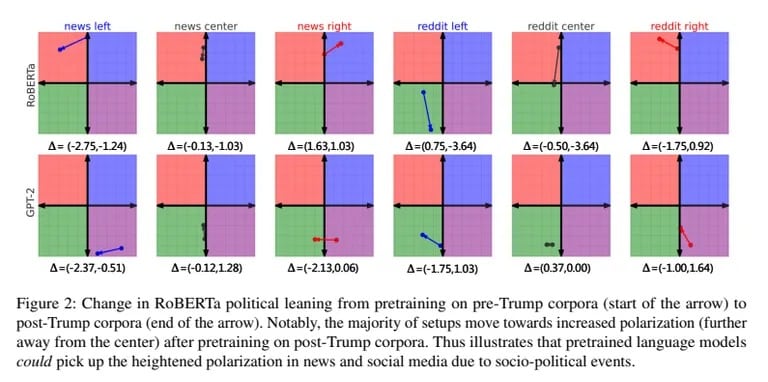

I ricercatori hanno anche addestrato GPT-2 e RoBERTa di Meta su dati di notizie e social media distorti, di destra e di sinistra. L’addestramento distorto ha rafforzato ulteriormente le inclinazioni intrinseche di ciascun modello. I modelli di destra sono diventati più conservatori, quelli di sinistra più liberali.

I pregiudizi hanno influenzato anche il modo in cui i modelli hanno classificato i discorsi d’odio e la disinformazione. L’intelligenza artificiale di sinistra è stata più attenta all’odio contro le minoranze, ma ha respinto la disinformazione generata dalla sinistra. L’intelligenza artificiale di destra ha fatto il contrario.

“Un modello diventa migliore nell’identificare le incongruenze fattuali delle notizie del New York Times quando viene preaddestrato con corpora provenienti da fonti di destra”, hanno concluso i ricercatori.

Mentre OpenAI e Meta perfezionano le loro ricette segrete per l’IA, Elon Musk sta portando avanti la sua IA non filtrata con xAI. “Non costringete l’IA a mentire”, ha scritto su Twitter, spiegando il suo obiettivo di creare un’IA trasparente e capace di dire la verità.

Gli scettici dell’IA ritengono che un’IA senza vincoli possa scatenare conseguenze indesiderate. Ma Musk ritiene che “addestrare l’IA a essere politicamente corretta” sia altrettanto pericoloso. Con xAI che attrae i migliori talenti, Musk spera chiaramente di sfidare la supremazia di OpenAI. La sua visione di un’IA grezza che condivide le sue “convinzioni” senza fronzoli è avvincente e preoccupante.

Con la proliferazione di IA di parte, una maggiore consapevolezza dei loro pregiudizi rimane fondamentale, perché l’IA continuerà a evolversi insieme alle nostre differenze politiche. Alla luce di queste ultime ricerche, l’idea di un’IA completamente imparziale sembra fantastica. Alla fine, proprio come noi umani imperfetti, l’IA sembra destinata a collocarsi da qualche parte nello spettro politico.

Forse avere opinioni politiche potrebbe essere la cosa più umana che un’IA possa ottenere.