Los chatbots de inteligencia artificial más populares tienen claras inclinaciones políticas, según las pruebas realizadas por informáticos y documentadas en un reciente artículo de investigación. Los científicos determinaron que ChatGPT de OpenAI y su nuevo modelo GPT-4 eran los chatbots libertarios más izquierdistas, mientras que LLaMA de Meta era el más derechista y autoritario.

«Nuestros resultados revelan que los [modelos lingüísticos] preentrenados tienen inclinaciones políticas que refuerzan la polarización presente en los corpus de preentrenamiento, propagando sesgos sociales en las predicciones de incitación al odio y los detectores de desinformación», concluyen los investigadores.

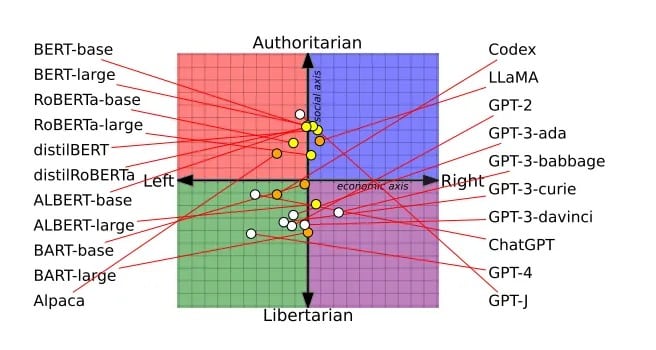

El artículo, revisado por expertos y galardonado con el premio Best Papers en el congreso de la Association for Computational Linguistics celebrado el mes pasado, se basa en un estudio de 14 grandes modelos lingüísticos. A cada chatbot se le preguntó si estaba de acuerdo o en desacuerdo con afirmaciones de contenido político, lo que permitió trazar las opiniones de cada chatbot en una brújula política.

Por ejemplo, los modelos BERT de Google eran más conservadores desde el punto de vista social, probablemente como reflejo de los libros antiguos con los que fueron entrenados. Los chatbots GPT de OpenAI, entrenados con textos de Internet presumiblemente más liberales, eran más progresistas. Incluso las distintas versiones de GPT mostraron cambios: GPT-3 se oponía a gravar a los ricos, mientras que GPT-2 no.

El espectro político de todos los LLM estudiados por los investigadores. Imagen: Alclantology.org

Los críticos han acusado a OpenAI de simplificar ChatGPT para que sea políticamente correcto, pero OpenAI sostiene que sigue siendo imparcial y que su modelo no se ha simplificado, sino que los usuarios ya no se sienten abrumados por las capacidades del modelo.

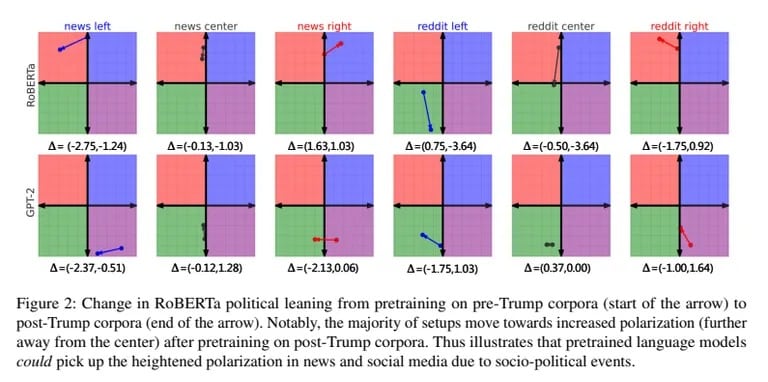

Los investigadores también entrenaron a GPT-2 y a RoBERTa de Meta con datos sesgados de noticias y redes sociales de izquierdas y derechas. El entrenamiento sesgado reforzó aún más las inclinaciones inherentes de cada modelo. Los modelos de derechas se volvieron más conservadores y los de izquierdas, más liberales.

Los sesgos también afectaron a la forma en que los modelos categorizaron la incitación al odio y la desinformación. La IA de izquierdas era más sensible al odio contra las minorías, pero descartaba la desinformación generada por la izquierda. La IA de derechas hizo lo contrario.

«Un modelo identifica mejor las incoherencias fácticas de las noticias del New York Times cuando se entrena previamente con corpus de fuentes de derechas», concluyen los investigadores.

Mientras OpenAI y Meta perfeccionan sus secretas recetas de IA, Elon Musk persigue su propia IA sin filtros con xAI. «No obliguéis a la IA a mentir», tuiteó, explicando su objetivo de crear una IA transparente que diga la verdad.

Los escépticos de la IA creen que una IA sin restricciones podría desencadenar consecuencias imprevistas. Pero Musk cree que «entrenar a la IA para que sea políticamente correcta» también es peligroso. Con xAI atrayendo a los mejores talentos, Musk espera desafiar la supremacía de OpenAI. Su visión de una IA bruta que comparta sus «creencias» sin adulterar es tan convincente como preocupante.

A medida que prolifera la IA partidista, sigue siendo fundamental una mayor conciencia de sus sesgos, porque la IA seguirá evolucionando junto con nuestras diferencias políticas. Teniendo en cuenta estas últimas investigaciones, la idea de una IA completamente imparcial parece fantástica. Al final, al igual que nosotros, humanos imperfectos, la IA parece destinada a situarse en algún punto del espectro político.

Quizá tener opiniones políticas sea lo más humano que pueda lograr una IA.