Questa settimana Nvidia ha mostrato i suoi muscoli per l’intelligenza artificiale, presentando una serie di prodotti di nuova generazione per inaugurare la nuova era dell’intelligenza artificiale. Da quello che ha descritto come un superchip rivoluzionario incentrato sull’AI a strumenti di sviluppo più intuitivi, Nvidia intende chiaramente rimanere il motore della rivoluzione dell’AI.

La presentazione di Nvidia di quest’anno al SIGGRAPH 2023 – una conferenza annuale dedicata alla tecnologia e alla ricerca sulla grafica computerizzata – è stata quasi interamente dedicata all’IA. Jensen Huang, CEO di Nvidia, ha affermato che l’IA generativa rappresenta un punto di inflessione simile alla rivoluzione di Internet di decenni fa. Ha affermato che il mondo si sta muovendo verso una nuova era in cui la maggior parte delle interazioni tra uomo e computer sarà alimentata dall’IA.

“Ogni singola applicazione, ogni singolo database, qualsiasi cosa con cui si interagisce all’interno di un computer, probabilmente sarà prima impegnata con un modello di Large Language”, ha detto Huang.

Combinando software e hardware specializzato, Nvidia si sta posizionando come l’anello mancante per realizzare il pieno potenziale dell’IA.

Debutta il superchip Grace Hopper per l’addestramento dell’IA

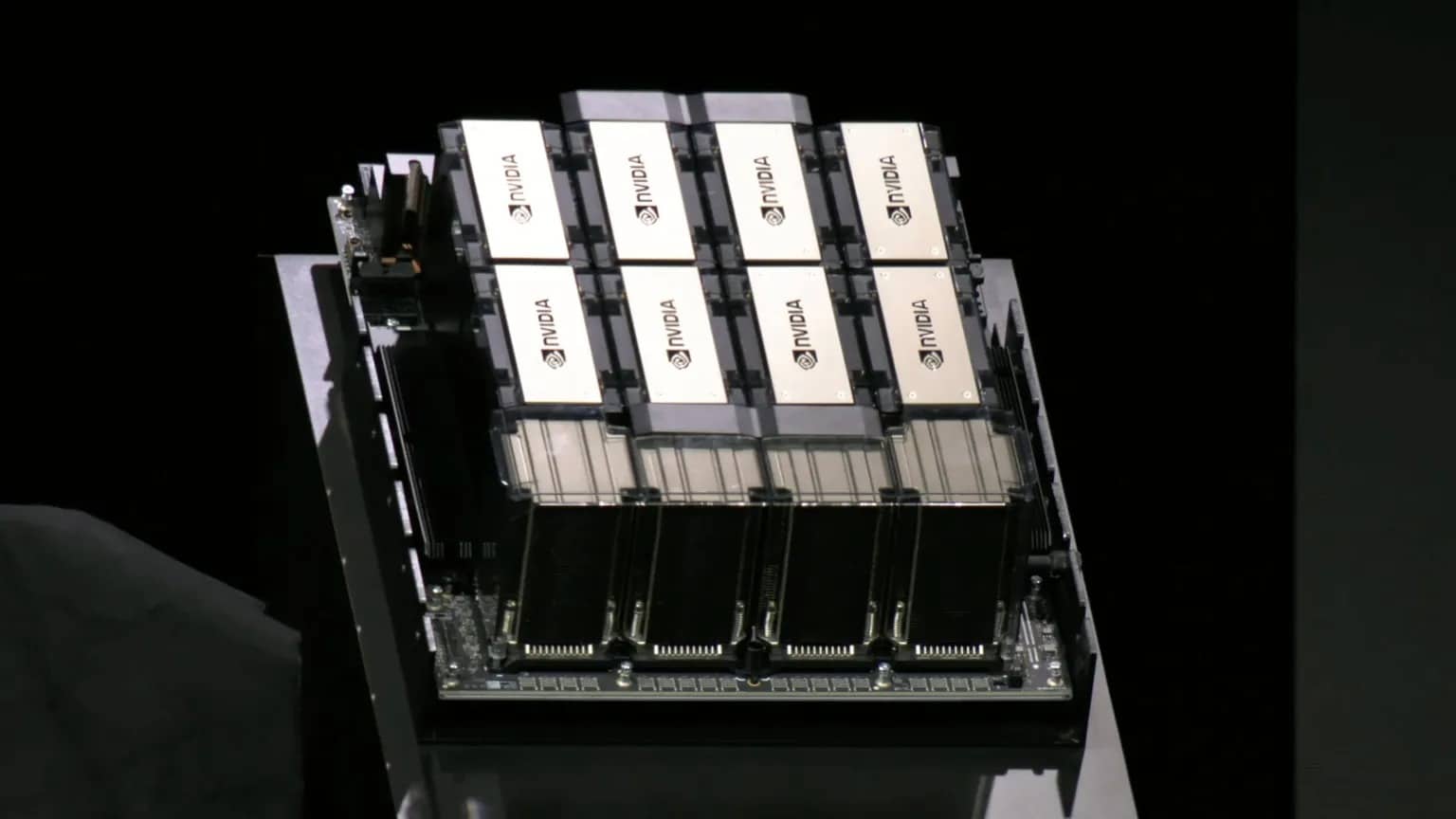

La star dello show è stata il nuovo Grace Hopper Superchip GH200, la prima GPU con High Bandwidth Memory 3e (HBM3e). Con una larghezza di banda fino a 2 TB/s, HBM3e offre una larghezza di banda quasi tripla rispetto alla precedente generazione HBM2e.

Nvidia definisce il suo chip Grace Hopper come una “CPU accelerata progettata da zero per applicazioni AI e di calcolo ad alte prestazioni (HPC) su scala gigante”. Il chip è il risultato della combinazione delle architetture Grace (CPU ad alte prestazioni) e Hopper (GPU ad alte prestazioni) di Nvidia, il cui nome evoca quello della famosa scienziata informatica americana.

Secondo Huang, il GH200 è in grado di fornire prestazioni di addestramento fino a sei volte superiori a quelle della GPU A100, l’ammiraglia di Nvidia, per modelli di intelligenza artificiale di grandi dimensioni. La disponibilità del GH200 è prevista per il secondo trimestre del 2024.

“GH200 è un nuovo motore per l’addestramento e l’inferenza”, ha dichiarato Huang, aggiungendo che “i futuri modelli di frontiera saranno costruiti in questo modo”. Ha detto che questo nuovo superchip “probabilmente farà funzionare anche Crysis”, un videogioco sparatutto in prima persona con requisiti hardware notoriamente pesanti.

L’architettura GPU Lovelace arriva sulle workstation

Nvidia ha presentato anche alcune novità per gli utenti domestici. Il produttore di chip ha presentato le nuove GPU RTX per workstation basate sull’architettura Ada Lovelace: RTX 5000, RTX 4500 e RTX 4000. Con un massimo di 7680 core CUDA, queste GPU offrono prestazioni fino a 5 volte superiori rispetto alle schede di precedente generazione per lo sviluppo dell’intelligenza artificiale, il rendering 3D, l’editing video e altri esigenti flussi di lavoro professionali.

L’ammiraglia RTX 6000 Ada rimane la scelta migliore per i professionisti che richiedono le massime prestazioni. Tuttavia, la nuova linea espande l’architettura Ada Lovelace a una gamma più ampia di utenti. Le RTX 4000, 4500 e 5000 saranno disponibili a partire dal terzo trimestre del 2022 presso i principali OEM.

Tuttavia, queste nuove offerte non sono economiche. Il prezzo dell’RTX 4000 parte da 1.250 dollari e quello dell’RTX 5000 da circa 4.000 dollari.

Per i professionisti e le imprese che vogliono portare le loro iniziative di AI a un livello superiore, Nvidia ha presentato la sua nuova GPU su scala data-center Nvidia L40. Con un massimo di 18.176 CUDA core e 48 GB di vRAM, l’L40 offre prestazioni di formazione AI fino a 9,2 volte superiori rispetto all’A100.

Nvidia afferma che i produttori di server globali intendono offrire l’L40 nei loro sistemi, consentendo alle aziende di addestrare modelli di IA giganteschi con un’efficienza ottimale e un risparmio economico. Abbinato al software Nvidia, l’L40 potrebbe fornire una soluzione completa per le organizzazioni che adottano l’IA.

Microservizi cloud-nativi per migliorare le comunicazioni video

Continuando a puntare sulle applicazioni video, Nvidia ha annunciato anche una nuova suite di kit di sviluppo software accelerati dalle GPU e un servizio cloud-native per l’editing video chiamato Maxine.

Alimentato dall’intelligenza artificiale, Maxine offre funzionalità come la cancellazione del rumore, l’upscaling a risoluzione super e la simulazione del contatto visivo per le videochiamate, consentendo agli utenti remoti di avere conversazioni naturali praticamente ovunque.

Nvidia afferma che i partner che si occupano di visual storytelling hanno già integrato Maxine in flussi di lavoro come le videoconferenze e il video editing.

Toolkit per semplificare lo sviluppo dell’IA generativa

Finalmente, Nvidia ha annunciato l’imminente rilascio di AI Workbench, una piattaforma unificata che semplifica lo sviluppo, il test e la distribuzione di modelli di IA generativa.

Fornendo un’unica interfaccia per la gestione di dati, modelli e risorse tra le macchine, AI Workbench consente una collaborazione e una scalabilità senza soluzione di continuità da una workstation locale a un’infrastruttura cloud.

Con la sua ultima serie di offerte che abbracciano hardware, software e servizi, Nvidia dichiara di voler accelerare l’adozione dell’IA da parte delle imprese attraverso uno stack tecnologico completo costruito per affrontare le sue numerose complessità.