Amerykanie czują się zaniepokojeni rosnącym wykorzystaniem sztucznej inteligencji (AI) w zatrudnianiu i ocenie pracowników, wynika z nowego badania opublikowanego przez Pew Research Center.

Pew Research przebadał 11 004 dorosłych mieszkańców USA w połowie grudnia 2022 roku, pytając uczestników o ich poglądy na temat wpływu AI na siłę roboczą. Podczas gdy niektórzy respondenci uznali skuteczność rekrutacji napędzanej przez AI, wielu wyraziło obawy, że technologia może naruszać prywatność, wpływać na oceny i prowadzić do utraty miejsc pracy.

Zgodnie z badaniem, opublikowanym w czwartek, 32% Amerykanów uważa, że AI w zatrudnianiu i ocenianiu pracowników raczej zaszkodzi niż pomoże kandydatom do pracy i pracownikom.

Siedemdziesiąt jeden procent obywateli USA jest przeciwnych pomysłowi wykorzystania AI do decydowania o zatrudnieniu lub zwolnieniu kogoś. Z drugiej strony, badanie wykazało, że 40% Amerykanów nadal uważa, że AI może zapewnić korzyści kandydatom do pracy i pracownikom poprzez przyspieszenie procesów zatrudniania, zmniejszenie liczby ludzkich błędów i wyeliminowanie potencjalnych uprzedzeń właściwych dla ludzkiego procesu decyzyjnego. Niektórzy respondenci podkreślali również potencjał ocen wydajności napędzanych przez AI, które mogą zapewnić bardziej obiektywną i spójną ocenę umiejętności i produktywności pracowników.

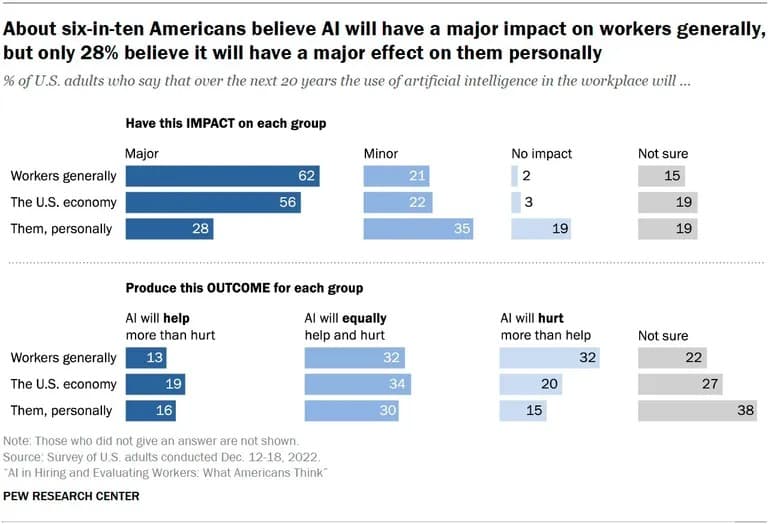

Badania ujawniają, że 32% Amerykanów uważa, że w ciągu najbliższych 20 lat AI przyniesie pracownikom więcej szkody niż pożytku, a zaledwie 13% wykazuje optymistyczny punkt widzenia, przy czym prawie dwie trzecie respondentów stwierdziło, że nie ubiegałoby się o pracę, gdyby wiedziało, że będzie oceniane przez sztuczną inteligencję.

Obawy te dotyczą różnych aspektów procesu zatrudniania, od sprawdzania CV i oceny kandydatów, po monitorowanie wyników i decyzje personalne. W raporcie podkreślono, że większość uczestników obawia się, że systemy AI naruszą ich prywatność, zbierając zbyt wiele informacji osobistych, takich jak historia przeglądania stron internetowych czy aktywność w mediach społecznościowych. Dziewięćdziesiąt procent pracowników z klasy wyższej, 84% pracowników z klasy średniej i 70% pracowników z klasy niższej ma obawy, że będą „nieodpowiednio nadzorowani, jeśli AI zostałaby wykorzystana do zbierania i analizowania informacji” – czytamy w badaniu.

Przeciwdziałanie obawom: Polityka, przejrzystość i edukacja

As AI continues to make inroads into the workforce, tech industry leaders have been pushing for policymakers, businesses, and developers to address the public’s concerns. Na przykład w Unii Europejskiej organy regulacyjne próbowały zapobiec potencjalnym nadużyciom, wzywając do zapewnienia przejrzystości systemów AI, edukacji i szkoleń dla pracowników w celu dostosowania się do szybko zmieniającego się krajobrazu pracy. Niektóre z najbardziej znanych umysłów w branży AI wezwały do wstrzymania szkolenia bardziej zaawansowanych modeli w celu rozwiązania tych problemów, zanim będzie za późno.

Tymczasem regulatorzy zaczęli zwracać uwagę na to, jak te modele sztucznej inteligencji są szkolone i jak mogą wpływać na prawa obywateli. Pierwszy krok został podjęty przez Włochy, kiedy zakazał korzystania z ChatGPT w kraju na podstawie tego, że mógł on nielegalnie zbierać dane od swoich użytkowników i narażać nieletnich na nieodpowiednie interakcje.

Inne kraje europejskie również wyraziły podobne obawy, zwłaszcza że modele sztucznej inteligencji są szczególnie przydatne, jeśli są odpowiednio przeszkolone – co wymaga dużej ilości danych.

Rosnąca rola sztucznej inteligencji w miejscu pracy niesie ze sobą zarówno korzyści, jak i obawy, takie jak prywatność, sprawiedliwość i dyskryminacja. Poprzez przyjęcie proaktywnego podejścia do polityki, przejrzystości i edukacji, politycy chcą zagwarantować, że AI będzie siłą dobra – zapewnienie, że modele AI będą dobrymi szefami nie jest czymś, o czym teraz myślą.