Os americanos estão apreensivos com o uso crescente de inteligência artificial (IA) na contratação e avaliação de trabalhadores, de acordo com um novo estudo divulgado pelo Pew Research Center.

A Pew Research inquiriu 11 004 adultos norte-americanos em meados de Dezembro de 2022, pedindo aos participantes as suas opiniões sobre o impacto da IA na força de trabalho. Embora alguns inquiridos reconheçam a eficiência do recrutamento baseado em IA, muitos expressaram receio de que a tecnologia possa invadir a privacidade, ter impacto nas avaliações e levar à perda de postos de trabalho.

71% dos cidadãos norte-americanos são contra a ideia de utilizar a IA para decidir se se deve contratar ou despedir alguém. Por outro lado, o estudo concluiu que 40% dos americanos ainda pensam que a IA pode trazer benefícios aos candidatos a emprego e aos trabalhadores, acelerando os processos de contratação, reduzindo os erros humanos e eliminando potenciais preconceitos inerentes à tomada de decisões humanas. Alguns inquiridos também destacaram o potencial das avaliações de desempenho baseadas em IA para fornecer uma avaliação mais objectiva e consistente das competências e da produtividade dos trabalhadores.

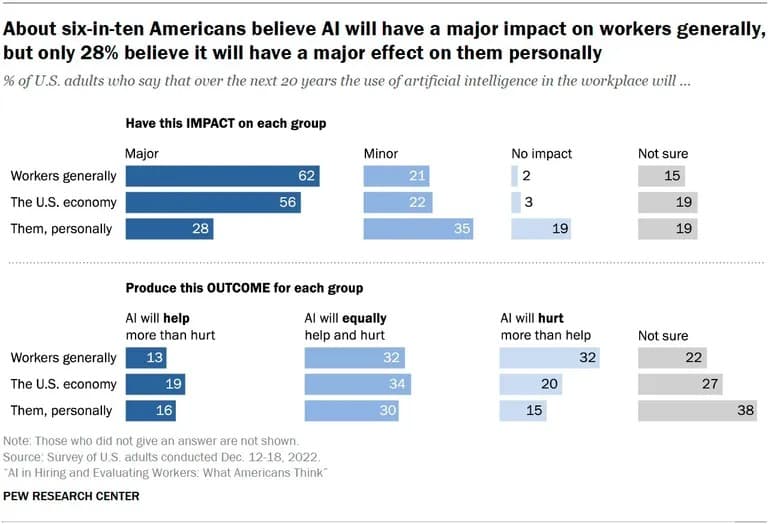

A pesquisa revela que 32% dos americanos acreditam que, nos próximos 20 anos, a IA fará mais mal do que bem aos trabalhadores, com apenas 13% a mostrarem um ponto de vista optimista, com quase dois terços dos inquiridos a dizerem que não se candidatariam a um emprego se soubessem que iam ser avaliados por uma Inteligência Artificial.

Estas preocupações estendem-se a vários aspectos do processo de contratação, desde a triagem de currículos e avaliação de candidatos até à monitorização do desempenho e decisões pessoais. O relatório salienta que a maioria dos participantes receia que os sistemas de IA violem a sua privacidade ao recolherem demasiadas informações pessoais, como o histórico de navegação ou a actividade nas redes sociais. Noventa por cento dos trabalhadores da classe alta, 84% dos trabalhadores da classe média e 70% dos trabalhadores da classe baixa receiam ser “indevidamente vigiados se a IA for utilizada para recolher e analisar informações”, refere o estudo.

Abordar as preocupações: Política, transparência e educação

À medida que a IA continua a fazer incursões na força de trabalho, os líderes da indústria tecnológica têm vindo a pressionar os decisores políticos, as empresas e os programadores para que respondam às preocupações do público. Na União Europeia, por exemplo, os reguladores têm tentado evitar potenciais utilizações indevidas, apelando à transparência dos sistemas de IA, à educação e à formação dos trabalhadores para que se adaptem a um panorama profissional em rápida mutação. Algumas das mentes mais famosas da indústria da IA apelaram a uma pausa na formação de modelos mais avançados, num esforço para resolver estas questões antes que seja demasiado tarde.

Entretanto, os reguladores começaram a prestar atenção à forma como estes modelos de inteligência artificial são treinados e como podem afectar os direitos dos cidadãos. O primeiro passo foi dado pela Itália, quando proibiu a utilização do ChatGPT no país, com o argumento de que poderia estar a recolher ilegalmente dados dos seus utilizadores e a expor menores a interacções inadequadas.

Outros países europeus também expressaram preocupações semelhantes, especialmente porque os modelos de inteligência artificial são particularmente úteis se forem devidamente treinados – o que requer grandes quantidades de dados.

O papel crescente da IA no local de trabalho apresenta tanto benefícios como preocupações, tais como a privacidade, a justiça e a discriminação. Ao adoptar uma abordagem proactiva à política, à transparência e à educação, os políticos procuram garantir que a IA seja uma força para o bem – garantir que os modelos de IA serão bons patrões não é algo que tenham em mente neste momento.