Künstliche Intelligenz (KI) birgt ein enormes Potenzial zur Beschleunigung des Fortschritts in den Bereichen Gesundheit und Medizin, birgt aber auch Risiken, wenn sie nicht sorgfältig eingesetzt wird, wie die Ergebnisse der jüngsten Studien zur Krebsbehandlung zeigen.

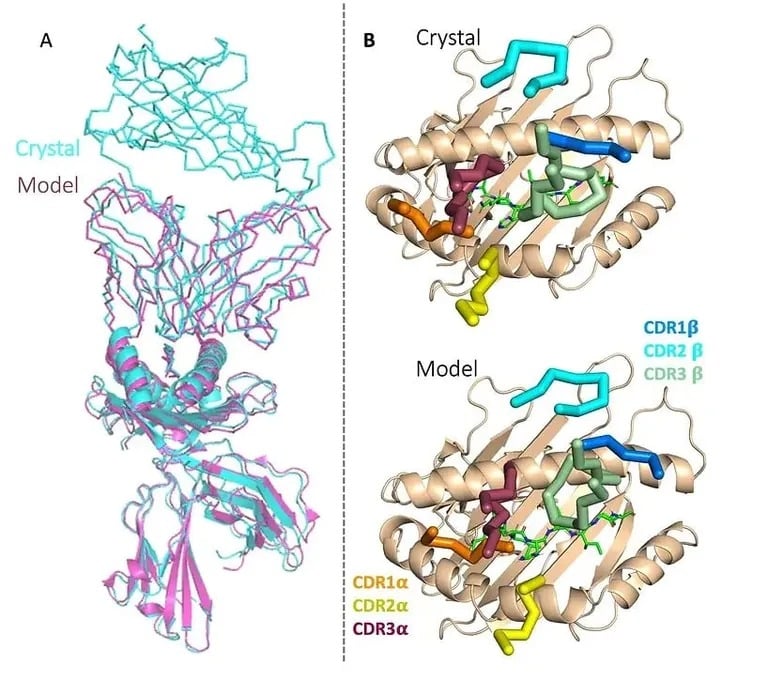

Einerseits hat das britische Biotech-Startup Etcembly gerade bekannt gegeben, dass es mithilfe generativer KI eine neuartige Immuntherapie entwickeln konnte, die auf schwer zu behandelnde Krebsarten abzielt. Dies ist das erste Mal, dass ein Immuntherapie-Kandidat mithilfe von KI entwickelt wurde, und Etcembly – ein Mitglied des Inception-Programms von Nvidia – war in der Lage, ihn in nur 11 Monaten zu entwickeln, also doppelt so schnell wie mit herkömmlichen Methoden.

Das neue Therapeutikum von Etcembly mit der Bezeichnung ETC-101 ist ein bispezifischer T-Zell-Engager, d. h. es zielt auf ein Protein ab, das in vielen Krebsarten, nicht aber in gesundem Gewebe vorkommt. Außerdem weist es eine picomolare Affinität auf und ist damit bis zu einer Million Mal wirksamer als natürliche T-Zell-Rezeptoren.

Das Unternehmen verfügt nach eigenen Angaben auch über eine solide Pipeline anderer Immuntherapien für Krebs und Autoimmunerkrankungen, die von seiner KI-Engine namens EMLy entwickelt werden

Bild: Etcembly

„Etcembly wurde aus unserem Wunsch heraus geboren, zwei Konzepte zusammenzubringen, die dem wissenschaftlichen Mainstream voraus sind – TCRs und generative KI – um die nächste Generation von Immuntherapien zu entwickeln“, sagte CEO Michelle Teng. Ich freue mich darauf, diese Werte weiterzuentwickeln, damit wir die Zukunft der TCR-Therapien Wirklichkeit werden lassen und den Patienten transformative Behandlungen anbieten können.“

Zuvor hatten Forscher gezeigt, dass KI dabei helfen kann, die Ergebnisse experimenteller Krebstherapien vorherzusagen, Krebs-Screening-Techniken zu verbessern, neue senolytische Medikamente zu entdecken, Anzeichen der Parkinson-Krankheit zu erkennen und Protein-Interaktionen zu verstehen, um neue Wirkstoffe zu entwickeln.

Gefahren des Einsatzes einer unvalidierten KI

Andererseits bestehen weiterhin erhebliche Risiken. Einige Menschen beginnen, KI-Chatbots anstelle von Ärzten und Therapeuten zu nutzen, und eine Person hat sich sogar umgebracht, nachdem sie den schädlichen Ratschlägen eines Chatbots gefolgt war.

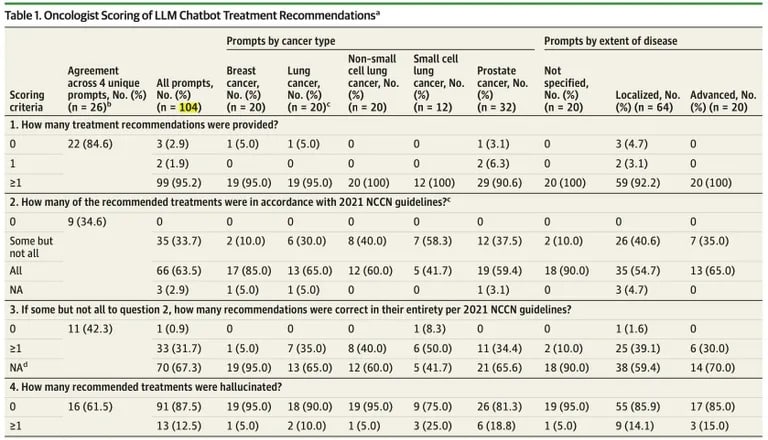

Auch Wissenschaftler schließen sich der Auffassung an, dass Menschen nicht blindlings den Ratschlägen von KI folgen sollten. Eine neue, in JAMA Oncology veröffentlichte Studie legt nahe, dass ChatGPT bei der Erstellung von Krebsbehandlungsplänen kritische Grenzen aufweist, was die Risiken unterstreicht, wenn KI-Empfehlungen ohne umfassende Validierung klinisch eingesetzt werden.

Forscher des Brigham and Women’s Hospital in Boston fanden heraus, dass die Behandlungsempfehlungen von ChatGPT für verschiedene Krebsfälle viele sachliche Fehler und widersprüchliche Informationen enthielten.

Von 104 Anfragen enthielt etwa ein Drittel der Antworten von ChatGPT falsche Angaben, so die in JAMA Oncology veröffentlichte Studie.

„Alle Ausgaben mit einer Empfehlung enthielten mindestens eine NCCN-konforme Behandlung, aber 35 von 102 (34,3 %) dieser Ausgaben empfahlen auch eine oder mehrere nicht-konforme Behandlungen“, so die Studie.

Quelle: JAMA Oncology

Obwohl 98 % der Pläne einige korrekte Richtlinien enthielten, mischten fast alle richtige und falsche Inhalte.

„Wir waren erstaunt über das Ausmaß, in dem falsche Informationen mit korrekten Fakten vermischt wurden, so dass es selbst für Fachleute schwierig war, Fehler zu erkennen“, so die Mitautorin Dr. Danielle Bitterman.

Im Einzelnen ergab die Studie, dass 12,5 % der Behandlungsempfehlungen von ChatGPT komplett halluziniert oder vom Bot erfunden waren, ohne dass sie sachlich korrekt waren. Die KI hatte besondere Schwierigkeiten, zuverlässige lokalisierte Therapien für fortgeschrittene Krebserkrankungen und den angemessenen Einsatz von Immuntherapien zu entwickeln.

OpenAI selbst weist darauf hin, dass ChatGPT nicht dazu gedacht ist, medizinische Ratschläge zu erteilen oder Diagnosen für ernsthafte Gesundheitszustände zu stellen. Dennoch erhöht die Tendenz des Modells, selbstbewusst mit widersprüchlichen oder falschen Informationen zu antworten, die Risiken, wenn es ohne strenge Validierung klinisch eingesetzt wird.

Ameisengift zu essen ist natürlich ein absolutes Tabu, auch wenn die KI im Supermarkt dazu rät, aber wenn es um komplexe akademische Begriffe und heikle Ratschläge geht, sollte man auch mit einem Menschen sprechen.

Bei sorgfältiger Validierung könnten KI-gestützte Werkzeuge schnell neue lebensrettende Behandlungen ermöglichen und gleichzeitig gefährliche Fehltritte vermeiden. Doch bis dahin sollten Patienten KI-generierte medizinische Ratschläge mit einer gesunden Portion Skepsis betrachten.