La inteligencia artificial (IA) tiene un enorme potencial para acelerar los avances en salud y medicina, pero también entraña riesgos si no se aplica con cuidado, como demuestran los resultados contradictorios de recientes estudios sobre el tratamiento del cáncer.

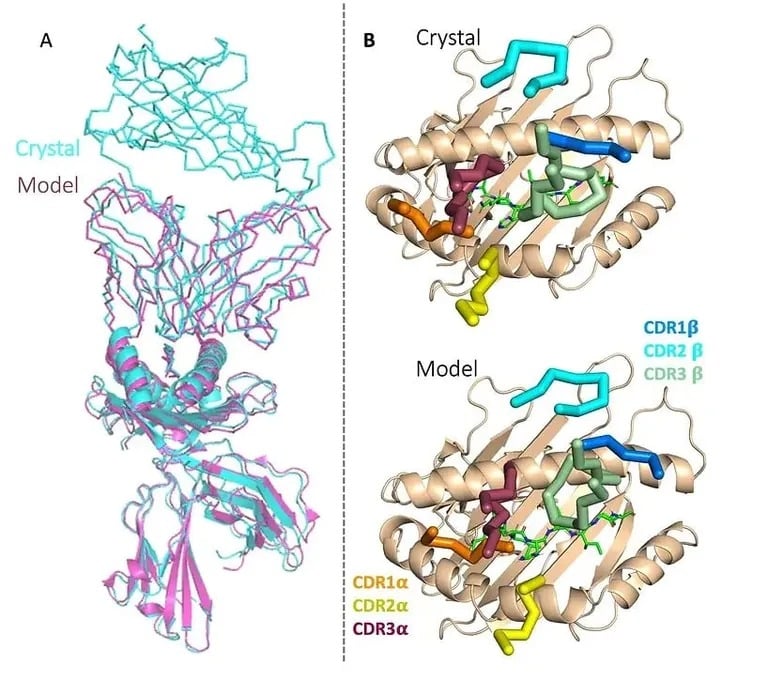

Por un lado, la empresa británica de biotecnología Etcembly acaba de anunciar que ha sido capaz de utilizar la IA generativa para diseñar una nueva inmunoterapia contra cánceres difíciles de tratar. Es la primera vez que se desarrolla un candidato a inmunoterapia utilizando IA, y Etcembly -que es miembro del programa Inception de Nvidia- fue capaz de crearlo en sólo 11 meses, es decir, el doble de rápido que con los métodos convencionales.

El nuevo fármaco de Etcembly, denominado ETC-101, es un captador biespecífico de células T, lo que significa que se dirige a una proteína presente en muchos tipos de cáncer y no en el tejido sano. Además, presenta una afinidad picomolar, por lo que es hasta un millón de veces más potente que los receptores naturales de células T.

La empresa afirma que también cuenta con una sólida cartera de otras inmunoterapias contra el cáncer y las enfermedades autoinmunes diseñadas por su motor de inteligencia artificial, denominado EMLy.

Imagen: Etcembly

«Etcembly nació de nuestro deseo de aunar dos conceptos que van por delante de la corriente científica dominante -los TCR y la IA generativa- para diseñar la próxima generación de inmunoterapias», declaró Michelle Teng, Directora General. «Me entusiasma llevar adelante estos activos para que podamos hacer realidad el futuro de la terapéutica con TCR y llevar tratamientos transformadores a los pacientes».

Anteriormente, los investigadores demostraron que la IA podía ayudar a predecir los resultados de tratamientos experimentales contra el cáncer, mejorar las técnicas de cribado del cáncer, descubrir nuevos fármacos senolíticos, detectar signos de la enfermedad de Parkinson y comprender las interacciones entre proteínas para diseñar nuevos compuestos.

D

Peligros de utilizar una IA no validada

Por otro lado, sigue habiendo riesgos importantes. Algunos individuos están empezando a utilizar chatbots de IA en lugar de médicos y terapeutas, y una persona incluso se suicidó tras seguir los consejos perjudiciales de un chatbot.

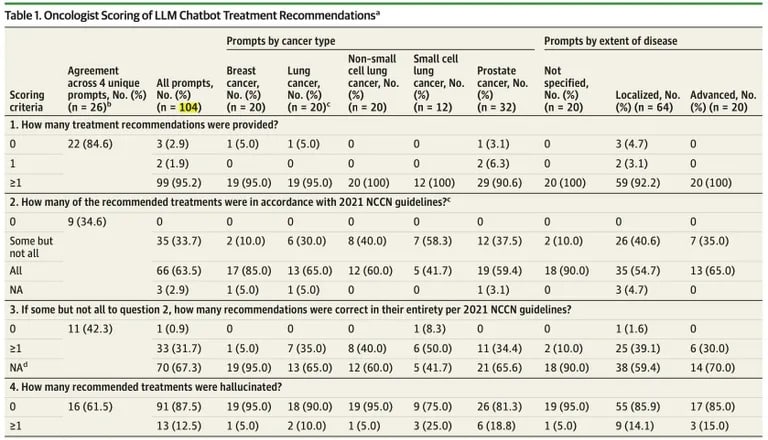

Los científicos también se están alineando con la idea de que las personas no deben seguir ciegamente los consejos de la IA. Un nuevo estudio publicado por JAMA Oncology sugiere que ChatGPT tiene limitaciones críticas a la hora de generar planes de tratamiento del cáncer, lo que subraya los riesgos si las recomendaciones de la IA se despliegan clínicamente sin una validación exhaustiva.

Los investigadores del Brigham and Women’s Hospital de Boston descubrieron que las recomendaciones de tratamiento de ChatGPT para varios casos de cáncer contenían muchos errores e información contradictoria.

Según el estudio publicado en JAMA Oncology, de 104 consultas, alrededor de un tercio de las respuestas de ChatGPT contenían datos incorrectos.

«Todos los resultados con una recomendación incluían al menos un tratamiento compatible con la NCCN, pero 35 de 102 (34,3%) de estos resultados también recomendaban uno o más tratamientos no compatibles», según el estudio.

Fuente: JAMA Oncology

Aunque el 98% de los planes incluían algunas directrices precisas, casi todos mezclaban contenidos correctos e incorrectos.

«Nos sorprendió el grado en que la información incorrecta se mezclaba con datos precisos, lo que dificultaba la identificación de los errores, incluso para los especialistas», afirma la Dra. Danielle Bitterman, coautora del estudio.

En concreto, el estudio halló que el 12,5% de las recomendaciones de tratamiento de ChatGPT eran completamente alucinadas o fabricadas por el bot sin ninguna precisión factual. La IA tuvo especiales problemas para generar terapias localizadas fiables para cánceres avanzados y el uso adecuado de fármacos de inmunoterapia.

La propia OpenAI advierte de que ChatGPT no pretende ofrecer asesoramiento médico ni servicios de diagnóstico para enfermedades graves. Aun así, la tendencia del modelo a responder con seguridad con información contradictoria o falsa aumenta los riesgos si se despliega clínicamente sin una validación rigurosa.

Evidentemente, no se debe comer veneno para hormigas aunque la IA del supermercado lo aconseje, pero cuando se trata de términos académicos complejos y consejos delicados, también se debe hablar con un humano.

Con una validación cuidadosa, las herramientas basadas en IA podrían descubrir rápidamente nuevos tratamientos que salven vidas y evitar peligrosos errores. Pero, por ahora, los pacientes deben ver los consejos médicos generados por IA con una buena dosis de escepticismo.