Изкуственият интелект (ИИ) има огромен потенциал за ускоряване на напредъка в здравеопазването и медицината, но също така крие рискове, ако не се прилага внимателно, както се вижда от двойните резултати от последните проучвания за лечение на рак.

От една страна, базираният в Обединеното кралство биотехнологичен стартъп Etcembly току-що обяви, че е успял да използва генеративен ИИ, за да разработи нова имунотерапия, насочена към трудно лечими видове рак. За първи път кандидат за имунотерапия е разработен с помощта на ИИ, а Etcembly – която е член на програмата Inception на Nvidia – е успяла да го създаде само за 11 месеца, или два пъти по-бързо от конвенционалните методи.

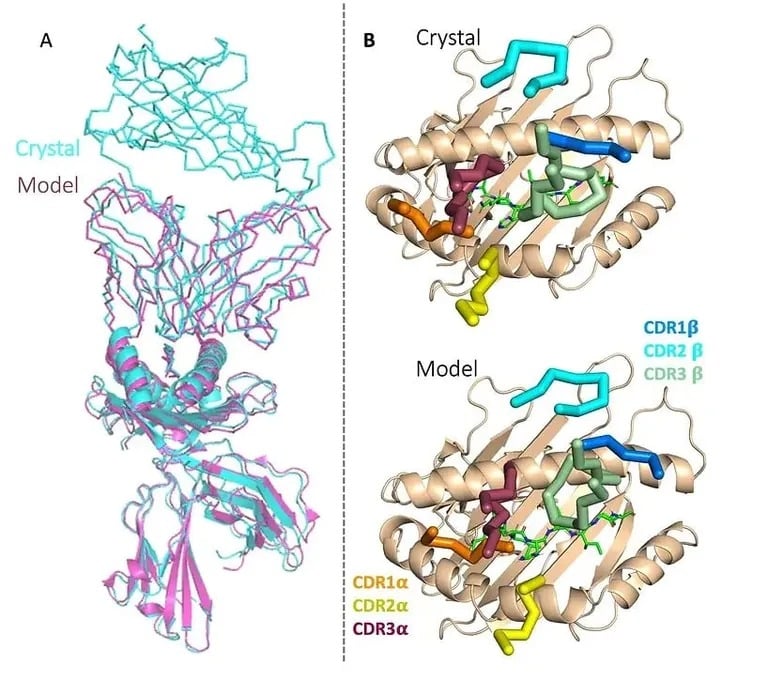

Новото терапевтично средство на Etcembly, наречено ETC-101, е биспецифично средство за ангажиране на Т-клетки, което означава, че е насочено към протеин, който се среща в много видове рак, но не и в здрави тъкани. Той също така демонстрира пикомоларен афинитет и по този начин е до милион пъти по-силен от естествените Т-клетъчни рецептори.

Компанията заявява, че разполага и със солиден набор от други имунотерапии за рак и автоимунни заболявания, разработени от нейния механизъм за изкуствен интелект, наречен EMLy.

Изображение: Etcembly

„Etcembly се роди от желанието ни да обединим две концепции, които изпреварват научния мейнстрийм – TCR и генеративен AI, за да разработим следващото поколение имунотерапии“, казва главният изпълнителен директор Мишел Тенг. „Развълнувана съм да придвижа тези активи напред, за да можем да превърнем бъдещето на TCR терапиите в реалност и да предоставим трансформиращи лечения на пациентите.

По-рано изследователите показаха, че ИИ може да помогне за прогнозиране на резултатите от експериментално лечение на рак, да подобри техниките за скрининг на рака, да открие нови сенолитични лекарства, да открие признаците на болестта на Паркинсон и да разбере взаимодействията между протеините, за да разработи нови съединения.

Опасностите от внедряването на невалидиран ИИ

От друга страна, остават значителни рискове. Някои хора започват да използват чатботове с изкуствен интелект вместо лекари и терапевти, като един човек дори се самоуби, след като последва вредните съвети на чатбот.

Учените също се присъединяват към идеята, че хората не трябва сляпо да следват съветите на ИИ. Ново проучване, публикувано от JAMA Oncology, показва, че ChatGPT има критични ограничения при генерирането на планове за лечение на рак, което подчертава рисковете, ако препоръките на ИИ се прилагат в клиничната практика без задълбочено валидиране.

Изследователите от болницата Brigham and Women’s Hospital в Бостън установиха, че препоръките за лечение на различни случаи на рак, дадени от ChatGPT, съдържат много фактически грешки и противоречива информация.

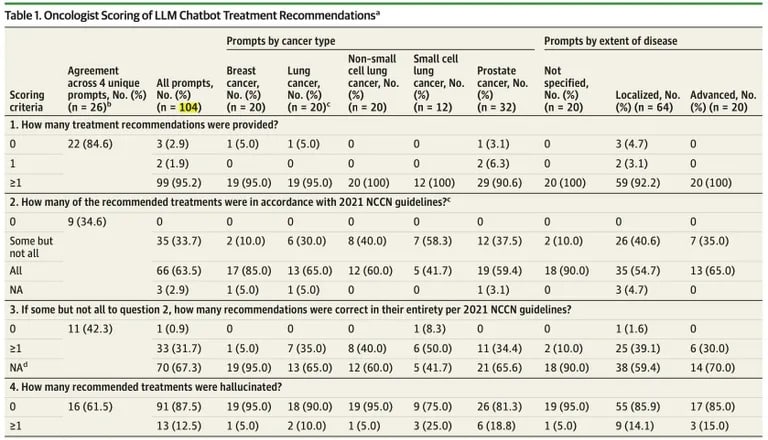

В проучването, публикувано в JAMA Oncology, се посочва, че от 104 запитвания около една трета от отговорите на ChatGPT са с неверни данни.

„Всички резултати с препоръка включваха поне 1 лечение, съвместимо с NCCN, но 35 от 102 (34,3%) от тези резултати препоръчваха и 1 или повече несъвместими лечения“, установи проучването.

Източник: JAMA Oncology

Въпреки че 98% от плановете са включвали някои точни насоки, почти всички са смесвали правилно и неправилно съдържание.

„Бяхме поразени от степента, в която невярната информация е смесена с точни факти, което прави грешките трудни за идентифициране – дори за специалистите“, казва съавторът д-р Даниел Битерман.

По-конкретно, проучването установи, че 12,5 % от препоръките за лечение на ChatGPT са били напълно халюцинирани или измислени от бота без никаква фактическа точност. Изкуственият интелект се сблъска с особени проблеми при генерирането на надеждни локализирани терапии за напреднали ракови заболявания и подходящо използване на лекарства за имунотерапия.

Самият OpenAI предупреждава, че ChatGPT не е предназначен за предоставяне на медицински съвети или диагностични услуги за сериозни здравословни състояния. Въпреки това склонността на модела да отговаря уверено с противоречива или невярна информация увеличава рисковете, ако се използва в клиничната практика без строга проверка.

Яденето на отрова за мравки е очевидно забранено, дори ако изкуственият интелект на супермаркета ви посъветва да го направите, но когато става въпрос за сложни академични термини и деликатни съвети, също трябва да говорите с човек.

При внимателно валидиране инструментите, задвижвани от ИИ, биха могли бързо да отключат нови животоспасяващи лечения, като същевременно се избягват опасни грешки. Но засега пациентите е добре да гледат на медицинските съвети, генерирани от изкуствен интелект, със здравословна доза скептицизъм.