L’intelligenza artificiale ha cambiato le carte in tavola in numerosi campi, dalla sanità alla vendita al dettaglio, dall’intrattenimento all’arte. Tuttavia, una nuova ricerca suggerisce che potremmo aver raggiunto un punto di svolta: L’apprendimento dell’intelligenza artificiale da contenuti generati dall’intelligenza artificiale.

Questo ouroboros dell’IA, un serpente che si mangia la coda, potrebbe fare una brutta fine. Un gruppo di ricercatori di diverse università del Regno Unito ha lanciato un allarme su quello che ha definito “collasso del modello”, un processo degenerativo che potrebbe separare completamente l’IA dalla realtà.

In un documento intitolato “The Curse of Recursion: Training on Generated Data Makes Models Forget”, i ricercatori delle università di Cambridge e Oxford, dell’Università di Toronto e dell’Imperial College di Londra spiegano che il collasso del modello si verifica quando “i dati generati finiscono per inquinare il set di addestramento della prossima generazione di modelli”.

“Essendo addestrati su dati inquinati, percepiscono male la realtà”, scrivono.

In altre parole, i diffusi contenuti generati dall’IA e pubblicati online potrebbero essere risucchiati nei sistemi di IA, portando a distorsioni e imprecisioni.

Questo problema è stato riscontrato in una serie di modelli e strumenti generativi appresi, tra cui i Large Language Models (LLM), i Variational Autoencoders e i Gaussian Mixture Models. Con il tempo, i modelli iniziano a “dimenticare la vera distribuzione dei dati sottostanti”, portando a rappresentazioni inaccurate della realtà, perché le informazioni originali diventano così distorte da smettere di assomigliare ai dati del mondo reale.

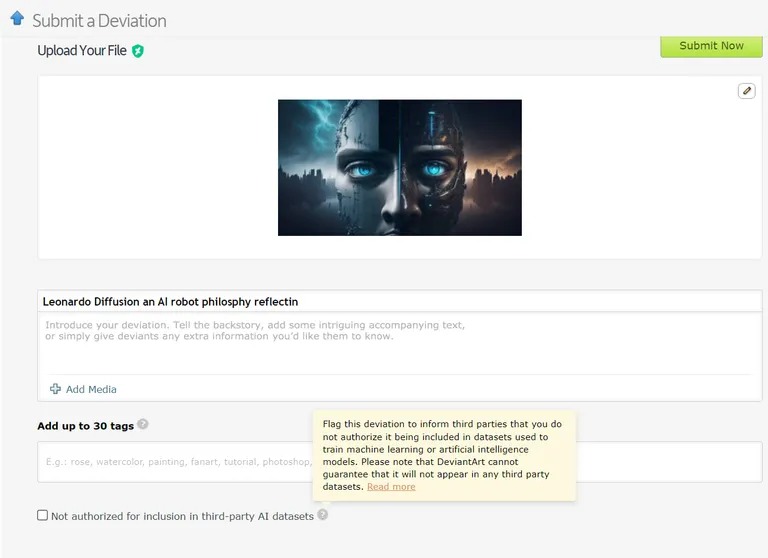

Esistono già casi in cui i modelli di apprendimento automatico vengono addestrati su dati generati dall’intelligenza artificiale. Per esempio, i modelli di apprendimento linguistico (LLM) sono stati intenzionalmente addestrati sui risultati del GPT-4. Allo stesso modo, DeviantArt, la piattaforma online per artisti, consente di pubblicare opere d’arte create dall’IA e di utilizzarle come dati di addestramento per nuovi modelli di IA.

Immagine: Devianart

Come il tentativo di copiare o clonare indefinitamente qualcosa, queste pratiche, secondo i ricercatori, potrebbero portare a un maggior numero di casi di collasso del modello.

Date le gravi implicazioni del collasso del modello, l’accesso alla distribuzione dei dati originali è fondamentale. I modelli di intelligenza artificiale hanno bisogno di dati reali e prodotti dall’uomo per comprendere e simulare accuratamente il nostro mondo.

Come prevenire il collasso del modello

Secondo il documento di ricerca, le cause principali del collasso dei modelli sono due. La prima è l'”errore di approssimazione statistica”, legato al numero finito di campioni di dati. La seconda è l'”errore di approssimazione funzionale”, che deriva dal fatto che il margine di errore utilizzato durante l’addestramento dell’intelligenza artificiale non è configurato correttamente. Questi errori possono aggravarsi nel corso delle generazioni, causando un effetto a cascata di peggioramento delle imprecisioni.

L’articolo parla di un “vantaggio del primo arrivato” per l’addestramento dei modelli di intelligenza artificiale. Se riusciamo a mantenere l’accesso alla fonte originale di dati generati dall’uomo, potremmo evitare un dannoso spostamento della distribuzione e quindi il collasso del modello.

Distinguere i contenuti generati dall’IA su scala è tuttavia una sfida ardua, che potrebbe richiedere un coordinamento a livello di comunità.

In definitiva, l’importanza dell’integrità dei dati e l’influenza delle informazioni umane sull’IA sono valide solo quanto i dati da cui provengono, e l’esplosione dei contenuti generati dall’IA potrebbe finire per essere un’arma a doppio taglio per il settore. L’IA basata sui contenuti dell’IA porterà a molte macchine molto intelligenti, ma “deliranti”.

Che ne dite di un ironico colpo di scena? La nostra progenie di macchine, che impara più dagli altri che da noi, diventa “delirante”. La prossima volta avremo a che fare con una ChatGPT.

delirante e adolescente.