人工智能已经改变了许多领域的游戏规则,从医疗保健到零售到娱乐和艺术。然而,新的研究表明,我们可能已经达到了一个转折点: 人工智能从人工智能生成的内容中学习。

这条人工智能的乌龙–一条吃自己尾巴的蛇–可能会有相当糟糕的结局。来自英国不同大学的一个研究小组对他们所谓的 “模型崩溃 “发出了警告,这是一个可能将人工智能与现实完全分离的退化过程。

在一篇题为《递归的诅咒》的论文中: 来自剑桥大学、牛津大学、多伦多大学和伦敦帝国学院的研究人员解释说,当 “生成的数据最终污染了下一代模型的训练集 “时,就会发生模型崩溃。

“他们写道:”由于被污染的数据所训练,它们就会误解现实。

换句话说,由人工智能产生的广泛的内容被发表在网上,可能被吸回到人工智能系统中,导致扭曲和不准确。

这个问题已经在一系列学习生成模型和工具中被发现,包括大型语言模型(LLMs)、变异自动编码器和高斯混合模型。随着时间的推移,模型开始 “忘记真正的基础数据分布”,导致对现实的不准确表述,因为原始信息变得非常扭曲,不再像真实世界的数据。

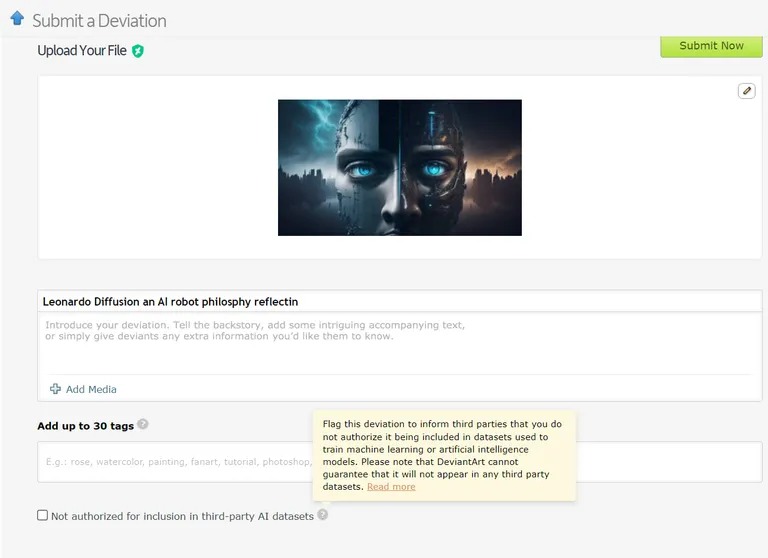

已经有机器学习模型在人工智能生成的数据上进行训练的例子。例如,语言学习模型(LLMs)正被有意地在GPT-4的输出上进行训练。同样,艺术家的在线平台DeviantArt允许人工智能创造的艺术品被发布,并被用作更新的人工智能模型的训练数据。

图片: Devianart

研究人员认为,这些做法与试图无限期地复制或克隆某些东西一样,可能会导致更多的模型崩溃的情况。

鉴于模型崩溃的严重影响,获取原始数据分布是至关重要的。人工智能模型需要真实的、由人类生产的数据来准确地理解和模拟我们的世界。

如何防止模型崩溃

根据研究论文,模型崩溃有两个主要原因。首先是 “统计近似错误”,这与数据样本的有限数量有关。次要的是 “功能近似错误”,这源于人工智能训练过程中使用的误差范围没有被正确配置。这些错误会在几代人的时间里变得更加复杂,造成越来越不准确的连带效应。

该文件阐述了训练人工智能模型的 “先发优势”。如果我们能保持对人类产生的原始数据源的访问,我们可能会防止有害的分布转移,从而防止模型崩溃。

然而,在规模上区分人工智能生成的内容是一个艰巨的挑战,这可能需要全社会的协调。

最终,数据完整性的重要性和人类信息对人工智能的影响只有来自于数据,而人工智能生成的内容的爆炸可能最终成为行业的一把双刃剑。这是 “垃圾进,垃圾出”–基于人工智能内容的人工智能将导致许多非常聪明,但 “妄想 “的机器。

这个讽刺性的情节转折如何?我们的机器后代,从彼此身上学到的东西多于从我们身上学到的东西,变得 “有妄想”。接下来,我们将不得不处理一个有妄想症的青少年ChatGPT.

。