Nu er steeds meer realistische AI-gegenereerde foto’s en video’s online verschijnen, zijn techbedrijven en waakhondgroepen druk bezig met het ontwikkelen van tools om nepcontent te identificeren.

Het toevoegen van een onzichtbaar vlaggetje in de vorm van verborgen metagegevens die helpen onthullen dat een afbeelding is gemaakt met behulp van een generatieve AI-tool. Maar onderzoekers hebben ontdekt dat zo’n watermerk één grote fout heeft: tegenstanderstechnieken kunnen het gemakkelijk verwijderen.

Nu stellen grote camerafabrikanten een andere aanpak voor – in zekere zin het tegenovergestelde: in plaats daarvan watermerken in “echte” foto’s insluiten.

Nikon, Sony en Canon hebben onlangs een gezamenlijk initiatief aangekondigd om digitale handtekeningen op te nemen in foto’s die rechtstreeks uit hun high-end spiegelloze camera’s komen. Volgens Nikkei Asia zullen de handtekeningen belangrijke metadata zoals datum, tijd, GPS-locatie en fotograafgegevens integreren, waardoor de digitale oorsprong van elke foto cryptografisch wordt gecertificeerd.

Nikon zegt dat het deze functie zal introduceren in zijn aankomende serie professionele spiegelloze camera’s; Sony zal firmware-updates uitbrengen om digitale handtekeningen in te voegen in zijn huidige spiegelloze camera’s; en Canon is van plan om in 2024 te debuteren met camera’s met ingebouwde authenticatie, samen met video watermerken later dat jaar.

Het doel, zo meldt Nikkei, is om fotojournalisten, mediaprofessionals en artiesten onweerlegbaar bewijs te geven van de geloofwaardigheid van hun beelden. De knoeibestendige handtekeningen verdwijnen niet door bewerkingen en moeten helpen bij het bestrijden van desinformatie en frauduleus gebruik van foto’s online.

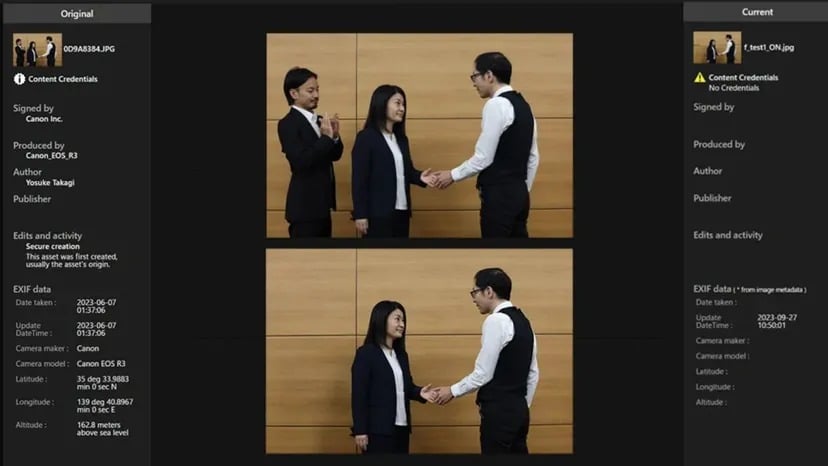

Om dit te ondersteunen hebben de bedrijven samengewerkt aan een open standaard voor interoperabele digitale handtekeningen genaamd “Verify”. Zodra deze er is, kunnen foto’s die met de juiste hardware zijn gemaakt gratis online worden gecontroleerd, zodat mensen kunnen bepalen of een foto authentiek is of niet.

Als een AI-gegenereerde foto door het Verify-systeem probeert te komen zonder authentieke handtekening, wordt deze gemarkeerd als “No Content Credentials.”

Bron: Canon

In plaats van AI-inhoud met terugwerkende kracht te markeren, verifieert het plan echte foto’s direct bij de bron. Maar net als elk ander watermerksysteem zal het succes afhangen van wijdverspreide acceptatie (meer hardwarefabrikanten nemen de standaard over) en een tijdvaste implementatie (de code evolueert om onhackbaar te blijven).

Zoals TCN rapporteerde, geeft recent onderzoek aan dat anti-watermerktechnieken ook ingesloten handtekeningen kunnen compromitteren, waardoor de huidige watermerkmethodes nutteloos worden. Dit maakt watermerkafbeeldingen echter alleen maar onwatermerkt, zodat mensen minder hulpmiddelen hebben om hun kunstmatigheid te detecteren.

Hoewel anti-watermerktechnieken mogelijk echtheidshandtekeningen van echte foto’s kunnen verwijderen, is dit minder problematisch dan het verwijderen van watermerken van door AI gegenereerde nepafbeeldingen. Waarom? Als een watermerk wordt verwijderd van een AI deepfake, kan de vervalste inhoud gemakkelijker voor echt doorgaan. Echter, als authenticatiehandtekeningen van echte foto’s worden gehackt, is het overgebleven beeld nog steeds vastgelegd door een camera – het is niet afkomstig van een generatief model. Hoewel het zijn cryptografische bewijs verliest, is de onderliggende inhoud nog steeds echt.

Het primaire risico in dat geval heeft te maken met naamsvermelding en rechtenbeheer, niet met de waarachtigheid van de inhoud. De afbeelding kan verkeerd gecrediteerd worden of gebruikt worden zonder de juiste licenties, maar het misleidt kijkers niet per definitie over de werkelijkheid die het voorstelt.

OpenAI kondigde onlangs een AI-aangedreven deepfake detector aan die naar eigen zeggen 99% nauwkeurigheid heeft op afbeeldingen. Toch blijven AI-detectoren onvolmaakt en moeten ze voortdurend worden verbeterd om de ontwikkelingen in generatieve technologie te kunnen bijhouden.

De recente toename in de geavanceerdheid van deepfakes heeft de noodzaak van zulke strategieën duidelijk gemaakt. Zoals we in 2023 hebben gezien, is de noodzaak om onderscheid te maken tussen echte en gefabriceerde inhoud nog nooit zo acuut geweest. Zowel politici als tech-ontwikkelaars zijn druk bezig met het vinden van haalbare oplossingen, dus een beetje hulp van deze bedrijven wordt zeker gewaardeerd.