С разпространението на реалистични снимки и видеоклипове, генерирани от изкуствен интелект, технологичните компании и групите за наблюдение се надпреварват да разработват инструменти за идентифициране на фалшиво съдържание.

Водният знак на компютърно генерирани изображения е често предлагано решение, което добавя невидим флаг под формата на скрити метаданни, които помагат да се разкрие, че изображението е създадено с помощта на инструмент за генериране на изкуствен интелект. Но изследователите са установили, че този воден знак има един основен недостатък: противниковите техники могат лесно да го премахнат.

Сега големите производители на фотоапарати предлагат различен подход – в известен смисъл противоположен: вместо това вграждат водни знаци в „истински“ снимки.

Nikon, Sony и Canon наскоро обявиха съвместна инициатива за включване на цифрови подписи в изображения, направени директно от техните безогледални фотоапарати от висок клас. Според Nikkei Asia подписите ще включват ключови метаданни като дата, час, GPS местоположение и данни за фотографа, като по криптографски начин ще удостоверяват цифровия произход на всяка снимка.

Nikon заяви, че ще пусне тази функция в предстоящата си линия професионални безогледални фотоапарати; Sony ще издаде актуализации на фърмуера, за да вмъкне цифрови подписи в настоящите си безогледални фотоапарати; а Canon възнамерява да дебютира с фотоапарати с вградена автентификация през 2024 г., заедно с видео с воден знак по-късно същата година.

Целта, както съобщава Nikkei, е да се предостави на фотожурналистите, медийните специалисти и художниците неопровержимо доказателство за достоверността на техните изображения. Устойчивите на фалшифициране подписи няма да изчезнат при редактиране и би трябвало да подпомогнат усилията за борба с дезинформацията и измамното използване на снимки онлайн.

За да подпомогнат това, компаниите си сътрудничат за отворен стандарт за оперативно съвместими цифрови подписи, наречен „Verify“. След като бъде въведен, снимките, направени с подходящ хардуер, ще могат да се проверяват безплатно онлайн, така че хората да могат да определят дали дадена снимка е автентична или не.

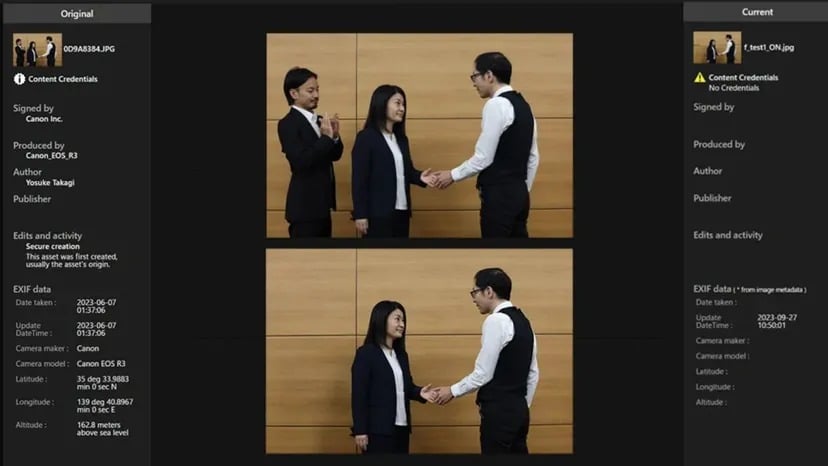

Ако снимка, генерирана от изкуствен интелект, се опита да премине през системата Verify без автентичен подпис, тя ще бъде маркирана като „Без удостоверения за съдържание“.

Източник: Canon

Вместо да маркира със задна дата съдържание с изкуствен интелект, планът директно удостоверява автентичността на реалните снимки при техния произход. Но както всяка друга система за водни знаци, нейният успех ще зависи от широкото ѝ приемане (повече производители на хардуер ще включат стандарта) и от устойчивото във времето изпълнение (кодът ще се развива, за да остане нехакнат).

Както съобщи TCN, скорошни изследвания показват, че техниките за борба с водните знаци също могат да компрометират вградените подписи, което прави настоящите методи за водни знаци безполезни. Това обаче само прави изображенията с водни знаци без водни знаци, така че хората разполагат с по-малко инструменти за откриване на тяхната изкуственост.

Макар че техниките за борба с водните знаци потенциално биха могли да премахнат подписите за автентичност от истински снимки, това е по-малко проблематично, отколкото премахването на водните знаци от фалшиви изображения, генерирани от изкуствен интелект. Защо? Ако водният знак бъде премахнат от дълбоко фалшиво изображение с изкуствен интелект, това позволява на подправеното съдържание да се представи по-лесно за истинско. Ако обаче подписите за автентичност бъдат отстранени от истински снимки, останалото изображение все още е заснето от камера – то не произлиза от генеративен модел. Въпреки че губи криптографското си доказателство, съдържанието, което стои в основата му, все още е истинско.

Основният риск в този случай е свързан с приписването и управлението на правата, а не с истинността на съдържанието. Изображението може да бъде неправилно приписано или използвано без подходящо лицензиране, но по своята същност то не заблуждава зрителите относно реалността, която представя

OpenAI наскоро обяви, че разполага с дълбокообхватен детектор за фалшификати с изкуствен интелект, за който твърди, че има 99% точност при изображенията. И все пак детекторите с изкуствен интелект остават несъвършени и трябва постоянно да се усъвършенстват, за да изпреварят развитието на генеративните технологии.

Неотдавнашният ръст на сложността на дълбоките фалшификати наистина постави в центъра на вниманието необходимостта от такива стратегии. Както видяхме през 2023 г., нуждата от разграничаване на истинското от изфабрикуваното съдържание никога не е била по-остра. Както политиците, така и разработчиците на технологии се мъчат да намерят жизнеспособни решения, така че малко помощ от тези компании със сигурност ще бъде оценена.