Jelikož se na internetu množí realistické fotografie a videa generované umělou inteligencí, technologické firmy a skupiny ochránců se předhánějí ve vývoji nástrojů pro identifikaci falešného obsahu.

Běžně navrhovaným řešením je přidání vodoznaku na počítačem generované snímky, který přidává neviditelný příznak v podobě skrytých metadat, jež pomáhají odhalit, že obrázek byl vytvořen pomocí generativního nástroje umělé inteligence. Výzkumníci však zjistili, že takový vodoznak má jednu zásadní vadu: nepřátelské techniky jej mohou snadno odstranit.

Nyní velcí výrobci fotoaparátů navrhují jiný přístup – svým způsobem opačný: místo toho vkládají vodoznaky do „skutečných“ fotografií.

Společnosti Nikon, Sony a Canon nedávno oznámily společnou iniciativu, jejímž cílem je zahrnout digitální podpisy do snímků pořízených přímo z jejich špičkových bezzrcadlovek. Podle Nikkei Asia budou podpisy zahrnovat klíčová metadata, jako je datum, čas, poloha GPS a údaje o fotografovi, a kryptograficky tak potvrzovat digitální původ každé fotografie.

Společnost Nikon uvedla, že tuto funkci uvede na trh ve své nadcházející řadě profesionálních bezzrcadlovek; Sony vydá aktualizace firmwaru pro vložení digitálních podpisů do svých současných bezzrcadlovek; a Canon hodlá debutovat s fotoaparáty s vestavěným ověřováním v roce 2024, spolu s vodoznakem videa později v témže roce.

Cílem je podle Nikkei poskytnout fotoreportérům, profesionálům v médiích a umělcům nezvratný důkaz důvěryhodnosti jejich snímků. Podpisy odolné proti manipulaci nezmizí ani po úpravách a měly by pomoci v boji proti dezinformacím a podvodnému používání fotografií na internetu.

Na podporu tohoto cíle společnosti spolupracovaly na otevřeném standardu pro interoperabilní digitální podpisy s názvem „Verify“. Po jeho zavedení bude možné fotografie pořízené pomocí vhodného hardwaru bezplatně kontrolovat online, aby lidé mohli určit, zda je fotografie pravá, či nikoli.

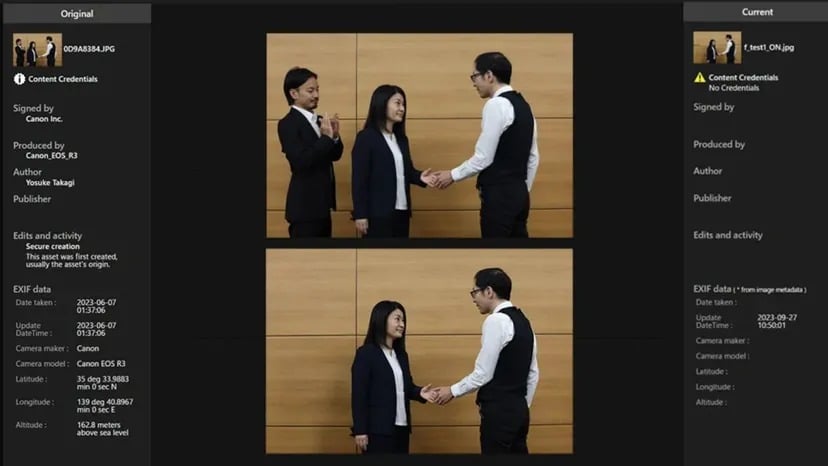

Pokud se fotografie vytvořená umělou inteligencí pokusí projít systémem Verify bez autentického podpisu, bude označena jako „Bez ověření obsahu“

Zdroj: Canon

Namísto zpětného označování obsahu AI plán přímo ověřuje skutečné fotografie v místě jejich vzniku. Stejně jako u každého jiného systému vodoznaků však bude jeho úspěch záviset na širokém přijetí (více výrobců hardwaru tento standard začlení) a časově odolné implementaci (kód se bude vyvíjet tak, aby zůstal nenabouratelný).

Jak uvedl TCN, nedávný výzkum naznačuje, že techniky proti vodoznakům by mohly také ohrozit vložené podpisy, čímž by se současné metody vodoznaků staly nepoužitelnými. Tím se však obrázky s vodoznakem stávají pouze nevodoznakovými, takže lidé mají méně nástrojů k odhalení jejich umělosti.

Techniky proti vodoznakům by sice mohly potenciálně odstranit podpisy pravosti ze skutečných fotografií, to je však méně problematické než odstranění vodoznaků z falešných snímků generovaných umělou inteligencí. Proč? Pokud je z deepfake snímku vytvořeného umělou inteligencí odstraněn vodoznak, umožňuje to podvrženému obsahu snáze projít jako pravý. Pokud jsou však autentizační podpisy vylomeny ze skutečných fotografií, zbývající obraz je stále zachycen fotoaparátem – nepochází z generativního modelu. I když ztratí kryptografický důkaz, základní obsah je stále pravý.

Primární riziko v tomto případě souvisí s atribucí a správou práv, nikoli s pravdivostí obsahu. Obrázek může být chybně připsán nebo použit bez řádné licence, ale ze své podstaty nezavádí diváky v omyl ohledně skutečnosti, kterou představuje

Společnost OpenAI nedávno oznámila hloubkový detektor padělků poháněný umělou inteligencí, který podle ní dosahuje 99% přesnosti u obrázků. Detektory umělé inteligence však zůstávají nedokonalé a musí se neustále modernizovat, aby předstihly vývoj generativní technologie.

Nedávný nárůst sofistikovanosti deepfake skutečně upozornil na nutnost takových strategií. Jak jsme viděli v roce 2023, potřeba rozlišovat mezi skutečným a vymyšleným obsahem nebyla nikdy akutnější. Politici i technologičtí vývojáři se snaží najít životaschopná řešení, takže malou pomoc těchto společností jistě oceníme.