По мере распространения в Интернете реалистичных фотографий и видео, сгенерированных искусственным интеллектом, технологические компании и группы защитников прав потребителей стремятся разработать инструменты для выявления поддельного контента.

В качестве одного из распространенных решений предлагается накладывать водяные знаки на сгенерированные компьютером изображения, добавляя невидимый флаг в виде скрытых метаданных, которые помогают определить, что изображение было создано с помощью инструмента генеративного ИИ. Но исследователи обнаружили, что у такого водяного знака есть один существенный недостаток: недоброжелательные техники могут легко его удалить.

Теперь крупные производители фотоаппаратов предлагают другой подход — в некотором смысле противоположный: встраивать водяные знаки в «настоящие» фотографии.

Компании Nikon, Sony и Canon недавно объявили о совместной инициативе по включению цифровых подписей в изображения, сделанные прямо с их высококлассных беззеркальных камер. По данным Nikkei Asia, подписи будут включать в себя такие ключевые метаданные, как дата, время, местоположение GPS и данные о фотографе, криптографически удостоверяя цифровое происхождение каждой фотографии.

Компания Nikon заявила, что запустит эту функцию в своей предстоящей линейке профессиональных беззеркальных камер; Sony выпустит обновления прошивки для установки цифровых подписей в свои нынешние беззеркальные камеры; а Canon намерена выпустить камеры со встроенной функцией аутентификации в 2024 году, а также в том же году выпустить водяной знак для видео.

Цель, как сообщает Nikkei, — предоставить фотожурналистам, работникам СМИ и художникам неопровержимые доказательства достоверности их снимков. Устойчивые к взлому подписи не исчезают при редактировании и должны помочь в борьбе с дезинформацией и мошенничеством при использовании фотографий в Интернете.

Для этого компании совместно разработали открытый стандарт для совместимых цифровых подписей под названием «Verify». После введения этого стандарта фотографии, сделанные с помощью соответствующего оборудования, можно будет бесплатно проверять в Интернете, чтобы люди могли определить, является ли фотография подлинной.

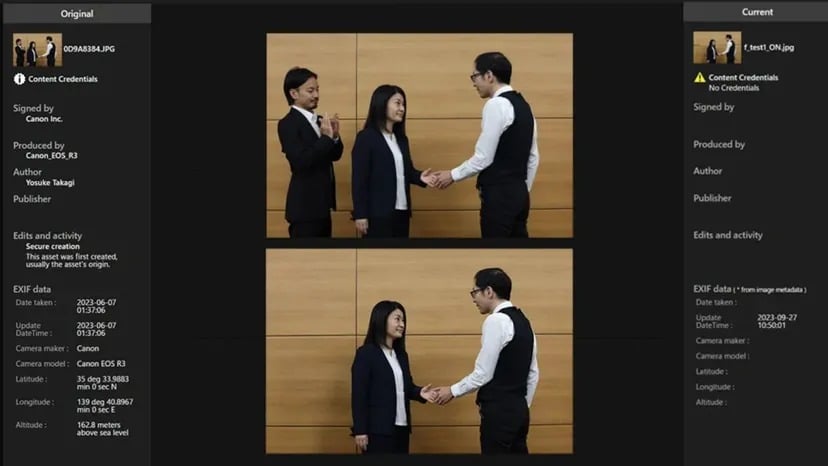

Если сгенерированная ИИ фотография попытается пройти систему Verify без подлинной подписи, она будет помечена как «No Content Credentials. «

Источник: Canon

Вместо того чтобы задним числом маркировать контент AI, план напрямую проверяет подлинность реальных фотографий на момент их создания. Но, как и любая другая система водяных знаков, ее успех будет зависеть от широкого распространения (больше производителей аппаратного обеспечения внедряют стандарт) и надежной реализации (код эволюционирует, чтобы оставаться невзламываемым).

Как сообщает TCN, последние исследования показывают, что методы защиты от водяных знаков также могут скомпрометировать встроенные подписи, делая текущие методы водяных знаков бесполезными. Однако это лишь делает изображения без водяных знаков, так что у людей остается меньше инструментов для обнаружения их искусственности.

Хотя методы защиты от водяных знаков потенциально могут удалить подписи подлинности с настоящих фотографий, это менее проблематично, чем удаление водяных знаков с поддельных изображений, сгенерированных искусственным интеллектом. Почему? Если водяной знак удаляется с глубокой подделки, созданной ИИ, это позволяет поддельным материалам легче выдаваться за настоящие. Однако если с реальных фотографий срываются подписи аутентификации, оставшееся изображение все равно снимается камерой — оно не создается генеративной моделью. Хотя оно и теряет криптографическое доказательство, лежащий в его основе контент все равно остается подлинным.

Основной риск в этом случае связан с атрибуцией и управлением правами, а не с достоверностью контента. Изображение может быть неверно атрибутировано или использовано без надлежащего лицензирования, но оно не вводит зрителей в заблуждение относительно реальности, которую оно представляет.

Недавно компания OpenAI объявила о создании глубокого детектора фальшивок на основе искусственного интеллекта, который, по ее утверждению, работает с точностью 99 % на изображениях. Тем не менее, детекторы ИИ остаются несовершенными и нуждаются в постоянной модернизации, чтобы опередить развитие генеративных технологий.

Недавний всплеск изощренности глубоких подделок действительно пролил свет на необходимость таких стратегий. Как мы увидели в 2023 году, необходимость различать реальный и сфабрикованный контент еще никогда не была столь острой. Как политики, так и разработчики технологий пытаются найти эффективные решения, поэтому небольшая помощь со стороны этих компаний, несомненно, будет оценена по достоинству.