À medida que as fotografias e vídeos realistas gerados por IA proliferam na Internet, as empresas de tecnologia e os grupos de vigilância estão a tentar desenvolver ferramentas para identificar conteúdos falsos.

A colocação de marcas de água em imagens geradas por computador é uma solução comummente proposta, acrescentando uma bandeira invisível sob a forma de metadados ocultos que ajudam a revelar que uma imagem foi criada utilizando uma ferramenta de IA generativa. Mas os investigadores descobriram que esse tipo de marca de água tem uma grande falha: as técnicas adversárias podem removê-la facilmente.

Agora, os principais fabricantes de câmaras estão a propor uma abordagem diferente – o oposto, de certa forma: incorporar marcas de água em fotografias “reais”.

A Nikon, a Sony e a Canon anunciaram recentemente uma iniciativa conjunta para incluir assinaturas digitais em imagens tiradas diretamente das suas câmaras mirrorless topo de gama. De acordo com o Nikkei Asia, as assinaturas integrarão metadados importantes como a data, a hora, a localização GPS e os dados do fotógrafo, certificando criptograficamente a origem digital de cada fotografia.

A Nikon afirmou que irá lançar esta funcionalidade na sua próxima linha de câmaras profissionais sem espelho; a Sony irá emitir actualizações de firmware para inserir assinaturas digitais nas suas actuais câmaras sem espelho; e a Canon pretende estrear câmaras com autenticação integrada em 2024, juntamente com marcas de água em vídeo no final desse ano.

O objetivo, segundo o Nikkei, é fornecer aos fotojornalistas, profissionais da comunicação social e artistas uma prova irrefutável da credibilidade das suas imagens. As assinaturas invioláveis não desaparecem com as edições e deverão ajudar a combater a desinformação e a utilização fraudulenta de fotografias online.

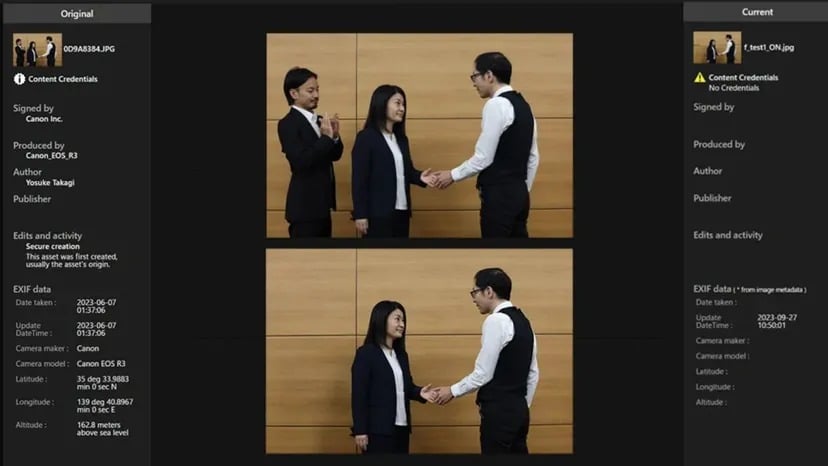

Para o efeito, as empresas colaboraram numa norma aberta para assinaturas digitais interoperáveis denominada “Verify”. Uma vez implementada, as fotografias tiradas com hardware adequado poderão ser verificadas online gratuitamente para que as pessoas possam determinar se uma fotografia é autêntica ou não.

Se uma fotografia gerada por IA tentar passar o sistema Verify sem uma assinatura autêntica, é marcada como “Sem Credenciais de Conteúdo”.

Fonte: Canon

Em vez de marcar retroativamente o conteúdo de IA, o plano autentica diretamente as fotografias reais na origem. Mas, como qualquer outro sistema de marca d’água, seu sucesso dependerá da adoção generalizada (mais fabricantes de hardware incorporam o padrão) e de uma implementação à prova de tempo (o código evolui para permanecer inviolável).

Tal como o TCN noticiou, uma investigação recente indica que as técnicas anti-marcação de água podem também comprometer as assinaturas incorporadas, tornando inúteis os actuais métodos de marca de água. No entanto, isto apenas faz com que as imagens com marcas de água deixem de ter marcas de água, pelo que as pessoas têm menos ferramentas para detetar a sua artificialidade.

Embora as técnicas anti-marca d’água possam potencialmente remover assinaturas de autenticidade de fotos reais, isso é menos problemático do que remover marcas d’água de imagens falsas geradas por IA. Porquê? Se uma marca de água for removida de um deepfake de IA, permite que o conteúdo forjado passe por real mais facilmente. No entanto, se as assinaturas de autenticação forem retiradas de fotografias reais, a imagem restante continua a ser capturada por uma câmara – não tem origem num modelo generativo. Embora perca a sua prova criptográfica, o conteúdo subjacente continua a ser genuíno.

O principal risco neste caso está relacionado com a atribuição e gestão de direitos, e não com a veracidade do conteúdo. A imagem pode ser mal creditada ou utilizada sem a devida licença, mas não engana inerentemente os espectadores sobre a realidade que representa

A OpenAI anunciou recentemente um detetor de deepfake alimentado por IA que afirma ter 99% de precisão nas imagens. No entanto, os detectores de IA continuam a ser imperfeitos e têm de ser constantemente actualizados para ultrapassarem a evolução da tecnologia generativa.

O recente aumento da sofisticação dos deepfake veio, de facto, chamar a atenção para a necessidade de tais estratégias. Como vimos em 2023, a necessidade de distinguir entre conteúdos reais e fabricados nunca foi tão premente. Tanto os políticos como os criadores de tecnologia estão a esforçar-se por encontrar soluções viáveis, pelo que uma pequena ajuda destas empresas será certamente apreciada.