Dopo essere rimasta in disparte per la maggior parte dell’anno scorso, Apple sta iniziando a smuovere le acque nel campo dell’intelligenza artificiale e in particolare dell’IA open-source.

Il gigante tecnologico di Cupertino ha stretto una partnership con l’Università di Santa Barbara per sviluppare un modello di intelligenza artificiale in grado di modificare le immagini in base al linguaggio naturale, nello stesso modo in cui le persone interagiscono con ChatGPT. Apple lo chiama Multimodal Large-Language Model-Guided Image Editing (MGIE).

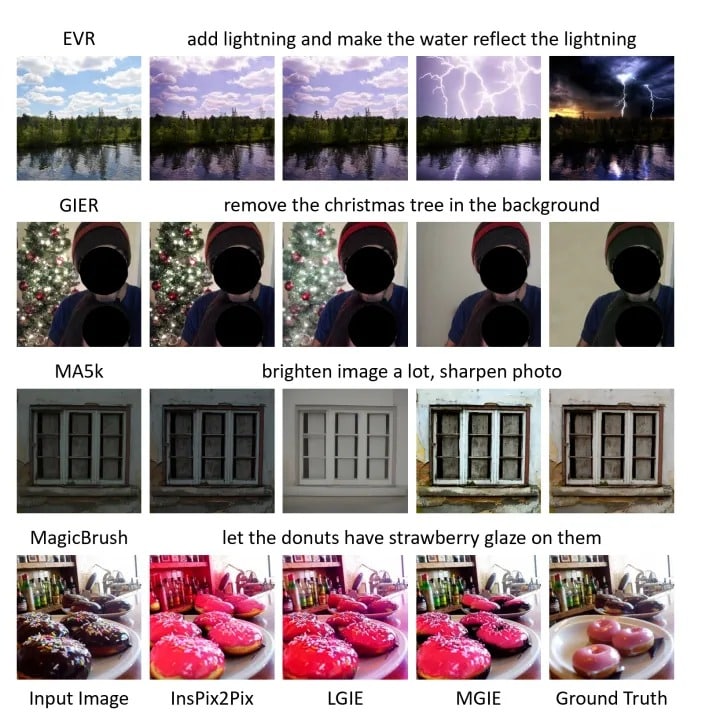

MGIE interpreta le istruzioni testuali fornite dagli utenti, le elabora e le perfeziona per generare precisi comandi di modifica delle immagini. L’integrazione di un modello di diffusione migliora il processo, consentendo a MGIE di applicare le modifiche in base alle caratteristiche dell’immagine originale.

I modelli linguistici multimodali (MLLM), che possono elaborare sia testo che immagini, costituiscono la base del metodo MGIE. A differenza delle tradizionali IA monomodali che si concentrano solo su testo o immagini, gli MLLM possono elaborare istruzioni complesse e lavorare in una gamma più ampia di situazioni. Ad esempio, un modello può comprendere un’istruzione testuale, analizzare gli elementi di una foto specifica, quindi togliere qualcosa dall’immagine e creare una nuova foto senza quell’elemento.

Per eseguire queste azioni, un sistema di IA deve disporre di diverse capacità, tra cui testo generativo, immagine generativa, segmentazione e analisi CLIP, tutte nello stesso processo.

L’introduzione di MGIE avvicina Apple al raggiungimento di capacità simili a ChatGPT Plus di OpenAI, che consente agli utenti di interagire in modo conversazionale con i modelli di IA per creare immagini personalizzate sulla base di input testuali. Con MGIE, gli utenti possono fornire istruzioni dettagliate in linguaggio naturale – “rimuovi il cono stradale in primo piano” – che vengono tradotte in comandi di modifica dell’immagine ed eseguite.

In altre parole, gli utenti possono partire da una foto di una persona bionda e trasformarla in una persona rossa semplicemente dicendo “rendi questa persona una rossa”. Il modello comprende l’istruzione, segmenta i capelli della persona, genera un comando del tipo “capelli rossi, altamente dettagliati, fotorealistici, tono zenzero” e poi esegue le modifiche tramite inpainting.

L’approccio di Apple si allinea a strumenti esistenti come Stable Diffusion, che può essere integrato con un’interfaccia rudimentale per l’editing di immagini guidato dal testo. Sfruttando strumenti di terze parti come Pix2Pix, gli utenti possono interagire con l’interfaccia di Stable Diffusion utilizzando comandi in linguaggio naturale, assistendo agli effetti in tempo reale sulle immagini modificate.

L’approccio di Apple, tuttavia, si dimostra più accurato di qualsiasi altro metodo simile.

Risultati della modifica di un’immagine con il linguaggio naturale utilizzando Instruct Pix2Pic, LGIE, MGIE di Apple e Ground Truth Image: Apple

Oltre all’intelligenza artificiale generativa, Apple MGIE è in grado di eseguire altre attività convenzionali di editing delle immagini, come la gradazione del colore, il ridimensionamento, le rotazioni, le modifiche allo stile e gli schizzi.

Perché Apple dovrebbe renderlo open source?

Le incursioni open source di Apple sono una chiara mossa strategica, con una portata che va oltre i semplici requisiti di licenza.

Per costruire MGIE, Apple utilizza modelli open source come Llava e Vicuna. A causa dei requisiti di licenza di questi modelli, che limitano l’uso commerciale da parte delle grandi aziende, Apple è stata probabilmente costretta a condividere apertamente i suoi miglioramenti su GitHub.

Ma questo permette anche ad Apple di sfruttare un pool mondiale di sviluppatori nel tentativo di aumentare la propria forza e flessibilità. Questo tipo di collaborazione fa progredire le cose molto più velocemente di quanto non faccia Apple lavorando completamente da sola e partendo da zero. Inoltre, questa apertura ispira un più ampio spettro di idee e attira diversi talenti tecnici, consentendo a MGIE di evolversi più rapidamente.

L’impegno di Apple nella comunità open-source con progetti come MGIE dà anche al marchio una spinta tra gli sviluppatori e gli appassionati di tecnologia. Questo aspetto non è un segreto, visto che Meta e Microsoft investono entrambi pesantemente nell’IA open-source.

È possibile che il rilascio di MGIE come software open-source dia ad Apple un vantaggio nella definizione di standard industriali ancora in evoluzione per l’IA e in particolare per l’editing di immagini basato sull’IA. Con MGIE, Apple ha probabilmente fornito agli artisti e agli sviluppatori dell’IA una solida base con cui costruire la prossima grande cosa, fornendo maggiore precisione ed efficienza rispetto a quanto disponibile altrove.

MGIE migliorerà certamente i prodotti Apple: non sarebbe troppo difficile sintetizzare un comando vocale inviato a Siri e utilizzare quel testo per modificare una foto sullo smartphone, sul computer o sulle cuffie innersive dell’utente.

Gli sviluppatori di intelligenza artificiale tecnicamente esperti possono utilizzare MGIE fin da ora. Basta visitare il repository GitHub del progetto.