Después de permanecer aparentemente al margen durante la mayor parte del año pasado, Apple está empezando a agitar las cosas en el campo de la inteligencia artificial, y de la IA de código abierto en particular.

El gigante tecnológico de Cupertino se ha asociado con la Universidad de Santa Bárbara para desarrollar un modelo de IA capaz de editar imágenes basándose en el lenguaje natural, del mismo modo que las personas interactúan con ChatGPT. Apple lo llama Multimodal Large-Language Model-Guided Image Editing (MGIE).

MGIE interpreta las instrucciones de texto proporcionadas por los usuarios, procesándolas y refinándolas para generar órdenes precisas de edición de imágenes. La integración de un modelo de difusión mejora el proceso y permite a MGIE aplicar ediciones basadas en las características de la imagen original.

Los modelos multimodales de gran lenguaje (MLLM), que pueden procesar tanto texto como imágenes, constituyen la base del método MGIE. A diferencia de las IA monomodales tradicionales, centradas únicamente en texto o imágenes, los MLLM pueden procesar instrucciones complejas y trabajar en una gama más amplia de situaciones. Por ejemplo, un modelo puede entender una instrucción de texto, analizar los elementos de una foto concreta y, a continuación, sacar algo de la imagen y crear una nueva foto sin ese elemento.

Para realizar estas acciones, un sistema de IA debe tener distintas capacidades, como texto generativo, imagen generativa, segmentación y análisis CLIP, todo en el mismo proceso.

La introducción de MGIE acerca a Apple a la consecución de capacidades similares a ChatGPT Plus de OpenAI, que permiten a los usuarios entablar interacciones conversacionales con modelos de IA para crear imágenes personalizadas basadas en la introducción de texto. Con MGIE, los usuarios pueden dar instrucciones detalladas en lenguaje natural – «quita el cono de tráfico del primer plano»- que se traducen en comandos de edición de imágenes y se ejecutan.

En otras palabras, los usuarios pueden empezar con una foto de una persona rubia y convertirla en pelirroja con sólo decir: «haz que esta persona sea pelirroja». Bajo el capó, el modelo entendería la instrucción, segmentaría el pelo de la persona, generaría un comando como «pelo rojo, muy detallado, fotorrealista, tono pelirrojo» y luego ejecutaría los cambios mediante inpainting.

El planteamiento de Apple se alinea con herramientas existentes como Stable Diffusion, a la que se puede añadir una interfaz rudimentaria para la edición de imágenes guiada por texto. Aprovechando herramientas de terceros como Pix2Pix, los usuarios pueden interactuar con la interfaz de Stable Diffusion mediante comandos de lenguaje natural y ver los efectos en tiempo real sobre las imágenes editadas.

Sin embargo, el enfoque de Apple ha demostrado ser más preciso que cualquier otro método similar.

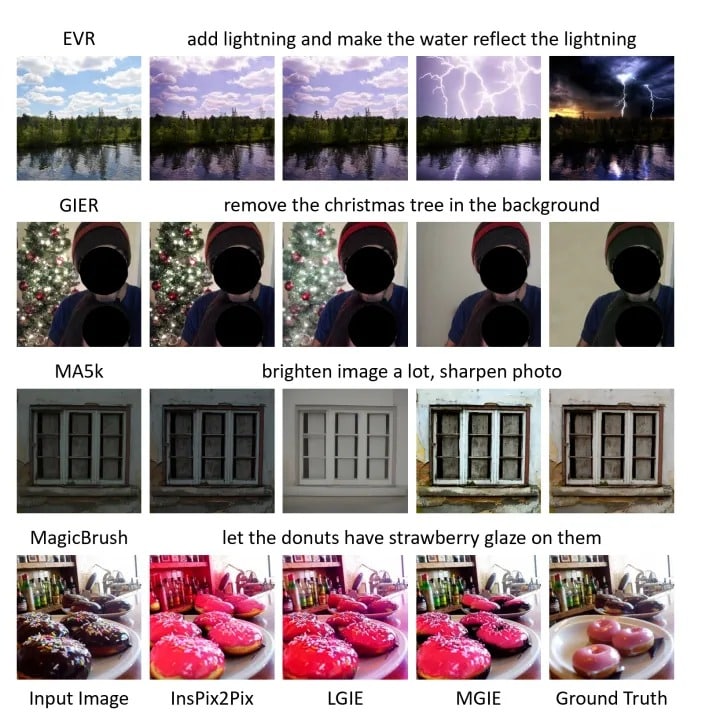

Resultados de la edición de una imagen con lenguaje natural utilizando Instruct Pix2Pic, LGIE, MGIE de Apple y Ground Truth Image: Apple

Además de la IA generativa, el MGIE de Apple puede realizar otras tareas convencionales de edición de imágenes como etalonaje, cambio de tamaño, rotaciones, cambios de estilo y esbozos.

¿Por qué Apple lo haría de código abierto?

Las incursiones de Apple en el código abierto son un claro movimiento estratégico, con un alcance que va más allá de los meros requisitos de licencia.

Para construir MGIE, Apple utiliza modelos de código abierto como Llava y Vicuna. Debido a los requisitos de licencia de estos modelos, que limitan el uso comercial por parte de las grandes empresas, es probable que Apple se viera obligada a compartir sus mejoras abiertamente en GitHub.

Pero esto también permite a Apple aprovechar un grupo mundial de desarrolladores en un intento de aumentar su fuerza y flexibilidad. Este tipo de colaboración hace que las cosas avancen mucho más rápido que si Apple trabajara por su cuenta y empezara desde cero. Además, esta apertura inspira un espectro más amplio de ideas y atrae a diversos talentos técnicos, lo que permite a MGIE evolucionar con mayor rapidez.

La participación de Apple en la comunidad de código abierto con proyectos como MGIE también da a la marca un impulso entre los desarrolladores y los entusiastas de la tecnología. Este aspecto no es ningún secreto, ya que tanto Meta como Microsoft invierten mucho en IA de código abierto.

Es posible que la publicación de MGIE como software de código abierto dé a Apple una ventaja a la hora de establecer estándares industriales aún en evolución para la IA y la edición de imágenes basada en IA en particular. Con MGIE, es probable que Apple haya proporcionado a los artistas y desarrolladores de IA una base sólida con la que construir el próximo gran avance, proporcionando más precisión y eficacia que lo que hay disponible en otros lugares.

MGIE mejorará sin duda los productos de Apple: no sería demasiado difícil sintetizar una orden de voz enviada a Siri y utilizar ese texto para editar una foto en el smartphone, el ordenador o los auriculares innersivos del usuario.

Los desarrolladores de IA con conocimientos técnicos ya pueden utilizar MGIE. Basta con visitar el repositorio GitHub del proyecto.