Après avoir semblé se tenir à l’écart la majeure partie de l’année dernière, Apple commence à faire bouger les choses dans le domaine de l’intelligence artificielle – et de l’IA open-source en particulier.

Le géant technologique de Cupertino s’est associé à l’université de Santa Barbara pour développer un modèle d’IA capable de modifier des images en se basant sur le langage naturel, de la même manière que les gens interagissent avec ChatGPT. Apple l’appelle Multimodal Large-Language Model-Guided Image Editing (MGIE) (Édition d’images guidée par un modèle multimodal à langage étendu).

MGIE interprète les instructions textuelles fournies par les utilisateurs, les traite et les affine pour générer des commandes d’édition d’images précises. L’intégration d’un modèle de diffusion améliore le processus, permettant à MGIE d’appliquer des modifications basées sur les caractéristiques de l’image originale.

Les modèles multimodaux à grand langage (MLLM), qui peuvent traiter à la fois du texte et des images, constituent la base de la méthode MGIE. Contrairement aux IA traditionnelles à mode unique qui se concentrent uniquement sur le texte ou les images, les MLLM peuvent traiter des instructions complexes et travailler dans un plus grand nombre de situations. Par exemple, un modèle peut comprendre une instruction textuelle, analyser les éléments d’une photo spécifique, puis retirer un élément de l’image et en créer une nouvelle sans cet élément.

Pour réaliser ces actions, un système d’IA doit disposer de différentes capacités, notamment la génération de texte, la génération d’image, la segmentation et l’analyse CLIP, le tout au cours du même processus.

L’introduction de MGIE rapproche Apple de capacités similaires à celles de ChatGPT Plus d’OpenAI, permettant aux utilisateurs d’engager des interactions conversationnelles avec des modèles d’IA pour créer des images personnalisées sur la base d’une saisie de texte. Avec MGIE, les utilisateurs peuvent fournir des instructions détaillées en langage naturel – « enlever le cône de signalisation au premier plan » – qui sont traduites en commandes d’édition d’images et exécutées.

En d’autres termes, l’utilisateur peut partir d’une photo d’une personne blonde et la transformer en rousse en disant simplement « faites de cette personne une rousse ». Sous le capot, le modèle comprendrait l’instruction, segmenterait les cheveux de la personne, générerait une commande telle que « cheveux roux, très détaillé, photoréaliste, ton roux », puis exécuterait les modifications via l’inpainting.

L’approche d’Apple s’aligne sur des outils existants tels que Stable Diffusion, qui peut être complété par une interface rudimentaire pour l’édition d’images guidée par le texte. Grâce à des outils tiers tels que Pix2Pix, les utilisateurs peuvent interagir avec l’interface de Stable Diffusion à l’aide de commandes en langage naturel et observer les effets en temps réel sur les images modifiées.

L’approche d’Apple s’avère toutefois plus précise que toute autre méthode similaire.

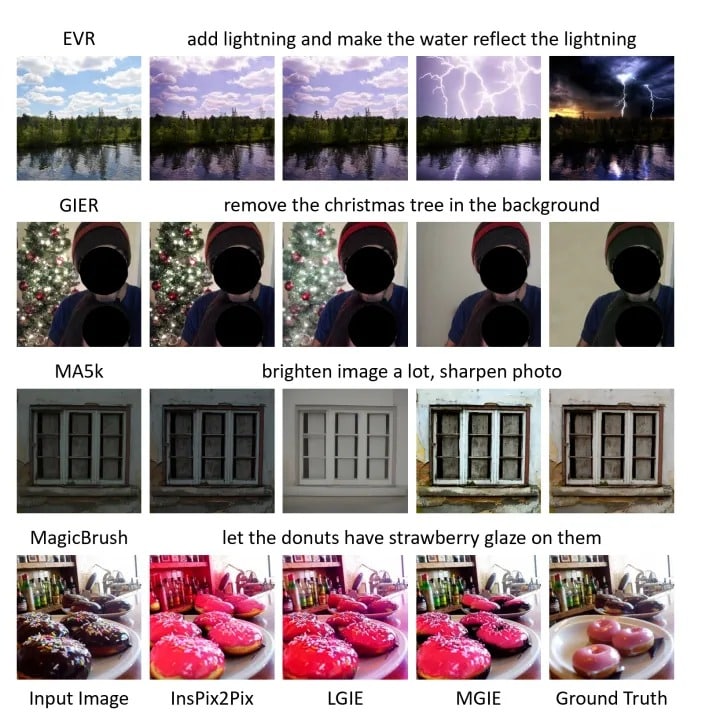

Résultats de l’édition d’une image en langage naturel avec Instruct Pix2Pic, LGIE, MGIE d’Apple et Ground Truth Image : Apple

Outre l’IA générative, le MGIE d’Apple peut effectuer d’autres tâches d’édition d’images conventionnelles telles que l’étalonnage des couleurs, le redimensionnement, les rotations, les changements de style et les croquis.

Pourquoi Apple le rendrait-il open source?

Les incursions d’Apple dans le domaine des logiciels libres constituent une démarche stratégique évidente, dont la portée dépasse les simples exigences en matière de licence.

Pour construire le MGIE, Apple utilise des modèles open-source tels que Llava et Vicuna. En raison des conditions de licence de ces modèles, qui limitent l’utilisation commerciale par les grandes entreprises, Apple a probablement été contraint de partager ouvertement ses améliorations sur GitHub.

Mais cela permet également à Apple de tirer parti d’un pool mondial de développeurs dans le but d’accroître sa force et sa flexibilité. Ce type de collaboration fait avancer les choses bien plus rapidement qu’Apple ne le ferait en travaillant seul et en repartant de zéro. En outre, cette ouverture inspire un plus large éventail d’idées et attire des talents techniques divers, ce qui permet à MGIE d’évoluer plus rapidement.

L’engagement d’Apple dans la communauté des logiciels libres avec des projets tels que MGIE donne également un coup de pouce à la marque auprès des développeurs et des passionnés de technologie. Cet aspect n’est pas un secret, Meta et Microsoft investissant tous deux massivement dans l’IA open-source.

Il est possible que la publication de MGIE en tant que logiciel libre donne à Apple une longueur d’avance dans l’établissement de normes industrielles encore en évolution pour l’IA et la retouche d’images basée sur l’IA en particulier. Avec MGIE, Apple a probablement donné aux artistes et aux développeurs de l’IA une base solide sur laquelle construire la prochaine grande chose, en fournissant plus de précision et d’efficacité que ce qui est disponible ailleurs.

MGIE permettra certainement d’améliorer les produits Apple : il ne serait pas trop difficile de synthétiser une commande vocale envoyée à Siri et d’utiliser ce texte pour modifier une photo sur le smartphone, l’ordinateur ou le casque innersive de l’utilisateur.

Les développeurs d’IA techniquement avertis peuvent utiliser MGIE dès à présent. Il suffit de visiter le dépôt GitHub du projet.