Model umělé inteligence (AI) vyvinutý v Číně vyvolává vlny na několika frontách, včetně jeho otevřenosti a schopnosti zpracovat až 200 000 tokenů kontextu – což výrazně převyšuje jiné populární modely, jako je Claude od Anthropicu (100 000 tokenů) nebo GPT-4 Turbo od OpenAI (128 000 tokenů).

Tento progresivní generativní chatbot, označovaný jako řada Yi, vytvořila společnost Beijing Lingyi Wanwu Information Technology Company ve své laboratoři umělé inteligence 01.AI. Velký jazykový model (LLM) se dodává ve dvou verzích: odlehčený Yi-6B-200K a robustnější Yi-34B-200K, přičemž oba jsou schopny zachovat obrovský kontext konverzace a rozumí angličtině a mandarínštině.

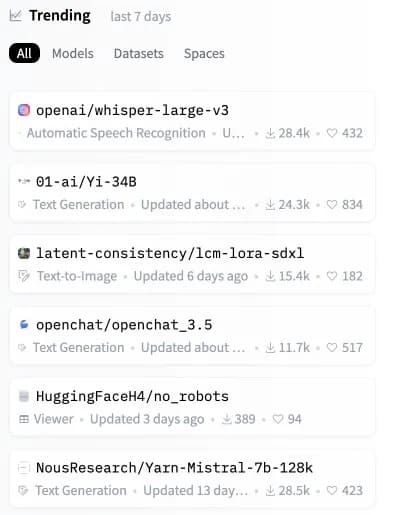

Jen několik hodin po svém vydání se model Yi vyšplhal v žebříčcích nahoru a stal se druhým nejoblíbenějším modelem s otevřeným zdrojovým kódem na portálu Hugging Face, klíčovém úložišti pro modely umělé inteligence.

Obrázek: Hugging Face

Přestože modely Yi zvládají obrovské kontextové podněty, jsou také velmi efektivní a přesné a v několika syntetických benchmarcích překonávají jiné modely LLM.

„Yi-34B překonává mnohem větší modely, jako jsou LLaMA2-70B a Falcon-180B; také velikost Yi-34B může nákladově efektivně podporovat aplikace, čímž umožňuje vývojářům vytvářet fantastické projekty,“ vysvětluje 01.AI na svých webových stránkách. Podle výsledkové tabulky, kterou vývojáři sdílejí, vykazuje nejvýkonnější model Yi silný výkon v porozumění čtenému textu, uvažování zdravým rozumem a běžných testech AI, jako jsou Gaokao a C-eval.

Velké jazykové modely (LLM), jako je řada Yi, fungují tak, že analyzují a generují výstupy založené na jazyce. Pracují na základě zpracování „tokenů“ neboli jednotek textu, které mohou být tak malé jako slovo nebo jeho část.

Říci „200 tisíc tokenů kontextu“ v praxi znamená, že model dokáže porozumět a reagovat na podstatně delší podněty, které by dříve zahltily i ty nejpokročilejší LLM. Řada Yi si poradí s rozsáhlými podněty, které obsahují složitější a podrobnější informace, aniž by došlo k pádu.

Nedávná analýza třetí strany však poukazuje na omezení v této oblasti. Pokud výzva zabírá více než 65 % kapacity modelu Yi, může mít problém získat přesné informace. Navzdory tomu, pokud je velikost výzvy udržována hluboko pod touto hranicí, model řady Yi funguje obdivuhodně, a to i ve scénářích, které způsobují degradaci u modelů jako Claude a ChatGPT.

Tlakové testování GPT-4-128K s dlouhou kontextovou pamětí

128K tokenů kontextu je úžasné – ale jaký je výkon?

Chtěl jsem to zjistit, a tak jsem provedl analýzu „jehly v kupce sena“.

Některé očekávané (a neočekávané) výsledky

Tady je to, co jsem zjistil:

Zjištění:

pic.twitter.com/nHMokmfhW5– Greg Kamradt (@GregKamradt) November 8, 2023

Klíčovým rozdílem Yi je, že je plně otevřený, což uživatelům umožňuje spouštět Yi lokálně na vlastních systémech. To jim poskytuje větší kontrolu, možnost upravovat architekturu modelu a vyhnout se závislosti na externích serverech.

„Předpokládáme, že AI 2.0 vytvoří příležitost pro platformu desetkrát větší než mobilní internet, která přepíše veškerý software a uživatelská rozhraní,“ uvádí 01.AI. „Tento trend dá vzniknout další vlně aplikací založených na AI a obchodních modelů s podporou AI, což časem podpoří inovace AI 2.0.“

Otevřením takto schopného modelu dává 01.AI vývojářům po celém světě možnost vytvářet novou generaci AI. Díky obrovské kontextové manipulaci v přizpůsobitelném balíčku můžeme očekávat příval inovativních aplikací využívajících Yi.

Potenciál modelů s otevřeným zdrojovým kódem, jako jsou Yi-6B-200K a Yi-34B-200K, je obrovský. S tím, jak umělá inteligence proniká do našich životů, slibují lokálně provozované systémy větší transparentnost, bezpečnost a přizpůsobitelnost ve srovnání s uzavřenými alternativami závislými na cloudu.

Zatímco Claude a GPT-4 Turbo zaujmou na titulních stranách novin, tato nová open-source alternativa může brzy vybudovat další stupeň AI přímo v zařízeních uživatelů. Když už se zdálo, že nám nezbývají žádné další možnosti, jak upgradovat náš hardware, je možná načase pořídit si schopnější zařízení, než zjistíte, že vaši místní AI překonává „kontextově uvědomělejší“ konkurent.