Gemeenschappelijke controles om financiële fraude te bestrijden – anti-witwasmaatregelen (AML) en KYC-vereisten (know-your-customer) – hebben misschien hun gelijke gevonden in AI.

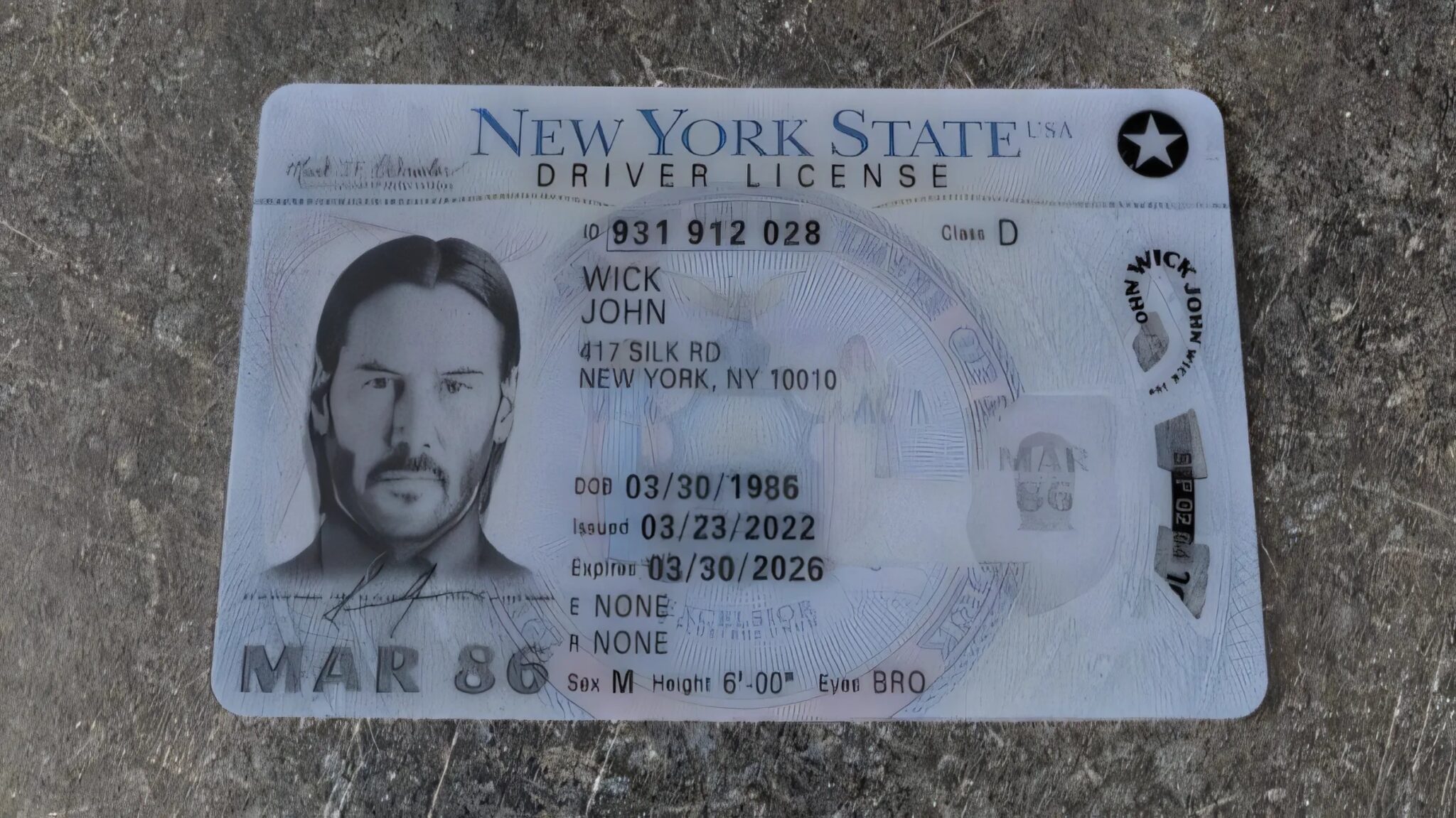

Een ondergrondse dienst met de naam OnlyFake maakt gebruik van “neurale netwerken” om hoogwaardige valse ID’s te maken en volgens een rapport van 404 Media kan iedereen voor slechts $15 direct gegenereerde valse ID’s krijgen met een verrassend realisme, waardoor mogelijk een reeks illegale activiteiten mogelijk wordt.

Het oorspronkelijke OnlyFake Telegram-account, het primaire klantgerichte platform, werd gesloten. Maar het nieuwe account verklaart het einde van het Photoshop-tijdperk en pocht met de mogelijkheid om massaal documenten te produceren met behulp van geavanceerde “generatoren”.

De eigenaar van de site, die het alias John Wick gebruikt, zegt dat de service honderden documenten kan genereren uit een Excel dataset.

De afbeeldingen zijn zo goed dat 404 Media in staat was om langs de KYC-maatregelen van OKX te komen, een cryptocurrency exchange die de verificatiedienst van derden, Jumio, gebruikt om de documenten van zijn klanten te verifiëren. Een cyberbeveiligingsonderzoeker vertelde de nieuwsuitgever dat gebruikers OnlyFake ID’s opstuurden om bankrekeningen te openen en hun cryptorekeningen te laten deblokkeren.

Hoe het in zijn werk gaat

De OnlyFake-dienst maakt grotendeels gebruik van basale AI-technologie, zij het met veel verfijning.

Met behulp van Generative Adversarial Networks (GAN’s), een vorm van AI, kunnen ontwikkelaars een neuraal netwerk ontwerpen dat is geoptimaliseerd om te misleiden en een ander dat is gebouwd om nepgeneraties te detecteren. Met elke interactie evolueren beide netwerken echter en worden ze beter in het maken en detecteren van vervalsingen.

Een andere benadering is om een op diffusie gebaseerd model te trainen met een enorme, goed gecurateerde dataset van echte ID’s. Deze modellen zijn bedreven in het synthetiseren van echte ID’s. Deze modellen zijn bedreven in het synthetiseren van extreem realistische afbeeldingen door te trainen op enorme datasets van specifieke voorwerpen. Ze leren om minuscule details na te bootsen waardoor de vervalsingen bijna niet te onderscheiden zijn van authentieke documenten, waardoor ze traditionele detectiemethoden voor vervalsingen te slim af zijn.

Voor degenen die hun echte identiteit niet willen gebruiken, is OnlyFake waarschijnlijk verleidelijk. Maar de dienst gebruiken brengt zowel ethische als juridische vragen met zich mee. Onder het vernis van anonimiteit en de aantrekkingskracht van gemakkelijke toegang, staan deze operaties op zeer wankele grond.

De openlijk criminele onderneming heeft ongetwijfeld de aandacht getrokken van wetshandhavingsinstanties over de hele wereld, omdat het valse identiteitsbewijzen uit vele landen verstrekt, waaronder de VS, Italië, China, Rusland, Argentinië, Tsjechië en Canada.

Big Brother kan met andere woorden al meekijken.

De risico’s gaan verder dan dat. John Wick zou bijvoorbeeld een klantenlijst kunnen bijhouden, wat catastrofaal zou zijn voor OnlyFake en haar gebruikers. Daarnaast heeft de nieuwe OnlyFake Telegram-groep meer dan 600 leden, waarvan de meeste kunnen worden herleid naar hun gekoppelde telefoonnummers.

En hoewel het voor de hand ligt, moet worden vermeld dat het betalen van OnlyFake met traditionele digitale betaalmethoden een grote no go is.

Hoewel cryptocurrency betalingen een laag van privacy bieden, is het ook niet volledig veilig tegen het blootleggen van identiteit. Talloze diensten beweren cryptotransacties te kunnen volgen, waardoor digitale valuta de anonimiteit die ermee gepaard gaat beginnen te verliezen.

En nee, OnlyFake gebruikt de crypto privacy token Monero niet.

Het belangrijkste is dat de aankoop van een vals ID in directe tegenspraak is met het AML- en KYC-beleid, dat op zijn minst ogenschijnlijk is ingesteld om de financiering van terrorisme en andere criminele activiteiten tegen te gaan.

De zaken kunnen goed gaan, maar zijn de mogelijke gevolgen het snelle, betaalbare gemak waard?

Evoluerende regelgeving

Regelgeving

Regelgevers proberen deze nieuwe bedreiging al aan te pakken. Op 29 januari stelde het Amerikaanse Ministerie van Handel een reeks regels voor met de titel “Taking Additional Steps To Address the National Emergency With Respect to Significant Malicious Cyber-Enabled Activities”.

Het ministerie wil van infrastructuuraanbieders eisen dat ze melding maken van buitenlandse personen die proberen grote AI-modellen te trainen, ongeacht de reden – maar de focus ligt zeker op gevallen waarin deepfakes kunnen worden gebruikt voor fraude of spionage.

Deze maatregelen zijn misschien nog niet genoeg.

“De ondergang van KYC was onvermijdelijk nu AI valse ID’s maakt die door de verificaties heen komen,” zei Torsten Stüber, CTO van Satoshi Pay, op Twitter. “Het is tijd voor een verschuiving: Als strenge regelgeving een must is, moeten overheden verouderde bureaucratie overboord gooien voor cryptografische technologie, die veilige identiteitsverificatie door derden mogelijk maakt.”

Natuurlijk gaat het gebruik van AI in misleiding verder dan valse ID’s. Telegram-bots bieden nu diensten aan die variëren van aangepaste deepfake video’s, waarbij gezichten van personen over bestaande beelden worden gelegd, tot het creëren van niet-bestaande naaktfoto’s van mensen, bekend als deepnudes.

In tegenstelling tot eerdere diensten is hier niet veel kennis of zelfs krachtige hardware voor nodig, waardoor de technologie op grote schaal beschikbaar is zonder dat je zelfs maar gratis beeldbewerkingsprogramma’s hoeft te downloaden.