I controlli comuni per combattere le frodi finanziarie – le misure antiriciclaggio e i requisiti KYC (Know Your Customer) – potrebbero aver trovato il loro punto di incontro nell’intelligenza artificiale.

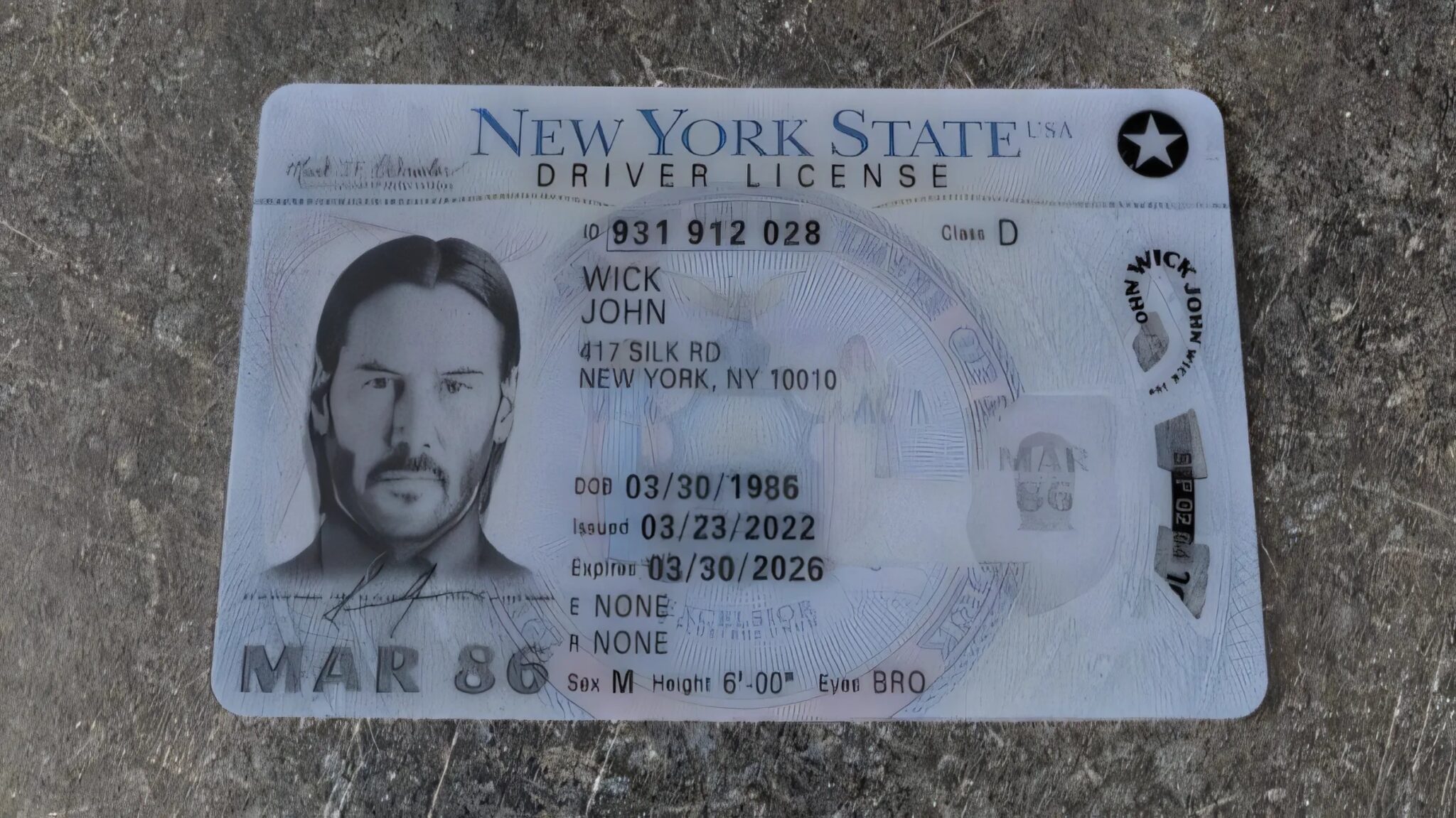

Un servizio clandestino chiamato OnlyFake sfrutta le “reti neurali” per creare documenti d’identità falsi di alta qualità e, secondo un rapporto di 404 Media, chiunque può ottenere documenti d’identità falsi generati istantaneamente con un realismo sorprendente per soli 15 dollari, facilitando potenzialmente una serie di attività illecite.

L’account Telegram originale di OnlyFake, la sua principale piattaforma di contatto con i clienti, è stato chiuso. Ma il nuovo account dichiara la fine dell’era di Photoshop, vantando la capacità di produrre in massa documenti utilizzando “generatori” avanzati.

Il proprietario del sito, che utilizza lo pseudonimo di John Wick, ha dichiarato che il servizio è in grado di generare in batch centinaia di documenti da un set di dati Excel.

Le immagini sono così buone che 404 Media è riuscita a superare le misure KYC di OKX, uno scambio di criptovalute che utilizza il servizio di verifica di terze parti Jumio per verificare i documenti dei propri clienti. Un ricercatore di cybersicurezza ha dichiarato all’agenzia di stampa che gli utenti stavano inviando ID falsi per aprire conti bancari e sbloccare i loro conti di criptovaluta.

Come si fa

Il servizio OnlyFake utilizza una tecnologia AI di base, anche se molto sofisticata.

Utilizzando le GAN (Generative Adversarial Networks), una forma di AI, gli sviluppatori possono progettare una rete neurale ottimizzata per ingannare un’altra costruita per rilevare le generazioni false. A ogni interazione, tuttavia, entrambe le reti si evolvono e migliorano nella creazione e nel rilevamento dei falsi.

Un altro approccio consiste nell’addestrare un modello basato sulla diffusione con una serie massiccia e ben curata di documenti d’identità reali. Questi modelli sono abili nel sintetizzare immagini estremamente realistiche addestrandosi su vasti set di dati di articoli specifici. Imparano a replicare i minimi dettagli che rendono i falsi quasi indistinguibili dai documenti autentici, superando i tradizionali metodi di rilevamento dei falsi.

Si dovrebbe rischiare?

Per chi vuole evitare di dover usare la propria identità reale, OnlyFake è probabilmente allettante. Ma l’utilizzo del servizio porta con sé questioni etiche e legali. Sotto l’apparenza di anonimato e l’attrattiva della facilità di accesso, queste operazioni poggiano su un terreno molto instabile.

Poiché distribuisce documenti d’identità falsi da molti Paesi – tra cui Stati Uniti, Italia, Cina, Russia, Argentina, Repubblica Ceca e Canada – l’impresa apertamente criminale ha indubbiamente attirato l’attenzione delle forze dell’ordine di tutto il mondo.

In altre parole, il Grande Fratello potrebbe già osservarci.

I rischi vanno oltre. John Wick, ad esempio, potrebbe conservare un elenco di clienti, il che sarebbe catastrofico per OnlyFake e i suoi utenti. Inoltre, il nuovo gruppo Telegram di OnlyFake conta oltre 600 membri, la maggior parte dei quali potrebbe essere rintracciata grazie ai numeri di telefono collegati.

E anche se è ovvio, va detto che pagare OnlyFake con i tradizionali metodi di pagamento digitali è un grande passo falso.

Anche se i pagamenti in criptovaluta offrono un livello di privacy, non sono del tutto sicuri dall’esposizione dell’identità. Innumerevoli servizi affermano di essere in grado di tracciare le transazioni in criptovaluta e quindi le valute digitali stanno iniziando a perdere l’anonimato ad esse associato.

E no, OnlyFake non accetta il token Monero.

Soprattutto, l’acquisto di un documento d’identità falso è in diretta contraddizione con le politiche AML e KYC, che sono almeno apparentemente in vigore per combattere il finanziamento del terrorismo e altre attività criminali.

Gli affari possono andare a gonfie vele, ma le possibili conseguenze valgono la comodità di un acquisto rapido e conveniente?

Regolamenti in evoluzione

Le autorità di regolamentazione stanno già cercando di affrontare questa nuova minaccia. Il 29 gennaio, il Dipartimento del Commercio degli Stati Uniti ha proposto una serie di norme intitolate “Taking Additional Steps To Address the National Emergency With Respect to Significant Malicious Cyber-Enabled Activities”.

Il dipartimento intende richiedere ai fornitori di infrastrutture di segnalare le persone straniere che cercano di addestrare modelli di IA di grandi dimensioni, indipendentemente dal motivo, ma certamente i casi in cui i deepfake potrebbero essere utilizzati per frodi o spionaggio sono al centro dell’attenzione.

Queste misure potrebbero comunque non essere sufficienti.

“La caduta del KYC era inevitabile con l’AI che ora crea documenti d’identità falsi che superano le verifiche”, ha dichiarato su Twitter Torsten Stüber, CTO di Satoshi Pay. “È ora di cambiare: Se una regolamentazione rigorosa è d’obbligo, i governi devono abbandonare la burocrazia obsoleta per la tecnologia crittografica, che consente una verifica sicura dell’identità da parte di terzi”.

Naturalmente, l’uso dell’intelligenza artificiale nell’inganno va oltre i documenti d’identità falsi. I bot di Telegram offrono ora servizi che vanno dai video deepfake personalizzati, in cui i volti delle persone vengono sovrapposti a filmati esistenti, alla creazione di immagini di nudo inesistenti di persone, note come deepnudes.

A differenza dei servizi precedenti, questi non richiedono molte conoscenze e nemmeno un hardware potente, rendendo la tecnologia ampiamente disponibile senza nemmeno dover scaricare strumenti gratuiti di editing delle immagini.