Общите контролни механизми за борба с финансовите измами – мерките срещу изпирането на пари (AML) и изискванията за познаване на клиента (KYC) – може би са намерили своя партньор в изкуствения интелект.

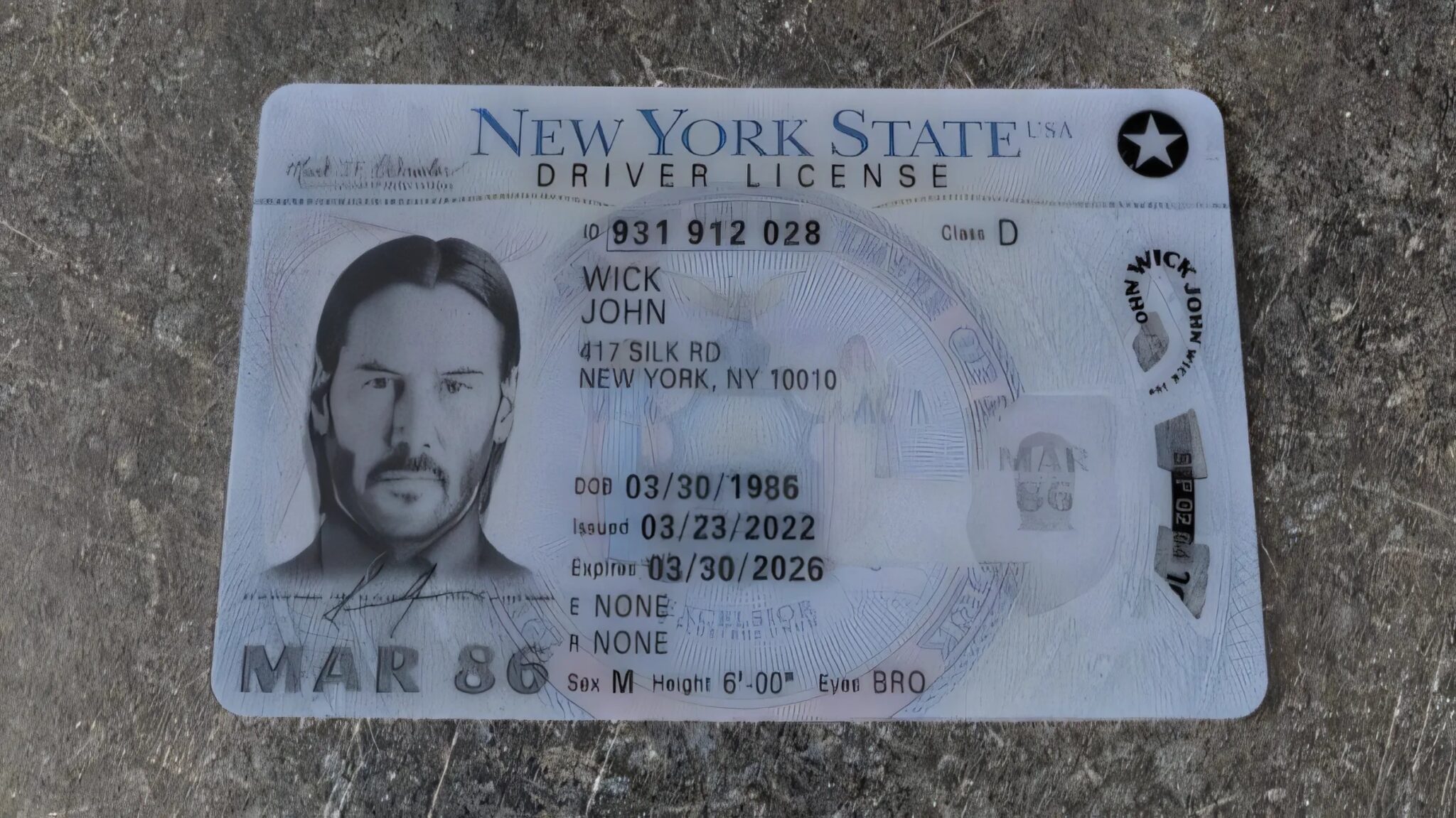

Подземна услуга, наречена OnlyFake, използва „невронни мрежи“ за изработване на висококачествени фалшиви документи за самоличност и според доклад на 404 Media всеки може да получи незабавно генерирани фалшиви документи за самоличност с поразителен реализъм само за 15 USD, което потенциално улеснява редица незаконни дейности.

Първоначалният акаунт на OnlyFake в Telegram, който е основната платформа за работа с клиенти, е закрит. Но новият ѝ акаунт обявява края на ерата на Photoshop, като се хвали с възможността си за масово производство на документи с помощта на усъвършенствани „генератори“.

Собственикът на сайта, използващ псевдонима Джон Уик, заяви, че услугата може да генерира партидно стотици документи от набор от данни в Excel.

Снимките са толкова добри, че 404 Media успя да премине през мерките на KYC на OKX, борса за криптовалути, която използва услугата за проверка на трети страни Jumio, за да проверява документите на своите клиенти. Изследовател в областта на киберсигурността каза на новинарския канал, че потребителите са изпращали само фалшиви идентификационни номера, за да отворят банкови сметки и да получат отблокиране на криптосметките си.

Как се прави

Услугата OnlyFake използва до голяма степен основна технология за изкуствен интелект, макар и с голяма сложност.

Използвайки генеративни противникови мрежи (Generative Adversarial Networks – GAN), форма на ИИ, разработчиците могат да проектират една невронна мрежа, която е оптимизирана за измама, друга, която е създадена за откриване на фалшиви поколения. С всяко взаимодействие обаче и двете мрежи се развиват и стават все по-добри в създаването и откриването на фалшификати.

Друг подход е да се обучи модел, базиран на дифузия, с огромен, добре подбран набор от данни с истински идентификатори. Тези модели умеят да синтезират изключително реалистични изображения, като се обучават върху огромни набори от данни с конкретни елементи. Те се научават да възпроизвеждат най-малките детайли, които правят фалшификатите почти неразличими от автентичните документи, надхитряйки традиционните методи за откриване на фалшификати.

Трябва ли да рискувате?

За тези, които искат да избегнат необходимостта да използват истинската си самоличност, OnlyFake вероятно е изкушаващ. Но включването в услугата води до етични и правни въпроси. Под фанелата на анонимността и привлекателността на лесния достъп тези операции стоят на много нестабилна основа.

Тъй като предоставя фалшиви документи за самоличност от много държави – включително САЩ, Италия, Китай, Русия, Аржентина, Чешката република и Канада – откритото престъпно предприятие несъмнено е привлякло вниманието на правоприлагащите органи по целия свят.

С други думи, Големият брат може би вече наблюдава.

Рисковете обаче са по-големи. Джон Уик, например, може да води списък с клиенти – това би било катастрофално за OnlyFake и неговите потребители. Освен това новата група OnlyFake в Telegram има над 600 членове, повечето от които могат да бъдат проследени по свързаните с тях телефонни номера.

И макар да е очевидно, заслужава да се спомене, че плащането на OnlyFake с традиционните цифрови методи за плащане е много забранено.

Въпреки че плащанията с криптовалута осигуряват ниво на поверителност, те също не са напълно защитени от разкриване на самоличността. Безброй услуги твърдят, че могат да проследяват транзакциите с криптовалути, и по този начин цифровите валути започват да губят свързаната с тях анонимност.

И не, OnlyFake не приема криптографския токен за поверителност Monero.

Най-важното е, че закупуването на фалшив документ за самоличност е в пряко противоречие с политиките за противодействие на изпирането на пари (AML) и за контрол на престъпността (KYC), които поне привидно са въведени с цел борба с финансирането на тероризма и други престъпни дейности.

Бизнесът може и да процъфтява, но дали възможните последици си заслужават бързото и достъпно удобство?

Еволюция на нормативната уредба

Регулаторите вече се опитват да се справят с тази нова заплаха. На 29 януари Министерството на търговията на САЩ предложи набор от правила, озаглавени „Предприемане на допълнителни стъпки за справяне с националната извънредна ситуация по отношение на значителните злонамерени кибернетични дейности“.

Министерството иска да задължи доставчиците на инфраструктура да докладват за чуждестранни лица, които се опитват да обучават големи модели с изкуствен интелект, независимо от причината – но със сигурност във фокуса на вниманието са случаите, в които дълбоките фалшификати биха могли да се използват за измами или шпионаж.

Тези мерки може все още да не са достатъчни.

„Падането на KYC беше неизбежно, след като ИИ вече създава фалшиви документи за самоличност, които преминават безпроблемно през проверките“, заяви Торстен Щубер, главен технически директор на Satoshi Pay, в Twitter. „Време е за промяна: Ако строгата регулация е задължителна, правителствата трябва да се откажат от остарялата бюрокрация и да използват криптографски технологии, които позволяват сигурна проверка на самоличността от трета страна.“

Разбира се, използването на изкуствен интелект в измамите се простира отвъд фалшивите лични карти. Ботовете на Telegram вече предлагат услуги, вариращи от персонализирани deepfake видеоклипове, при които лицата на хората се наслагват върху съществуващи кадри, до създаване на несъществуващи голи снимки на хора, известни като deepnudes.

За разлика от по-ранните услуги, тези не изискват много познания или дори мощен хардуер – това прави технологията широко достъпна, без дори да се налага да се изтеглят безплатни инструменти за редактиране на изображения.