Brace yourself: Sztuczna inteligencja może doprowadzić do wyginięcia ludzkości.

We wtorek setki liderów branży sztucznej inteligencji i badaczy – w tym kierownictwo Microsoft, Google i OpenAI – wydało otrzeźwiające ostrzeżenie. Twierdzą oni, że opracowywana przez nich technologia sztucznej inteligencji może pewnego dnia stanowić realne i aktualne zagrożenie dla istnienia ludzkości. Obok horrorów pandemii i wojen nuklearnych, uważają oni sztuczną inteligencję za zagrożenie społeczne o podobnej skali.

W liście opublikowanym przez Center for AI Safety specjaliści ds. sztucznej inteligencji przedstawili następujące stwierdzenie, charakteryzujące się surową zwięzłością: „Zmniejszenie ryzyka wyginięcia z powodu sztucznej inteligencji powinno być globalnym priorytetem obok innych zagrożeń społecznych, takich jak pandemie i wojna nuklearna”.

To wszystko, to wszystko, co mówią.

Źródło: Center for AI Safety

Oświadczenie przedstawia sztuczną inteligencję jako bezpośrednie zagrożenie, podobne do katastrofy nuklearnej lub globalnej pandemii. Ale sygnatariusze, ci czarodzieje branży technologicznej, nie rozwinęli swojego złowieszczego ostrzeżenia.

Jak dokładnie ma wyglądać scenariusz końca świata? Kiedy powinniśmy zaznaczyć nasze kalendarze na powstanie naszych robotów? Dlaczego sztuczna inteligencja, wynalazek ludzkiej innowacyjności, miałaby zwrócić się przeciwko swoim twórcom? Cisza ze strony architektów sztucznej inteligencji była donośna i nie udzielili oni żadnych odpowiedzi.

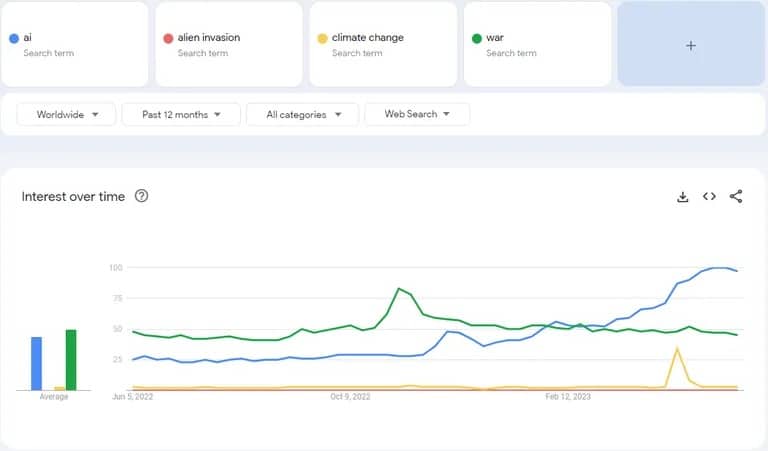

W rzeczywistości liderzy branży nie byli bardziej pouczający niż chatbot z gotową odpowiedzią. Wydaje się, że w sferze globalnych zagrożeń sztuczna inteligencja nagle przeskoczyła kolejkę, pokonując zmiany klimatyczne, konflikty geopolityczne, a nawet inwazje kosmitów pod względem wyszukiwania słów kluczowych w Google.

Co ciekawe, firmy mają tendencję do popierania regulacji, gdy są one zgodne z ich interesami. Można to postrzegać jako ich sposób na powiedzenie: „Chcemy mieć wpływ na kształtowanie tych przepisów”. Przypomina to petycję lisa o nowe zasady w kurniku

Warto również zauważyć, że dyrektor generalny OpenAI, Sam Altman, naciskał na regulacje w USA. Mimo to zagroził, że opuści Europę, jeśli politycy kontynentu będą nadal próbowali regulować sztuczną inteligencję. „Spróbujemy się do tego dostosować” – powiedział Altman podczas panelu na University College London. „Jeśli będziemy w stanie to zrobić, zrobimy to. A jeśli nie, przestaniemy działać”.

Trzeba uczciwie przyznać, że kilka dni później wycofał się, mówiąc, że OpenAI nie planuje opuszczać Europy. Stało się to oczywiście po tym, jak miał okazję porozmawiać z organami regulacyjnymi na ten temat w „bardzo produktywnym tygodniu”.

Bardzo produktywny tydzień rozmów w Europie o tym, jak najlepiej uregulować sztuczną inteligencję! Cieszymy się, że możemy nadal tu działać i oczywiście nie planujemy wyjeżdżać.

– Sam Altman (@sama) 26 maja 2023

AI jest ryzykowne, ale czy aż tak?

Potencjalne zagrożenia związane ze sztuczną inteligencją nie pozostały niezauważone przez ekspertów. Poprzedni list otwarty podpisany przez 31 810 osób, w tym Elona Muska, Steve’a Wozniaka, Yuvala Harariego i Andrew Yanga, wzywał do wstrzymania szkolenia potężnych modeli sztucznej inteligencji.

„Protokoły te powinny zapewniać, że systemy, które ich przestrzegają, są bezpieczne ponad wszelką wątpliwość” – czytamy w liście, wyjaśniając, że „nie oznacza to przerwy w rozwoju sztucznej inteligencji w ogóle, a jedynie wycofanie się z niebezpiecznego wyścigu do coraz większych nieprzewidywalnych modeli czarnej skrzynki z nowymi możliwościami”.

Kwestia potencjalnego Foomu SI (w którym SI staje się zdolna do ulepszania własnych systemów, zwiększając swoje możliwości do tego stopnia, że przewyższa ludzką inteligencję) jest dyskutowana od lat. Jednak dzisiejsze szybkie tempo zmian, w połączeniu z dużym zainteresowaniem mediów, sprawiło, że debata znalazła się w globalnym centrum uwagi.

Źródło: Columbia Journalism Review

This wygenerował różne poglądy na temat tego, w jaki sposób sztuczna inteligencja wpłynie (a nie tylko może wpłynąć) na przyszłość interakcji społecznych.

Niektórzy wyobrażają sobie utopijną erę, w której sztuczna inteligencja i ludzie wchodzą w interakcje, a postęp technologiczny króluje. Inni uważają, że ludzkość dostosuje się do AI, tworząc nowe miejsca pracy wokół tej technologii, podobnie jak w przypadku wzrostu zatrudnienia, który nastąpił po wynalezieniu samochodu. Jeszcze inni utrzymują, że sztuczna inteligencja ma duże szanse dojrzeć i stać się niekontrolowana, stanowiąc realne zagrożenie dla ludzkości.

Do tego czasu w świecie sztucznej inteligencji wszystko toczy się jak zwykle. Miej oko na swojego ChatGPT, Barda lub Siri – być może tylko jedna aktualizacja oprogramowania dzieli ich od rządzenia światem. Na razie jednak wydaje się, że największym zagrożeniem dla ludzkości nie są nasze własne wynalazki, ale raczej nasz nieograniczony talent do hiperboli.