Приемете себе си: ИИ може да доведе до изчезване на човечеството.

Във вторник стотици лидери и изследователи в областта на изкуствения интелект – включително ръководители на Microsoft, Google и OpenAI – отправиха отрезвяващо предупреждение. Те твърдят, че технологията за изкуствен интелект, която разработват, един ден може да представлява реална и настояща опасност за съществуването на човечеството. Наред с ужасите на пандемиите и ядрените войни, те смятат, че изкуственият интелект представлява обществен риск от подобна величина.

В писмо, публикувано от Центъра за безопасност на изкуствения интелект, специалистите по изкуствен интелект предлагат това изявление, което се отличава със своята сурова лаконичност: „Намаляването на риска от изчезване на ИИ трябва да бъде глобален приоритет наред с други рискове от обществен мащаб като пандемиите и ядрената война.“

Това е всичко, това е всичко, което казват.

Източник: Център за безопасност на изкуствения интелект

В изявлението ИИ е представен като непосредствена заплаха, подобна на ядрена катастрофа или глобална пандемия. Но подписалите го, тези магьосници на технологичната индустрия, не успяха да разширят зловещото си предупреждение.

Как точно трябва да протече този сценарий за края на дните? Кога трябва да отбележим в календара си възхода на нашите роботи? Защо изкуственият интелект, изобретение на човешката иновация, ще се обърне срещу своите създатели? Мълчанието от страна на тези архитекти на изкуствения интелект беше гръмко и те не дадоха никакви отговори.

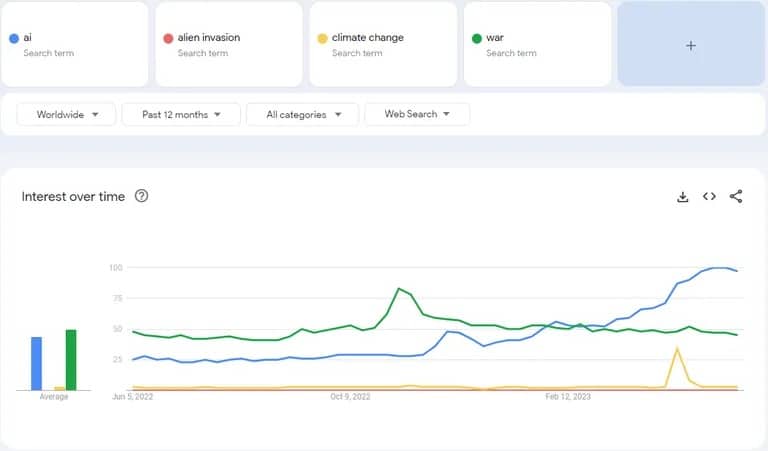

Всъщност тези индустриални лидери не бяха по-информативни от чатбот с консервиран отговор. В сферата на глобалните заплахи изкуственият интелект сякаш изведнъж прескочи опашката, изпреварвайки изменението на климата, геополитическите конфликти и дори нашествията на извънземни по отношение на търсенето на ключови думи в Google.

Търсенията на ИИ в Google в сравнение с други глобални проблеми като войни, нашествия на извънземни и климатични промени. Снимка: Google

Интересен е фактът, че компаниите са склонни да се застъпват за регулации, когато те съответстват на техните интереси. Това може да се разглежда като техен начин да кажат: „Ние желаем да имаме пръст в оформянето на тези разпоредби“. Това прилича на петиция на лисицата за нови правила в кокошарника.

Забележително е също така, че главният изпълнителен директор на OpenAI, Сам Алтман, настоява за регулации в САЩ. Все пак той заплаши да напусне Европа, ако политиците на континента продължат да се опитват да регулират ИИ. „Ще се опитаме да се съобразим“, заяви Алтман по време на дискусия в Университетския колеж в Лондон. „Ако можем да се съобразим, ще го направим. А ако не можем, ще преустановим дейността си.“

Справедливо е да се каже, че след това той се оттегли няколко дни по-късно, заявявайки, че OpenAI не планира да напуска Европа. Това, разбира се, се случи, след като той получи възможност да разговаря с регулаторните органи по въпроса в рамките на една „много продуктивна седмица“.

много продуктивна седмица на разговори в Европа за това как най-добре да регулираме изкуствения интелект! ние сме развълнувани да продължим да работим тук и, разбира се, нямаме планове да напускаме.

– Sam Altman (@sama) May 26, 2023

AI е рисковано, но толкова ли е рисковано?

Потенциалните опасности, свързани с изкуствения интелект, не остават незабелязани сред експертите. В предишно отворено писмо, подписано от 31 810 поддръжници, сред които Елон Мъск, Стив Возняк, Ювал Харари и Андрю Янг, се призовава за пауза в обучението на мощни модели на изкуствен интелект.

„Тези протоколи трябва да гарантират, че системите, които се придържат към тях, са безопасни отвъд разумното съмнение“, се казва в писмото, като се уточнява, че „това не означава пауза в развитието на ИИ като цяло, а само отдръпване от опасната надпревара за все по-големи непредсказуеми модели от типа „черна кутия“ с нововъзникващи способности.“

От години се обсъжда въпросът за потенциалния „Foom“ на ИИ (при който ИИ става способен да подобрява собствените си системи, увеличавайки възможностите си до степен, в която надминава човешкия интелект). Въпреки това, бързият темп на промените днес, съчетан със значителното медийно отразяване, изтласка дебата в центъра на световното внимание.

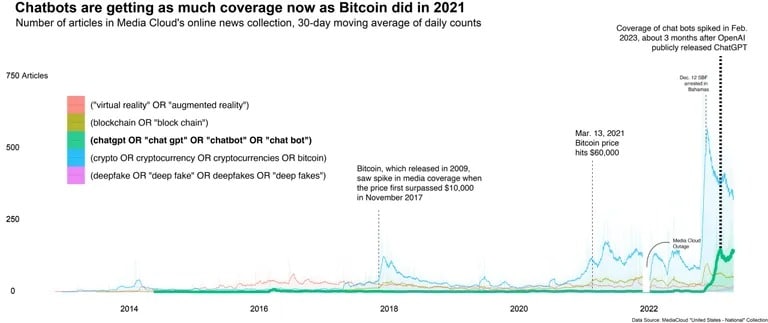

Източник: Columbia Journalism Review

Това породи различни мнения за това как ИИ ще повлияе (а не само би могъл да повлияе) на бъдещето на социалните взаимодействия.

Някои си представят утопична ера, в която изравнени ИИ и хора си взаимодействат, а технологичният напредък властва. Други смятат, че човечеството ще се адаптира към ИИ, като около технологията ще бъдат създадени нови работни места, подобно на ръста на работните места, последвал изобретяването на автомобила. Други пък твърдят, че има значителен шанс ИИ да узрее и да стане неконтролируем, представлявайки реална заплаха за човечеството.

Дотогава в света на ИИ всичко си върви по старому. Дръжте под око вашия ChatGPT, вашия Bard или вашата Siri – може би само една актуализация на софтуера ги дели от това да управляват света. Но засега изглежда, че най-голямата заплаха за човечеството не са собствените ни изобретения, а по-скоро безграничният ни талант за хипербола.