A pesar del disparo de advertencia que se ha oído en todo el mundo -una carta abierta firmada por cientos de líderes del sector en la que se declara que la inteligencia artificial es una amenaza existencial para la humanidad-, una nueva encuesta realizada a más de 2.700 expertos en IA pinta un panorama menos desolador del futuro.

La exhaustiva encuesta AI Impacts, realizada con la ayuda de investigadores de las universidades de Oxford, Berkeley y Bonn, preguntaba a los investigadores de IA sobre el ritmo de progreso en este campo y el impacto potencial de los sistemas avanzados de IA. Aunque se recopiló un amplio abanico de perspectivas, sólo alrededor del 5% consideraba que existía una alta probabilidad de extinción humana a causa de la IA.

Esto contrasta fuertemente con los sentimientos del público en general.

Según una encuesta de agosto de 2023, el 61% de los estadounidenses considera la IA una amenaza para la humanidad. Los líderes de la industria se hicieron eco de esta preocupación y firmaron una carta del Centro para la Seguridad de la IA en la que afirmaban que «mitigar el riesgo de extinción por la IA debería ser una prioridad mundial.»

Paul Christiano, antiguo jefe de alineación de OpenAI, estimó en un 50% las posibilidades de que la IA acabe en «catástrofe». Muchos han declarado que la IA es una amenaza a la altura de una guerra nuclear o una pandemia mundial.

A pesar de estas predicciones pesimistas ampliamente difundidas, la IA sigue evolucionando. Las empresas se apresuran a desarrollar sistemas más avanzados, y Sam Altman, Consejero Delegado de OpenAI, aboga por la regulación junto con un impulso para probar los límites de la tecnología.

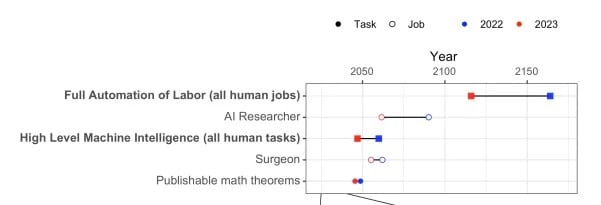

En cuanto a las capacidades de la IA, muchos de los encuestados predijeron que la IA lograría importantes hitos creativos en un plazo de 10 años: la codificación de todo un sitio web de pagos desde cero, por ejemplo, o la creación de canciones indistinguibles de los éxitos actuales. Pero los plazos eran más largos para retos como la demostración de teoremas matemáticos.

Más concretamente, la posibilidad de que la Inteligencia Artificial de Alto Nivel (HLMI) se haga realidad se ha acercado 13 años, con una probabilidad de éxito del 50% prevista para 2047. Del mismo modo, el horizonte de la Automatización Total del Trabajo (FAOL) -una de las controvertidas predicciones de Elon Musk- se ha adelantado 48 años, hasta 2116.

Cuando se les preguntó sobre la capacidad de la IA para igualar todas las capacidades humanas, los investigadores pronosticaron un 50% de posibilidades para 2047. Es decir, 13 años antes que en una encuesta similar realizada en 2022.

Los encuestados se mostraron divididos sobre si un progreso más rápido o más lento beneficiaría más a la humanidad.

Curiosamente, aunque se espera que los sistemas de IA de 2043 sean capaces de encontrar formas inesperadas de alcanzar objetivos, los investigadores confían menos en la capacidad humana para explicar tales acciones. Esta ambigüedad en el funcionamiento de la toma de decisiones de la IA pone de manifiesto la necesidad de dar prioridad a la investigación sobre la seguridad de la IA, un sentimiento del que se hizo eco el 70% de los encuestados.

Las opiniones difieren sobre si se puede confiar en que la IA en 2028 explique su propio razonamiento.

También existe una gran preocupación por riesgos como la desinformación, la desigualdad y la vigilancia masiva que permite la IA.

Aunque los investigadores se muestran cautelosamente optimistas en general, alrededor del 40% cree que existe una posibilidad mínima (no nula) de extinción humana a causa de la IA avanzada. Así que, aunque los robots asesinos no son inminentes, el estudio de la ética y la seguridad de la IA sigue siendo fundamental.