Malgré le coup de semonce entendu dans le monde entier – une lettre ouverte signée par des centaines de chefs d’entreprise déclarant que l’intelligence artificielle constitue une menace existentielle pour l’humanité – une nouvelle enquête menée auprès de plus de 2 700 experts en IA brosse un tableau moins sombre de l’avenir.

L’enquête exhaustive AI Impacts, réalisée avec l’aide de chercheurs des universités d’Oxford, de Berkeley et de Bonn, a interrogé des chercheurs en IA sur le rythme des progrès réalisés dans ce domaine et sur l’impact potentiel des systèmes d’IA avancés. Bien qu’un large éventail de points de vue ait été compilé, seuls 5 % environ ont estimé que l’IA risquait fort de provoquer l’extinction de l’humanité.

Ces chiffres contrastent fortement avec les sentiments du grand public.

Selon un sondage réalisé en août 2023, 61 % des Américains considèrent l’IA comme une menace pour l’humanité. Cette inquiétude a été relayée par les dirigeants de l’industrie qui ont signé une lettre du Center for AI Safety affirmant que « l’atténuation du risque d’extinction par l’IA devrait être une priorité mondiale ».

Paul Christiano, ancien responsable de l’alignement chez OpenAI, a estimé à 50 % le risque que l’IA aboutisse à une « catastrophe ». Nombreux sont ceux qui ont déclaré que l’IA constituait une menace au même titre qu’une guerre nucléaire ou une pandémie mondiale.

Malgré ces prédictions pessimistes largement diffusées, l’IA continue d’évoluer. Les entreprises se lancent dans une course au développement de systèmes plus avancés, le PDG d’OpenAI, Sam Altman, plaidant en faveur de réglementations tout en poussant à tester les limites de la technologie.

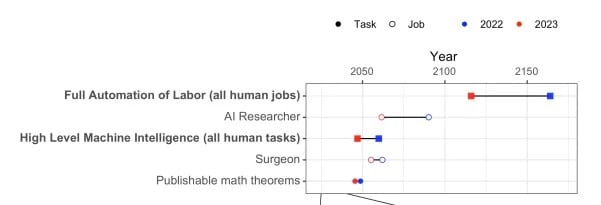

En ce qui concerne les capacités de l’IA, de nombreux répondants à l’enquête ont prédit que l’IA atteindrait des étapes créatives majeures d’ici dix ans : coder un site web de paiement complet à partir de zéro, par exemple, ou créer des chansons impossibles à différencier des tubes d’aujourd’hui. Mais les délais sont plus longs pour des défis tels que la démonstration de théorèmes mathématiques.

Plus précisément, la possibilité que l’intelligence des machines de haut niveau (HLMI) devienne une réalité s’est rapprochée de 13 ans, avec une probabilité de réussite de 50 % prévue d’ici 2047. De même, l’horizon de l’automatisation complète du travail (FAOL) – l’une des prédictions controversées d’Elon Musk – a été avancé de 48 ans, à 2116.

Interrogés sur la capacité de l’IA à égaler toutes les capacités humaines, les chercheurs prévoient une probabilité de 50 % d’ici 2047. C’est 13 ans plus tôt que ce que prévoyait une enquête similaire en 2022.

Les répondants étaient partagés sur la question de savoir si des progrès plus rapides ou plus lents profiteraient davantage à l’humanité.

Il est intéressant de noter que si l’on s’attend à ce que les systèmes d’IA de 2043 soient capables de trouver des moyens inattendus d’atteindre leurs objectifs, les chercheurs ont moins confiance dans la capacité humaine à expliquer de telles actions. Cette ambiguïté dans le fonctionnement du processus décisionnel de l’IA souligne la nécessité de donner la priorité à la recherche sur la sécurité de l’IA, un sentiment partagé par 70 % des personnes interrogées.

Les avis divergent sur la question de savoir si l’on peut faire confiance à l’IA de 2028 pour expliquer son propre raisonnement.

Les risques de désinformation, d’inégalité et de surveillance de masse permis par l’IA suscitent également de vives inquiétudes.

Si les chercheurs font preuve d’un optimisme prudent dans l’ensemble, environ 40 % d’entre eux estiment que le risque d’extinction de l’humanité par l’IA avancée est minime (et non nul). Ainsi, même si les robots tueurs ne sont pas imminents, l’étude de l’éthique et de la sécurité de l’IA reste essentielle.