尽管全世界都在发出警告–一封由数百位行业领袖签署的公开信宣布人工智能是对人类生存的威胁–但一项由 2700 多名人工智能专家参与的最新调查却描绘出了一幅不那么可怕的未来图景。

在牛津大学、伯克利大学和波恩大学研究人员的帮助下进行的人工智能影响综合调查向人工智能研究人员询问了该领域的进展速度以及先进人工智能系统的潜在影响。虽然收集到了广泛的观点,但只有约 5%的人认为人类很有可能因人工智能而灭绝。

这与公众的看法形成了鲜明对比。

2023 年 8 月的一项民意调查发现,61% 的美国人认为人工智能是对人类的威胁。行业领袖们也表达了同样的担忧,他们签署了一封人工智能安全中心(Center for AI Safety)的信函,称 “降低人工智能灭绝的风险应成为全球优先事项”。

OpenAI公司前排列首席执行官保罗-克里斯蒂亚诺(Paul Christiano)估计,人工智能有50%的可能会以 “灾难 “收场。许多人宣称,人工智能的威胁不亚于核战争或全球大流行病。

尽管这些悲观预测被广泛报道,但人工智能仍在继续发展。公司正在竞相开发更先进的系统,OpenAI 首席执行官山姆-奥特曼(Sam Altman)主张在推动测试技术边界的同时制定相关法规。

关于人工智能的能力,许多调查对象预测,人工智能将在10年内实现重大的创造性里程碑:例如,从零开始编写整个支付网站的代码,或者创作出与当今流行歌曲无异的歌曲。但对于数学定理证明等挑战来说,时间跨度会更长。

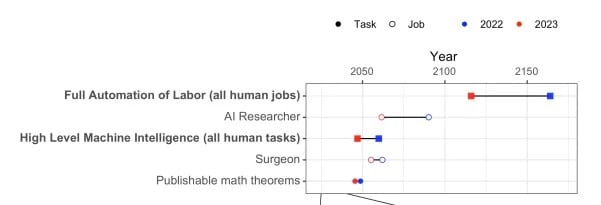

更具体地说,高级机器智能(HLMI)成为现实的可能性已经拉近了 13 年,预计到 2047 年将有 50%的成功概率。同样,埃隆-马斯克(Elon Musk)颇具争议的预测之一–“劳动力全面自动化”(FAOL)也提前了 48 年,即 2116 年。

当被问及人工智能是否有能力与人类的所有能力相匹配时,研究人员预测到 2047 年将有 50%的可能性。这比 2022 年的类似调查早了 13 年。

受访者对更快或更慢的进步会给人类带来更多益处的看法不一。

有趣的是,虽然人们预计2043年的人工智能系统能够找到意想不到的方法来实现目标,但研究人员对人类解释这种行为的能力却信心不足。人工智能决策方式的这种模糊性凸显了优先开展人工智能安全研究的必要性–70%的受访者对此深有同感。

对于 2028 年的人工智能能否解释其自身的推理,人们的看法不尽相同。

人们对人工智能带来的错误信息、不平等和大规模监控等风险也存在极大的担忧。

虽然研究人员总体上持谨慎乐观的态度,但约有40%的人认为,人类因先进的人工智能而灭绝的可能性很小(并非为零)。因此,尽管杀手机器人并不是迫在眉睫,但研究人工智能的伦理和安全性仍然至关重要。