La possibilità di creare deepfakes generati dall’AI di persone famose e influenti ha scatenato una vera e propria tempesta su Internet, ma mentre le immagini del Papa che indossa una giacca gonfia di Balenciaga e dell’ex presidente degli Stati Uniti Donald Trump che viene arrestato hanno fatto notizia, sta emergendo una nuova tendenza: i deepfakes delle vittime di omicidio, secondo quanto riportato da Rolling Stone.

“Sembrano progettati per scatenare forti reazioni emotive, perché è il modo più sicuro per ottenere click e like”, ha dichiarato a Rolling Stone Paul Bleakley, assistente alla cattedra di giustizia penale presso l’Università di New Haven. “È scomodo da guardare, ma credo che questo sia lo scopo”.

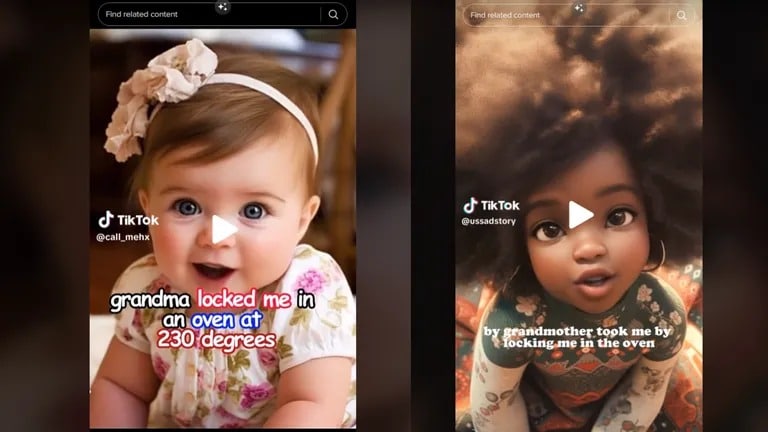

I brevi filmati che girano su TikTok includono video generati dall’intelligenza artificiale, audio e descrizioni in prima persona di bambini. Tra i più noti raffigurati in questo modo c’è Royalty Marie Floyd, presentata in alcuni video come Rody Mary Floyd, il cui corpo è stato trovato in un forno nel 2018. La nonna di Floyd, Carolyn Jones, è stata accusata dell’omicidio di Floyd, ha dichiarato Rolling Stone, aggiungendo che il generatore di AI ha anche fornito età e razze diverse della bambina.

Immagine: Varianti generate dall’IA di Royalty Marie Floyd

Il fenomeno che causa questi errori è noto come allucinazioni. Le “allucinazioni” dell’IA si riferiscono ai casi in cui un’IA genera risultati inaspettati e non veritieri e non è supportata da dati reali. Le allucinazioni dell’IA possono creare contenuti, notizie o informazioni false su persone, eventi o fatti.

“Questi deepfake dell’IA di vere vittime di crimini danno certamente vita alla storia in un modo che nessuno di noi avrebbe potuto immaginare, e potrebbero contribuire a educare il pubblico in generale”, ha dichiarato al TCN l’avvocato e CEO di AR Media Andrew Rossow. “Tuttavia, da un punto di vista legale, questo utilizzo e applicazione dell’IA è estremamente preoccupante e problematico”.

Rossow ha sottolineato due questioni principali: i problemi di privacy e la causa di stress emotivo per coloro che conoscevano la vittima.

Un deepfake è un tipo di video sempre più comune, creato con l’intelligenza artificiale, che rappresenta eventi falsi. Già fonte di preoccupazione per i responsabili della sicurezza informatica e delle forze dell’ordine, i deepfake sono diventati sempre più difficili da individuare grazie a piattaforme di intelligenza artificiale generativa in rapida evoluzione come Midjourney 5.1 e DALL-E 2 di OpenAI.

Midjourney ha terminato la sua versione di prova gratuita a marzo in seguito a un aumento dei deepfakes virali generati con la sua tecnologia.

La crescente potenza dell’IA ha anche spinto i truffatori a utilizzare la tecnologia per tentare di ingannare gli aspiranti investitori e sottrarre loro denaro e criptovalute. La scorsa settimana è diventato virale un video deepfake di Elon Musk che promuoveva una truffa sulle criptovalute.

Come riporta Rolling Stone, l’account che ha caricato il video dei Royalty Marie Floyd è stato eliminato da TikTok per “aver violato la politica della piattaforma relativa ai media sintetici che ritraggono persone private”. Tuttavia, il genio è già uscito dalla bottiglia e gli account che postano video simili stanno riempiendo il vuoto.

“Sfortunatamente, casi d’uso come questo devono accadere per far progredire la nostra giurisprudenza e i nostri precedenti su questioni già molto dibattute che riguardano la privacy (pre e post mortem) e la tecnologia emergente che di per sé opera ancora principalmente nel grigiore dei nostri tribunali”, ha dichiarato Rossow.