Возможность создания искусственным интеллектом глубоких подделок известных и влиятельных людей вызвала бурю в Интернете, но в то время как изображения Папы Римского в пухлом пиджаке Balenciaga и арестованного бывшего президента США Дональда Трампа стали заголовками газет, появилась новая тенденция: глубокие подделки жертв убийств, сообщает Rolling Stone.

«Похоже, они призваны вызвать сильную эмоциональную реакцию, потому что это самый верный способ получить клики и лайки», — сказал Rolling Stone Пол Бликли, доцент кафедры уголовного правосудия Университета Нью-Хейвена, — «Это неприятно смотреть, но я думаю, в этом и есть смысл».

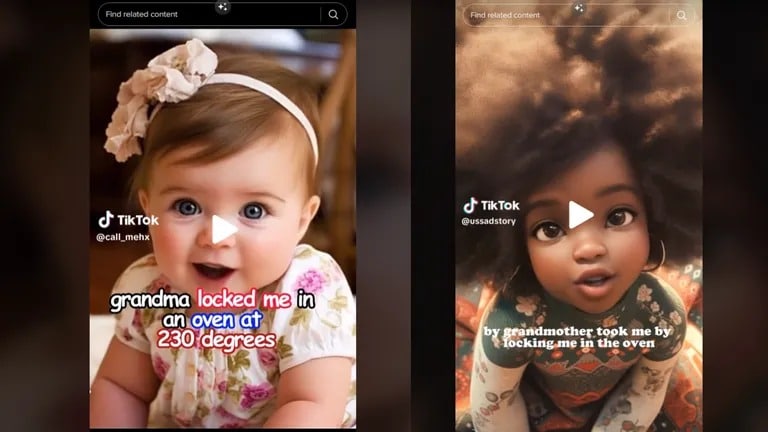

Короткие видеоклипы, распространяемые на TikTok, включают видео, сгенерированное искусственным интеллектом, аудио и описания детей от первого лица. Среди самых известных, изображенных таким образом, — Роялти Мари Флойд, представленная в некоторых видео как Роди Мэри Флойд, чье тело было найдено в духовке в 2018 году. Бабушка Флойда, Кэролин Джонс, была обвинена в убийстве Флойда, сообщил Rolling Stone, добавив, что генератор ИИ также выдавал разные возрасты и расы ребенка.

Изображение: Сгенерированные ИИ варианты Роялти Мари Флойд

Явление, вызывающее эти ошибки, известно как галлюцинации. ИИ «галлюцинации» относятся к случаям, когда ИИ генерирует неожиданные, неправдивые результаты, не подкрепленные реальными данными. Галлюцинации ИИ могут создавать ложный контент, новости или информацию о людях, событиях или фактах.

«Эти глубокие подделки ИИ настоящих жертв преступлений, безусловно, оживляют историю так, как никто из нас не мог себе представить, что может помочь в просвещении широкой общественности», — сказал TCN адвокат и генеральный директор AR Media Эндрю Россоу. «Однако с юридической точки зрения такое использование и применение ИИ вызывает серьезные опасения и проблемы».

Россоу указал на две главные проблемы: проблемы конфиденциальности и причинение эмоционального страдания тем, кто знал жертву.

Глубокий фейк — это все более распространенный тип видео, созданный с помощью искусственного интеллекта и изображающий ложные события. Глубокие фальшивки, уже ставшие предметом озабоченности кибербезопасности и правоохранительных органов, становится все труднее обнаружить благодаря быстро развивающимся платформам генеративного искусственного интеллекта, таким как Midjourney 5.1 и DALL-E 2 от OpenAI.

В марте Midjourney прекратила свою бесплатную пробную версию после роста числа вирусных подделок, созданных с использованием ее технологии.

Растущая мощь искусственного интеллекта также заставляет мошенников использовать эту технологию, чтобы попытаться обманом лишить потенциальных инвесторов их денег и криптовалют. На прошлой неделе распространилось видео deepfake, на котором Элон Маск рекламирует криптовалютную аферу.

Как сообщает Rolling Stone, аккаунт, загрузивший видео Royalty Marie Floyd, был удален TikTok за «нарушение политики платформы в отношении синтетических медиа с изображением частных лиц». Тем не менее, джинн уже выпущен из бутылки, и аккаунты, размещающие подобные видео, заполняют пробел.

«К сожалению, такие случаи использования, как этот, должны происходить для того, чтобы мы могли продвигать нашу юридическую практику и прецедент по уже сильно обсуждаемым вопросам, связанным с приватностью (до и после смерти) и появляющимися технологиями, которые сами по себе все еще работают в основном в сером режиме с нашими судами», — сказал Россоу.