Zdolność do tworzenia generowanych przez sztuczną inteligencję deepfake’ów znanych i wpływowych osób wywołała niemałą burzę w Internecie, ale podczas gdy zdjęcia papieża noszącego bufiastą kurtkę Balenciaga i aresztowanego byłego prezydenta USA Donalda Trumpa trafiły na pierwsze strony gazet, pojawia się nowy trend: deepfake’i ofiar morderstw, zgodnie z raportem Rolling Stone.

„Wydaje się, że mają one na celu wywołanie silnych reakcji emocjonalnych, ponieważ jest to najpewniejszy sposób na uzyskanie kliknięć i polubień” – powiedział Rolling Stone Paul Bleakley, adiunkt w dziedzinie wymiaru sprawiedliwości w sprawach karnych na University of New Haven. „Oglądanie jest niewygodne, ale myślę, że o to może chodzić”.

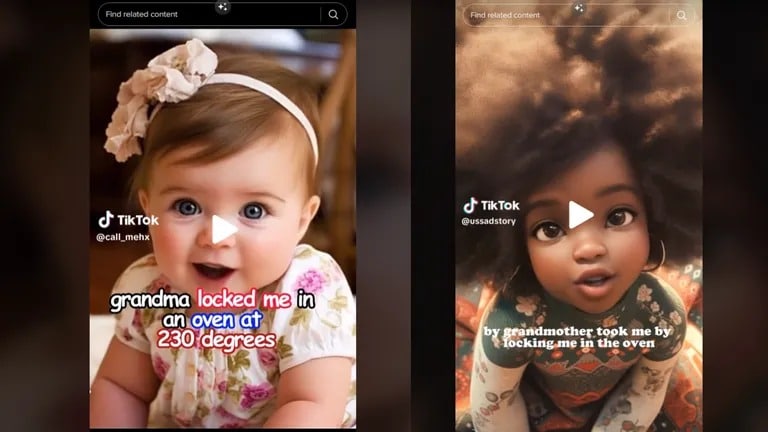

Krótkie klipy wideo, które krążą po TikTok, zawierają wideo generowane przez sztuczną inteligencję, dźwięk i opisy dzieci w pierwszej osobie. Jedną z najbardziej znanych osób przedstawionych w ten sposób jest Royalty Marie Floyd, przedstawiana w niektórych filmach jako Rody Mary Floyd, której ciało znaleziono w piekarniku w 2018 roku. Babcia Floyd, Carolyn Jones, została oskarżona o morderstwo Floyd, powiedział Rolling Stone, dodając, że generator sztucznej inteligencji podał również różny wiek i rasę dziecka.

Obraz: AI-generate variants of Royalty Marie Floyd

Zjawisko, które powoduje te błędy, znane jest jako halucynacje. „Halucynacje” sztucznej inteligencji odnoszą się do przypadków, w których sztuczna inteligencja generuje nieoczekiwane, nieprawdziwe wyniki i nie jest poparta rzeczywistymi danymi. Halucynacje AI mogą tworzyć fałszywe treści, wiadomości lub informacje o ludziach, wydarzeniach lub faktach.

„Te sztuczne podróbki prawdziwych ofiar przestępstw z pewnością ożywiają historię w sposób, którego nikt z nas nie mógł sobie wyobrazić, co może pomóc w edukacji ogółu społeczeństwa” – powiedział TCN Andrew Rossow, prawnik i dyrektor generalny AR Media. „Jednak z prawnego punktu widzenia takie wykorzystanie i zastosowanie sztucznej inteligencji jest niezwykle niepokojące i problematyczne”.

Rossow wskazał na dwie główne kwestie: obawy o prywatność i powodowanie emocjonalnego niepokoju u osób, które znały ofiarę.

Deepfake to coraz bardziej powszechny rodzaj wideo tworzonego przy użyciu sztucznej inteligencji, który przedstawia fałszywe wydarzenia. Deepfake’i stały się coraz trudniejsze do wykrycia dzięki szybko rozwijającym się platformom generatywnej sztucznej inteligencji, takim jak Midjourney 5.1 i DALL-E 2 firmy OpenAI.

Midjourney zakończyła swoją bezpłatną wersję próbną w marcu po wzroście liczby wirusowych deepfake’ów generowanych przy użyciu jej technologii.

Rosnąca potęga sztucznej inteligencji powoduje również, że oszuści wykorzystują tę technologię do prób oszukania potencjalnych inwestorów z ich pieniędzy i kryptowalut. W zeszłym tygodniu, deepfake’owe wideo Elona Muska promujące oszustwo kryptowalutowe stało się wirusowe.

Jak donosi Rolling Stone, konto, które przesłało wideo Royalty Marie Floyd, zostało usunięte przez TikTok za „naruszenie zasad platformy dotyczących syntetycznych mediów przedstawiających osoby prywatne”. Mimo to, dżin już wyszedł z butelki, a konta publikujące podobne filmy wypełniają lukę.

„Niestety, takie przypadki użycia muszą się zdarzyć, abyśmy mogli rozwinąć nasze orzecznictwo prawne i precedensy w już mocno dyskutowanych kwestiach dotyczących prywatności (przed i po śmierci), a teraz pojawiającej się technologii, która sama w sobie nadal działa głównie w szarej strefie z naszymi sądami” – powiedział Rossow.