La possibilité de créer des deepfakes de personnes célèbres et influentes générés par l’IA a provoqué une véritable tempête sur Internet, mais alors que les images du pape portant une veste Balenciaga bouffante et de l’ancien président américain Donald Trump arrêté ont fait les gros titres, une nouvelle tendance émerge : les deepfakes de victimes de meurtres, d’après un rapport de Rolling Stone.

« Ils semblent conçus pour déclencher de fortes réactions émotionnelles, car c’est le moyen le plus sûr d’obtenir des clics et des likes », a déclaré Paul Bleakley, professeur adjoint de justice pénale à l’université de New Haven, à Rolling Stone, « C’est désagréable à regarder, mais je pense que c’est peut-être le but recherché ».

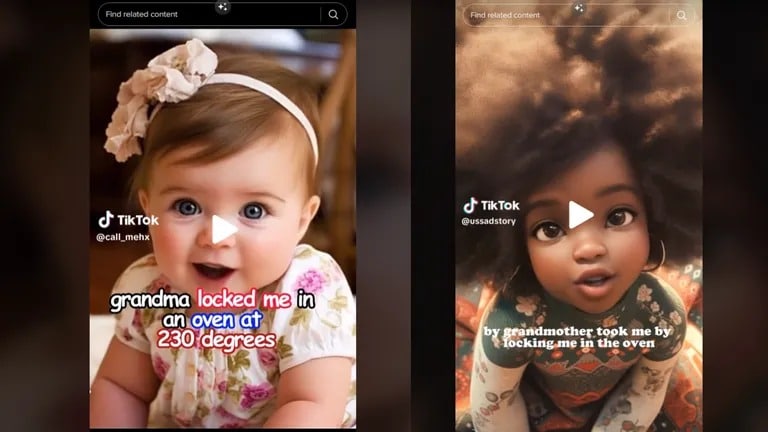

Les courts clips vidéo qui circulent sur TikTok comprennent des vidéos générées par l’IA, des sons et des descriptions d’enfants à la première personne. Parmi les plus connus dépeints de cette manière figure Royalty Marie Floyd, présentée dans certaines vidéos sous le nom de Rody Mary Floyd, dont le corps a été retrouvé dans un four en 2018. La grand-mère de Floyd, Carolyn Jones, a été accusée du meurtre de Floyd, a déclaré Rolling Stone, ajoutant que le générateur d’IA a également donné des âges et des races différents de l’enfant.

Image : Variantes de Royalty Marie Floyd générées par l’IA

Le phénomène à l’origine de ces erreurs est connu sous le nom d’hallucinations. On parle d' »hallucinations » de l’IA lorsqu’une IA génère des résultats inattendus et erronés et qu’elle n’est pas étayée par des données réelles. Les hallucinations de l’IA peuvent créer de faux contenus, de fausses nouvelles ou de fausses informations sur des personnes, des événements ou des faits.

« Ces deepfakes d’IA de vraies victimes de crimes donnent certainement vie à l’histoire d’une manière qu’aucun d’entre nous n’aurait pu imaginer, ce qui pourrait contribuer à éduquer le grand public », a déclaré Andrew Rossow, avocat et PDG d’AR Media, à TCN. « Cependant, d’un point de vue juridique, cette utilisation et cette application de l’IA sont extrêmement troublantes et problématiques. »

M. Rossow a mis en évidence deux problèmes principaux : le respect de la vie privée et la détresse émotionnelle des personnes qui connaissaient la victime.

Un « deepfake » est un type de vidéo de plus en plus courant, créé à l’aide d’une intelligence artificielle, qui dépeint de faux événements. Déjà source d’inquiétude pour les responsables de la cybersécurité et de l’application de la loi, les deepfakes sont devenus de plus en plus difficiles à détecter grâce à des plateformes d’IA générative en évolution rapide telles que Midjourney 5.1 et DALL-E 2 d’OpenAI.

Midjourney a mis fin à sa version d’essai gratuite en mars à la suite d’une augmentation des deepfakes viraux générés à l’aide de sa technologie.

Le pouvoir croissant de l’IA a également incité les escrocs à utiliser cette technologie pour tenter de soutirer aux investisseurs potentiels leur argent et leurs crypto-monnaies. La semaine dernière, une vidéo d’Elon Musk faisant la promotion d’une arnaque à la crypto-monnaie est devenue virale.

Comme le rapporte Rolling Stone, le compte qui a téléchargé la vidéo de Royalty Marie Floyd a été supprimé par TikTok pour « violation de la politique de la plateforme concernant les médias synthétiques représentant des personnes privées ». Néanmoins, le génie est déjà sorti de la bouteille, et des comptes postant des vidéos similaires comblent le vide.

« Malheureusement, des cas d’utilisation comme celui-ci doivent se produire pour que nous puissions faire avancer notre jurisprudence et nos précédents sur des questions déjà fortement débattues concernant la vie privée (avant et après la mort) et la technologie émergente qui, en soi, fonctionne encore principalement dans l’ombre avec nos tribunaux », a déclaré M. Rossow.