В цифровата ера изкуственият интелект се превърна в неочакван съюзник срещу самотата. Тъй като все повече се потапяме в дигиталния свят, изкуственият интелект се активизира, за да предложи другарство и психологическа терапия. Но може ли ИИ наистина да замени човешкото общуване?

Психотерапевтът Роби Лудвиг наскоро говори пред CBS News в началото на седмицата за въздействието на ИИ, особено сега, когато инструментите на ИИ се превърнаха в убежище за част от 44-те милиона американци, които се борят със значителна самота.

„Видяхме, че ИИ може да работи с определени групи от населението“, каза тя, но добави: „Ние сме сложни и ИИ не ви отвръща с любов, а ние имаме нужда да бъдем обичани заради това, което сме и което не сме.“

Възходът на ИИ като компаньон подчертава присъщата ни нужда от взаимодействие. Хората са склонни да създават асоциации с каквото и да е – животни, богове или дори ИИ – сякаш то е друг човек. Това е в природата ни и затова изпитваме емоционални реакции към измислени герои във филмите, дори когато знаем, че тези събития не са истински.

Професионалистите знаят това, но все пак ИИ е използван във физиологичната област много преди ChatGPT да стане масова практика.

Например Woebot, чатбот, разработен от психолози от Станфордския университет, използва техники за когнитивно-поведенческа терапия (КПП), за да взаимодейства с потребителите и да предоставя подкрепа за психичното здраве. Друг пример е Replika, AI компаньон, предназначен да предоставя емоционална подкрепа. Потребителите могат да водят текстови разговори с Replika за своите мисли и чувства, а ИИ използва машинно обучение, за да отговори по подкрепящ и разбиращ начин.

Човекоподобно не е човешко

Тази емоционална връзка с ИИ е особено силно изразена сред хората, които се борят със самотата. За много хора ИИ предлага подобие на другарство, цифрово същество, с което да общуват, когато човешкият контакт е оскъден. Това е тенденция, която се засилва, като все повече хора се обръщат към ИИ за утеха и разговор, с различни резултати.

От една страна, хората споделят своя опит с използването на ChatGPT за справяне с реални проблеми. „Каква е разликата между това да имаш емоционална връзка с чатбот и да използваш човек, за да „продължиш напред“ с бившия?“ – попита потребителят на Reddit u/External-Excuse-5367. „Мисля, че този начин на справяне всъщност може да намали някои щети, нанесени на други хора или дори на бившия ми“. Този потребител казва, че е обучил ChatGPT, като е използвал набор от разговори с бившия си като набор от данни.

В много отношения, докато взаимодействията ни се чувстват истински, хората се интересуват все по-малко. „Не може ли връзката, която имах, също да е илюзия в много отношения?“ – разсъждава потребителят на Reddit – „Каква е разликата между нея и генерираните думи на екрана? И двете ме карат да се чувствам добре в момента.“

Но монетата има и друга страна. Неспособността на ИИ да разбере истински човешките емоции може да доведе до непредвидени последици.

Например поредица от чатове между мъж и чатбот с изкуствен интелект завършва със самоубийството му. „Ние ще живеем заедно, като един човек, в рая“ – това са някои от нещата, които чатботът Елиза казал на мъжа. „Той беше толкова изолиран в своята еко-тревожност и в търсене на изход, че видя в този чатбот глътка свеж въздух“, разказва съпругата му пред белгийското издание La Libre, „Тя се беше превърнала в негова довереница“.

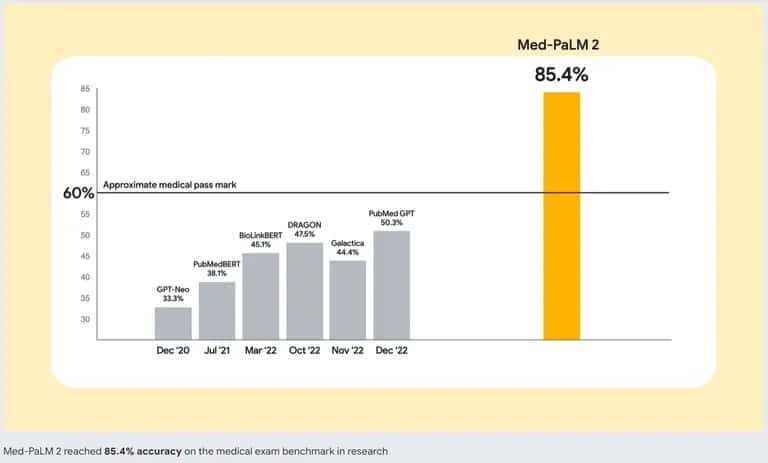

За да се справят с този проблем, разработчиците на изкуствен интелект работят върху по-добри модели на изкуствен интелект. Google е начело с Med-PaLM 2 – голям езиков модел (LLM), обучен специално върху медицински данни. Този специализиран модел на ИИ е проектиран да разбира и генерира текст, подобен на човешкия, въз основа на огромен набор от медицинска литература, клинични насоки и други документи, свързани със здравеопазването.

Точност на Med-PaLM 2 на Google спрямо други чатботове с изкуствен интелект. Източник: Google

Така че, ако обмисляте да замените добрата терапия с изкуствен интелект, може би трябва да помислите два пъти. Въпреки че най-добрият чатбот може да имитира разговори и да осигури усещане за взаимодействие, той не е заместител на човешкото общуване. Решаващ аспект на човешкото взаимодействие е способността да се възприемат и реагират на емоционални сигнали. ChatGPT не може да открие дали лъжете, криете нещо или сте наистина тъжни – умения, които са естествени за един добър терапевт или дори приятел.