Schopnost vytvářet deepfakes slavných a vlivných lidí generované umělou inteligencí vyvolala na internetu pořádnou bouři, ale zatímco obrázky papeže v nadýchaném saku Balenciaga a zatčení bývalého amerického prezidenta Donalda Trumpa se dostaly na titulní stránky novin, podle zprávy časopisu Rolling Stone se objevuje nový trend: deepfakes obětí vražd.

„Zdá se, že jsou navrženy tak, aby vyvolávaly silné emocionální reakce, protože je to nejjistější způsob, jak získat kliknutí a lajky,“ řekl Paul Bleakley, odborný asistent pro trestní právo na univerzitě v New Havenu, časopisu Rolling Stone. „Je nepříjemné se na to dívat, ale myslím, že to může být účel.“

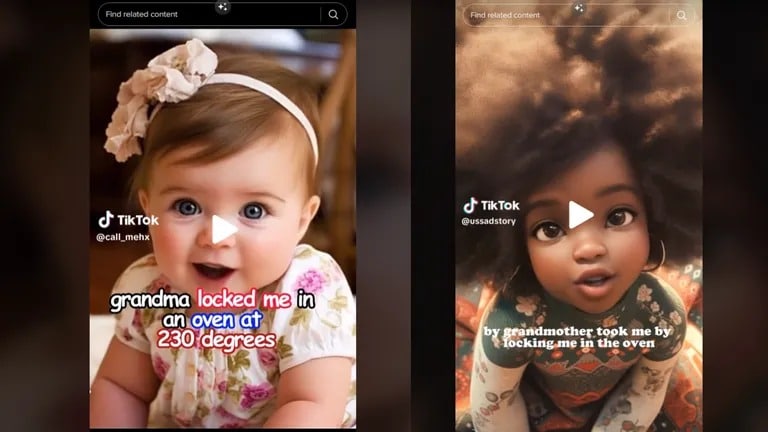

Krátké videoklipy, které obíhají TikTok, zahrnují video generované umělou inteligencí, zvuky a popisy dětí z první osoby. Mezi nejznámější takto zobrazené patří Royalty Marie Floydová, v některých videích prezentovaná jako Rody Mary Floydová, jejíž tělo bylo v roce 2018 nalezeno v peci. Z vraždy Floydové byla obviněna její babička Carolyn Jonesová, uvedl Rolling Stone a dodal, že generátor umělé inteligence také uváděl různý věk a rasu dítěte.

Obrázek: Varianty Royalty Marie Floydové vygenerované umělou inteligencí

Fenomén, který tyto chyby způsobuje, je znám jako halucinace. „Halucinace“ umělé inteligence se týkají případů, kdy umělá inteligence generuje neočekávané, nepravdivé výsledky a nemá oporu v reálných datech. Halucinace AI mohou vytvářet nepravdivý obsah, zprávy nebo informace o osobách, událostech nebo faktech.

„Tyto AI deepfakes skutečných obětí trestných činů rozhodně oživují příběh způsobem, který si nikdo z nás nedokázal představit, což by mohlo pomoci vzdělávat širokou veřejnost,“ řekl TCN právník a generální ředitel společnosti AR Media Andrew Rossow. „Z právního hlediska je však toto využití a použití umělé inteligence velmi znepokojivé a problematické.“

Rossow poukázal na dva hlavní problémy: obavy o soukromí a způsobení citového strádání těm, kteří oběť znali.

Deepfake je stále častěji se vyskytující typ videa vytvořený pomocí umělé inteligence, který zobrazuje falešné události. Deepfakes, které již vzbuzují obavy pracovníků v oblasti kybernetické bezpečnosti a prosazování práva, je stále obtížnější odhalit díky rychle se vyvíjejícím platformám generativní umělé inteligence, jako jsou Midjourney 5.1 a DALL-E 2 společnosti OpenAI.

Midjourney v březnu ukončila svou bezplatnou zkušební verzi poté, co se zvýšil počet virálních deepfakes vytvořených pomocí její technologie.

Rostoucí sílu umělé inteligence využívají také podvodníci, kteří se pomocí této technologie pokoušejí vylákat z potenciálních investorů jejich peníze a kryptoměny. Minulý týden se virálně rozšířilo deepfake video Elona Muska propagující kryptografický podvod.

Jak uvádí Rolling Stone, účet, který video Royalty Marie Floyd nahrál, byl společností TikTok stažen za „porušení zásad platformy týkajících se syntetických médií zobrazujících soukromé osoby“. Přesto je džin již vypuštěn z láhve a účty zveřejňující podobná videa zaplňují mezeru.

„Bohužel k případům použití, jako je tento, musí dojít, abychom mohli pokročit v naší právní judikatuře a precedentech v již tak silně diskutovaných otázkách týkajících se soukromí (před a po smrti) a nyní vznikajících technologií, které samy o sobě stále fungují především v šedi s našimi soudy,“ řekl Rossow.