Brace yourselves: 人工智能可能会导致人类的灭绝。

周二,数百名人工智能行业的领导者和研究人员–包括来自微软、谷歌和OpenAI的高管–发出了一个令人清醒的警告。他们声称,他们正在设计的人工智能技术有一天可能会对人类的生存构成真正的、现实的危险。与大流行病和核战争的恐怖一样,他们认为人工智能也是一种类似程度的社会风险。

在人工智能安全中心发表的一封信中,人工智能专家们提出了这样的声明,其特点是简洁明了: “减轻人工智能带来的灭绝风险应该是一个全球优先事项,与其他社会规模的风险如大流行病和核战争并列。”

就是这样,这就是他们所说的全部。

来源: AI安全中心

该声明将人工智能描绘成一种迫在眉睫的威胁,类似于核灾难或全球大流行病。但签署者,这些技术行业的奇才们,没有对其不祥的警告进行扩展。

这个末日场景究竟应该如何发展?我们应该在什么时候为我们的机器人霸主的崛起标注我们的日历?为什么人工智能这一人类创新的发明会背叛其创造者?这些人工智能的设计师们的沉默是响亮的,他们没有提供答案。

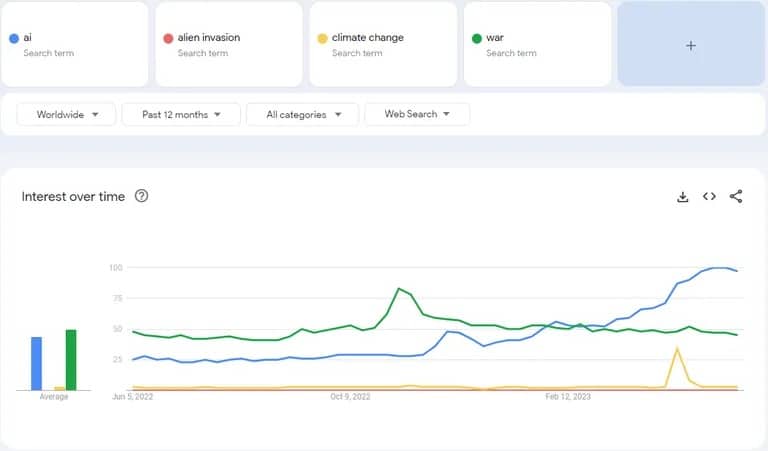

事实上,这些行业领导者的信息量并不比一个带有罐装回复的聊天机器人多。在全球威胁领域,人工智能似乎突然跳出了队列,在谷歌关键词搜索方面击败了气候变化、地缘政治冲突,甚至外星人入侵。

谷歌对人工智能的搜索,与其他全球关注的问题如战争、外星人入侵和气候变化相比。图片: Google

有趣的是,当法规与他们的利益相一致时,公司往往会倡导这些法规。这可以被看作是他们说:”我们希望在制定这些法规方面有所作为 “的方式。这就好比狐狸在鸡舍里为新规则请愿。

另外值得注意的是,OpenAI的首席执行官Sam Altman一直在推动美国的法规。不过,他还是威胁说,如果欧洲大陆的政客继续试图监管人工智能,他将离开欧洲。”我们会努力遵守,”奥特曼在伦敦大学学院的一个专题讨论会上说。”如果我们能遵守,我们会的。如果我们做不到,我们就会停止运营。”

可以说,几天后他又反悔了,说OpenAI没有计划离开欧洲。当然,这是在他有机会在 “非常有成效的一周 “与监管机构讨论这个问题之后发生的。

在欧洲就如何最好地监管人工智能进行了富有成效的一周对话!我们很高兴继续在这里运营,当然也没有计划离开。

– Sam Altman (@sama) May 26, 2023

AI是有风险的,但它有那么大的风险吗?

人工智能的潜在危害在专家中并非没有人注意到。之前有一封由31810名支持者签署的公开信,包括埃隆-马斯克、史蒂夫-沃兹尼亚克、尤瓦尔-哈拉里和安德鲁-杨,呼吁暂停训练强大的人工智能模型。

“这些协议应该确保遵守这些协议的系统是安全的,没有合理的怀疑。”信中说,”这并不意味着暂停一般的人工智能发展,只是从危险的竞赛中退后一步,让具有新兴能力的越来越大的不可预测的黑盒子模型。”

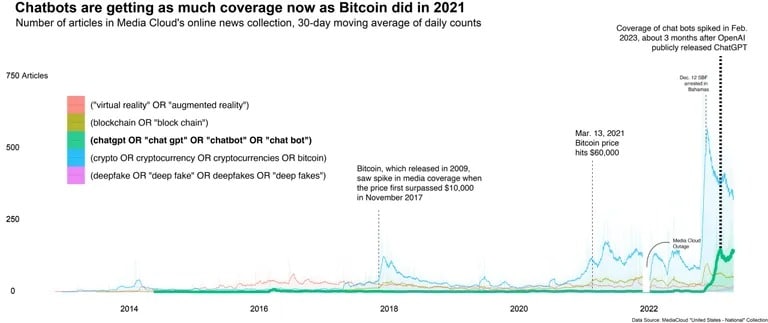

潜在的AI Foom(人工智能有能力改进自己的系统,将其能力提高到超过人类智能的程度)的问题已经讨论了多年。然而,今天的快速变化速度,加上大量的媒体报道,已经将这场辩论推到了全球的聚光灯下。

来源: Columbia Journalism Review

这产生了关于人工智能将如何(不仅仅是可以)影响未来社会互动的不同观点。

一些人设想了一个乌托邦式的时代,在这个时代里,人工智能和人类的互动是一致的,技术的进步是至高无上的。其他人认为,人类将适应人工智能,围绕该技术创造新的就业机会,类似于汽车发明后的就业增长。然而,其他人则认为,人工智能有很大的机会成熟并变得不可控制,对人类构成真正的威胁。

在那之前,人工智能的世界一切如常。密切关注你的ChatGPT,你的Bard,或你的Siri–它们可能只差一个软件更新就能统治世界了。但就目前而言,人类最大的威胁似乎不是我们自己的发明,而是我们无限的夸张才能。