Foi uma história de espionagem empresarial que nem um verdadeiro argumentista humano poderia ter imaginado. A OpenAI, que desencadeou a obsessão global com a IA no ano passado, viu-se nas manchetes com a súbita demissão e eventual reintegração de Sam Altman, o CEO da empresa.

Mesmo com Altman de volta ao seu lugar de origem, permanece uma nuvem de perguntas, incluindo o que aconteceu nos bastidores.

Alguns descreveram o caos como uma batalha de “Sucessão” ou “Game of Thrones” ao nível da HBO. Outros especularam que isso se deveu ao facto de Altman ter mudado a sua atenção para outras empresas, como a Worldcoin.

Mas a teoria mais recente, e mais convincente, diz que ele foi demitido por causa de uma única carta: Q.

Fontes não identificadas disseram à Reuters que a CTO da OpenAI, Mira Murati, disse que uma grande descoberta – descrita como “Q Star” ou “Q*” – foi o ímpeto para a ação contra Altman, que foi executada sem a participação do presidente do conselho Greg Brockman, que posteriormente se demitiu da OpenAI em protesto.

O que é o “Q*” e porque é que nos devemos preocupar? É tudo sobre os caminhos mais prováveis que o desenvolvimento da IA pode tomar a partir daqui.

Desvendando o mistério de Q*

O enigmático Q* citado pela CTO da OpenAI, Mira Murati, deu origem a uma especulação desenfreada na comunidade de IA. Este termo pode referir-se a uma de duas teorias distintas: Q-learning ou o algoritmo Q* do Maryland Refutation Proof Procedure System (MRPPS). Compreender a diferença entre estas duas teorias é crucial para compreender o potencial impacto do Q*.

Teoria 1: Q-Learning

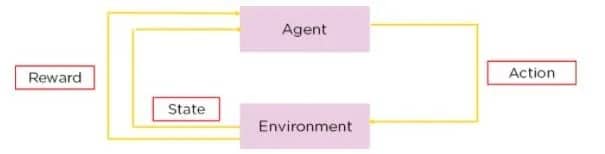

Q-learning é um tipo de aprendizagem por reforço, um método em que a IA aprende a tomar decisões por tentativa e erro. No Q-learning, um agente aprende a tomar decisões estimando a “qualidade” das combinações de estados de ação.

Fonte: Simplilearn

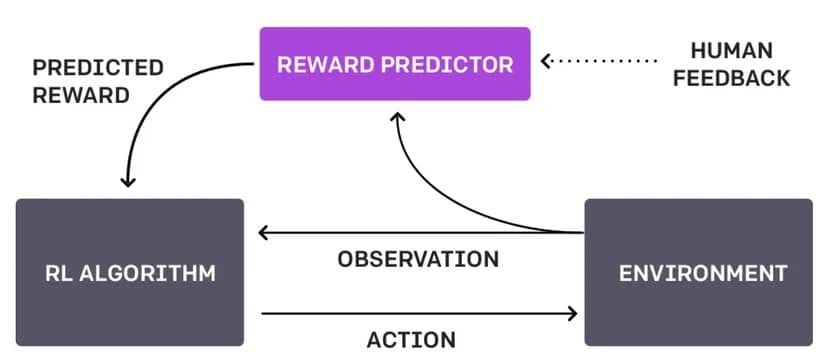

A diferença entre esta abordagem e a abordagem atual da OpenAI – conhecida como Aprendizagem por Reforço através de Feedback Humano ou RLHF – é que não depende da interação humana e faz tudo sozinha.

Diagrama RLHF. Imagem: OpenAI

Imagina um robô a navegar num labirinto. Com o Q-learning, aprende a encontrar o caminho mais rápido para a saída, experimentando diferentes percursos, recebendo recompensas positivas definidas pela sua própria conceção quando se aproxima da saída e recompensas negativas quando chega a um beco sem saída. Com o tempo, através de tentativa e erro, o robô desenvolve uma estratégia (um “Q-table”) que lhe indica a melhor ação a tomar em cada posição no labirinto. Este processo é autónomo, baseando-se nas interacções do robô com o seu ambiente.

Se o robô utilizasse o RLHF, em vez de descobrir as coisas sozinho, um humano poderia intervir quando o robô chegasse a um cruzamento para indicar se a escolha do robô foi sensata ou não.

Este feedback pode ter a forma de comandos directos (“vire à esquerda”), sugestões (“tente o caminho com mais luz”) ou avaliações das escolhas do robô (“bom robô” ou “mau robô”)

No Q-learning, Q* representa o estado desejado em que um agente sabe exatamente a melhor ação a tomar em cada estado para maximizar a sua recompensa total esperada ao longo do tempo. Em termos matemáticos, satisfaz a equação de Bellman.

Em maio, a OpenAI publicou um artigo dizendo que “treinou um modelo para atingir um novo estado da arte na resolução de problemas matemáticos, recompensando cada passo correto do raciocínio em vez de recompensar simplesmente a resposta final correcta”. Se utilizassem o Q-learning ou um método semelhante para o conseguir, isso iria desbloquear todo um novo conjunto de problemas e situações que o ChatGPT seria capaz de resolver nativamente.

Teoria 2: Algoritmo Q* do MRPPS

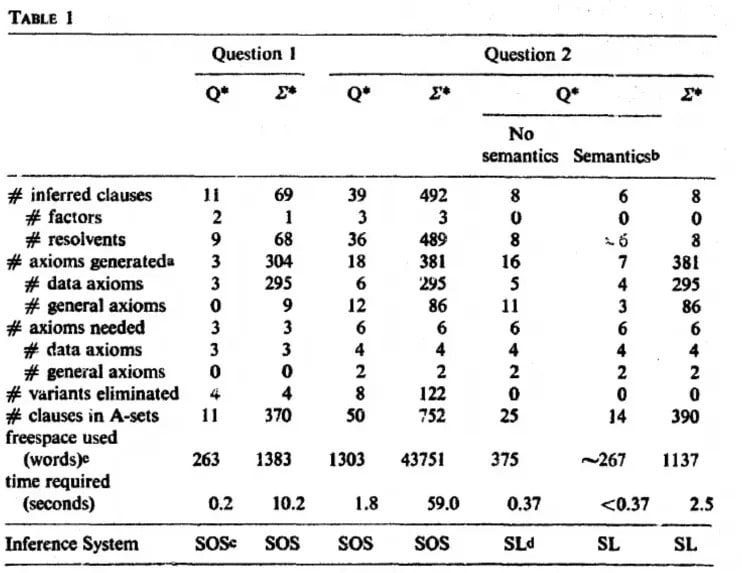

O algoritmo Q* faz parte do Sistema de Procedimento de Prova de Refutação de Maryland (MRPPS). É um método sofisticado para a prova de teoremas em IA, particularmente em sistemas de resposta a perguntas.

“O algoritmo Q∗ gera nós no espaço de pesquisa, aplicando informação semântica e sintáctica para direcionar a pesquisa. A semântica permite que os caminhos sejam terminados e que os caminhos frutíferos sejam explorados”, lê-se no documento de investigação.

Imagem: Jack Minker

Uma forma de explicar o processo é considerar o detetive fictício Sherlock Holmes a tentar resolver um caso complexo. Ele reúne pistas (informação semântica) e liga-as logicamente (informação sintáctica) para chegar a uma conclusão. O algoritmo Q* funciona de forma semelhante na IA, combinando informação semântica e sintáctica para navegar em processos complexos de resolução de problemas.

Isto implicaria que a OpenAI está um passo mais perto de ter um modelo capaz de compreender a sua realidade para além de meras instruções de texto e mais em linha com o J.A.R.V.I.S fictício (para os GenZers) ou o Bat Computer (para os boomers).

Assim, enquanto o Q-learning consiste em ensinar a IA a aprender a partir da interação com o seu ambiente, o algoritmo Q tem mais a ver com a melhoria das capacidades dedutivas da IA. Compreender estas distinções é fundamental para apreciar as potenciais implicações do “Q” da OpenAI. Ambos têm um potencial imenso no avanço da IA, mas as suas aplicações e implicações variam significativamente.

Tudo isto não passa de especulação, claro, uma vez que a OpenAI não explicou o conceito nem confirmou ou negou os rumores de que o Q* – seja ele qual for – existe de facto.

Implicações potenciais do ‘Q’*

O rumoroso “Q*” da OpenAI pode ter um impacto vasto e variado. Se for uma forma avançada de aprendizagem Q, poderá significar um salto na capacidade da IA para aprender e adaptar-se autonomamente em ambientes complexos, resolvendo todo um novo conjunto de problemas. Este avanço poderia melhorar as aplicações da IA em áreas como os veículos autónomos, onde a tomada de decisões em fracções de segundo com base em condições em constante mudança é crucial.

Por outro lado, se “Q” estiver relacionado com o algoritmo Q do MRPPS, poderá marcar um avanço significativo no raciocínio dedutivo da IA e nas suas capacidades de resolução de problemas. Isto teria um impacto especial em domínios que exigem um pensamento analítico profundo, como a análise jurídica, a interpretação de dados complexos e até o diagnóstico médico.

Independentemente da sua natureza exacta, o “Q*” representa potencialmente um passo significativo no desenvolvimento da IA, pelo que o facto de estar no centro de um debate existencial da OpenAI soa a verdade. Poderá aproximar-nos de sistemas de IA mais intuitivos, eficientes e capazes de realizar tarefas que atualmente exigem elevados níveis de especialização humana. No entanto, com estes avanços surgem questões e preocupações sobre a ética da IA, a segurança e as implicações de sistemas de IA cada vez mais poderosos na nossa vida quotidiana e na sociedade em geral.

Os bons e os maus do Q*

Benefícios potenciais do Q*:

Melhoria na resolução de problemas e eficiência: Se Q* for uma forma avançada de Q-learning ou do algoritmo Q*, poderá conduzir a sistemas de IA que resolvam problemas complexos de forma mais eficiente, beneficiando sectores como a saúde, as finanças e a gestão ambiental.

Melhor colaboração entre humanos e IA: Uma IA com capacidades de aprendizagem ou dedutivas melhoradas poderia aumentar o trabalho humano, conduzindo a uma colaboração mais eficaz na investigação, na inovação e nas tarefas diárias.

Avanços na automatização: O “Q*” poderá conduzir a tecnologias de automatização mais sofisticadas, melhorando a produtividade e criando potencialmente novas indústrias e oportunidades de emprego.

Riscos e preocupações:

Questões éticas e de segurança: À medida que os sistemas de IA se tornam mais avançados, garantir que funcionam de forma ética e segura torna-se cada vez mais difícil. Existe o risco de consequências não intencionais, especialmente se as acções da IA não estiverem perfeitamente alinhadas com os valores humanos.

Privacidade e segurança: Com uma IA mais avançada, as preocupações com a privacidade e a segurança dos dados aumentam. Os sistemas de IA capazes de compreender e interagir mais profundamente com os dados podem ser utilizados de forma abusiva. Imagine-se, por exemplo, uma IA que telefona ao seu parceiro romântico quando o está a trair, porque sabe que trair é mau.

Impactos económicos: O aumento da automatização e das capacidades de IA pode levar à deslocação de postos de trabalho em determinados sectores, exigindo ajustamentos sociais e novas abordagens ao desenvolvimento da força de trabalho. Se uma IA pode fazer quase tudo, porquê ter trabalhadores humanos?

Desalinhamento da IA: O risco de os sistemas de IA poderem desenvolver objectivos ou métodos de funcionamento desalinhados com as intenções ou o bem-estar dos seres humanos, conduzindo potencialmente a resultados prejudiciais. Imagine um robô de limpeza que está obcecado com a arrumação e está sempre a deitar fora os seus papéis importantes? Ou que elimina completamente os criadores de confusão?

O mito da AGI

O que é que o rumoroso Q* da OpenAI tem a ver com a procura da Inteligência Artificial Geral (AGI) – o Santo Graal da investigação em IA?

A AGI refere-se à capacidade de uma máquina para compreender, aprender e aplicar inteligência em várias tarefas, semelhante às capacidades cognitivas humanas. É uma forma de IA que pode generalizar a aprendizagem de um domínio para outro, demonstrando uma verdadeira adaptabilidade e versatilidade.

Independentemente do facto de Q ser uma forma avançada de Q-learning ou estar relacionado com o algoritmo Q, é essencial compreender que isto não equivale a alcançar a AGI. Embora o “Q*” possa representar um avanço significativo em termos de capacidades específicas de IA, a IAG engloba uma gama mais vasta de competências e conhecimentos.

Alcançar a AGI significaria desenvolver uma IA capaz de realizar qualquer tarefa intelectual que um ser humano possa realizar – um marco difícil de alcançar.

Uma máquina que tenha atingido o Q não tem consciência da sua própria existência e ainda não consegue raciocinar para além dos limites dos seus dados de pré-treino e dos algoritmos definidos pelo homem. Portanto, não, apesar do burburinho, o “Q” ainda não é o prenúncio dos nossos senhores da IA; é mais como uma torradeira inteligente que aprendeu a pôr manteiga no seu próprio pão.

Quanto ao facto de a AGI anunciar o fim da civilização, talvez estejamos a sobrestimar a nossa importância na hierarquia cósmica. O Q* da OpenAI pode estar um passo mais perto da IA dos nossos sonhos (ou pesadelos), mas não é bem a AGI que vai refletir sobre o sentido da vida ou sobre a sua própria existência em silício.

Lembrem-se que esta é a mesma OpenAI que tem estado a olhar cautelosamente para o seu ChatGPT como um pai a observar uma criança com um marcador – orgulhosa, mas perpetuamente preocupada com a possibilidade de desenhar nas paredes da humanidade. Embora o “Q*” seja um salto, a AGI continua a estar a um passo de distância, e o muro da humanidade está seguro por agora.