Ha sido una historia de espionaje corporativo que ni siquiera un guionista humano real podría haber soñado. OpenAI, que desencadenó la obsesión mundial por la IA el año pasado, apareció en los titulares con el repentino despido y posterior reincorporación de Sam Altman, consejero delegado de la empresa.

Incluso con Altman de vuelta en su puesto, sigue habiendo una nube de preguntas, como qué ocurrió entre bastidores.

Algunos describieron el caos como una batalla al nivel de «Sucesión» o «Juego de Tronos» de la HBO. Otros especulan que se debió a que Altman cambió su enfoque hacia otras empresas como Worldcoin.

Pero la última teoría, y la más convincente, dice que fue despedido por una sola carta: Q.

Fuentes anónimas dijeron a Reuters que Mira Murati, CTO de OpenAI, dijo que un descubrimiento importante -descrito como «Q Star» o «Q*»- fue el impulso para la medida contra Altman, que se ejecutó sin la participación del presidente de la junta Greg Brockman, quien posteriormente dimitió de OpenAI en protesta.

¿Qué es «Q*» y por qué debería importarnos? Todo gira en torno a los caminos más probables que podría tomar el desarrollo de la IA a partir de ahora.

Desvelando el misterio de Q*

La enigmática Q* citada por la CTO de OpenAI, Mira Murati, ha dado lugar a un sinfín de especulaciones en la comunidad de la IA. Este término podría referirse a una de dos teorías distintas: Q-learning o el algoritmo Q* del Maryland Refutation Proof Procedure System (MRPPS). Entender la diferencia entre ambas es crucial para comprender el impacto potencial de Q*.

Teoría 1: Aprendizaje Q

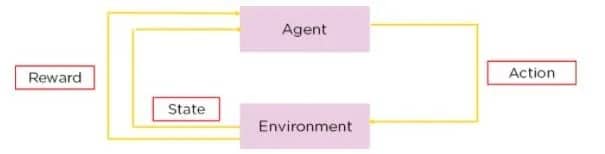

El aprendizaje Q es un tipo de aprendizaje por refuerzo, un método con el que la IA aprende a tomar decisiones por ensayo y error. En el aprendizaje Q, un agente aprende a tomar decisiones estimando la «calidad» de las combinaciones de acción y estado.

Fuente: Simplilearn

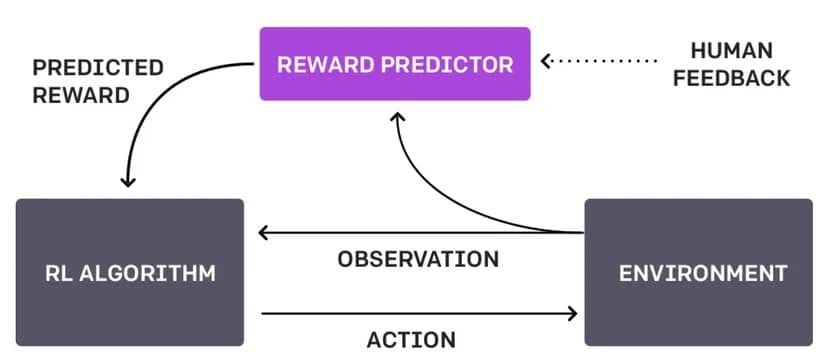

La diferencia entre este enfoque y el actual de OpenAI -conocido como Aprendizaje por Refuerzo a través de la Retroalimentación Humana o RLHF- es que no depende de la interacción humana y lo hace todo por sí mismo.

Diagrama RLHF. Imagen: OpenAI

Imagina un robot recorriendo un laberinto. Con el aprendizaje Q, aprende a encontrar el camino más rápido hacia la salida probando diferentes rutas, recibiendo recompensas positivas establecidas por su propio diseño cuando se acerca a la salida y recompensas negativas cuando llega a un callejón sin salida. Con el tiempo, y a base de ensayo y error, el robot desarrolla una estrategia (una «tabla Q») que le indica la mejor acción a realizar desde cada posición en el laberinto. Este proceso es autónomo y depende de las interacciones del robot con su entorno.

Si el robot utilizara RLHF, en lugar de descubrir las cosas por sí mismo, un humano podría intervenir cuando el robot llegara a un cruce para indicarle si su elección ha sido acertada o no.

Esta información puede consistir en órdenes directas («gira a la izquierda»), sugerencias («prueba el camino con más luz») o evaluaciones de las elecciones del robot («buen robot» o «mal robot»).

En el aprendizaje Q, Q* representa el estado deseado en el que un agente conoce exactamente la mejor acción que debe realizar en cada estado para maximizar su recompensa total esperada a lo largo del tiempo. En términos matemáticos, satisface la ecuación de Bellman.

En mayo, OpenAI publicó un artículo en el que afirmaba haber «entrenado un modelo para alcanzar un nuevo estado del arte en la resolución de problemas matemáticos recompensando cada paso correcto del razonamiento en lugar de recompensar simplemente la respuesta final correcta». Si utilizaran Q-learning o un método similar para lograrlo, eso desbloquearía todo un nuevo conjunto de problemas y situaciones que ChatGPT podría resolver de forma nativa.

Teoría 2: Algoritmo Q* de MRPPS

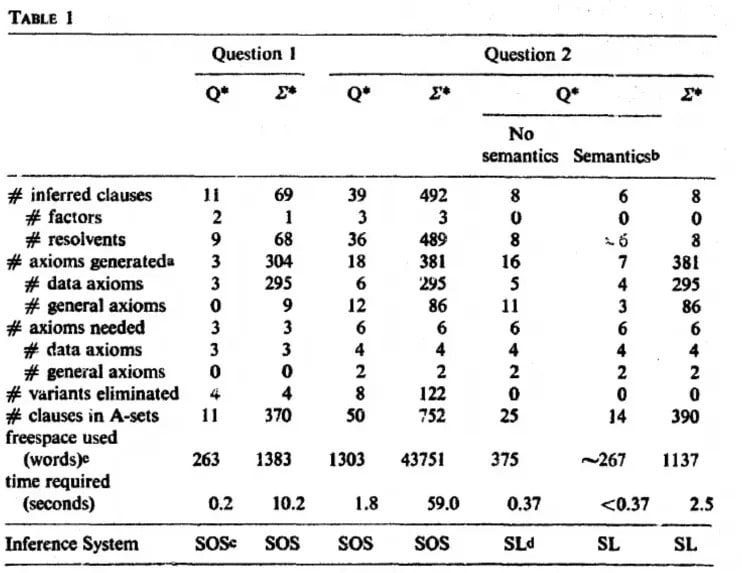

El algoritmo Q* forma parte del Sistema de Procedimientos de Prueba de Refutación de Maryland (MRPPS). Se trata de un sofisticado método de demostración de teoremas en Inteligencia Artificial, especialmente en sistemas de respuesta a preguntas.

«El algoritmo Q∗ genera nodos en el espacio de búsqueda, aplicando información semántica y sintáctica para dirigir la búsqueda. La semántica permite terminar los caminos y explorar los fructíferos», se lee en el artículo de investigación.

Imagen: Jack Minker

Una forma de explicar el proceso es considerar al detective ficticio Sherlock Holmes intentando resolver un caso complejo. Reúne pistas (información semántica) y las conecta lógicamente (información sintáctica) para llegar a una conclusión. El algoritmo Q* funciona de forma similar en la IA, combinando información semántica y sintáctica para navegar por procesos complejos de resolución de problemas.

Esto implicaría que OpenAI está un paso más cerca de tener un modelo capaz de entender su realidad más allá de las meras indicaciones de texto y más en línea con el ficticio J.A.R.V.I.S (para los GenZers) o el Batordenador (para los boomers).

Así pues, mientras que el aprendizaje Q consiste en enseñar a la IA a aprender de la interacción con su entorno, el algoritmo Q trata más bien de mejorar las capacidades deductivas de la IA. Entender estas distinciones es clave para apreciar las implicaciones potenciales de «Q» de OpenAI. Ambos tienen un inmenso potencial para hacer avanzar la IA, pero sus aplicaciones e implicaciones varían significativamente.

Por supuesto, todo esto no son más que especulaciones, ya que OpenAI no ha explicado el concepto ni ha confirmado o desmentido los rumores de que Q*, sea lo que sea, exista realmente.

Potenciales implicaciones de ‘Q’*

La rumoreada ‘Q*’ de OpenAI podría tener un impacto vasto y variado. Si se trata de una forma avanzada de aprendizaje Q, podría significar un salto en la capacidad de la IA para aprender y adaptarse de forma autónoma en entornos complejos, resolviendo toda una nueva serie de problemas. Este avance podría mejorar las aplicaciones de la IA en áreas como los vehículos autónomos, donde es crucial tomar decisiones en fracciones de segundo en función de las condiciones cambiantes.

Por otro lado, si «Q» se refiere al algoritmo Q de MRPPS, podría suponer un importante paso adelante en el razonamiento deductivo y la capacidad de resolución de problemas de la IA. Esto tendría especial repercusión en campos que requieren un pensamiento analítico profundo, como el análisis jurídico, la interpretación de datos complejos e incluso el diagnóstico médico.

Independientemente de su naturaleza exacta, «Q*» representa potencialmente un avance significativo en el desarrollo de la IA, por lo que el hecho de que esté en el centro de un debate existencial de OpenAI suena a verdad. Podría acercarnos a sistemas de IA más intuitivos, eficientes y capaces de manejar tareas que actualmente requieren altos niveles de experiencia humana. Sin embargo, con estos avances surgen preguntas y preocupaciones sobre la ética de la IA, la seguridad y las implicaciones de los sistemas de IA cada vez más potentes en nuestra vida cotidiana y en la sociedad en general.

Lo bueno y lo malo de Q*

Beneficios potenciales de Q*:

Mayor eficacia y resolución de problemas: Si Q* es una forma avanzada de aprendizaje Q o del algoritmo Q*, podría dar lugar a sistemas de IA que resolvieran problemas complejos de forma más eficiente, lo que beneficiaría a sectores como la sanidad, las finanzas y la gestión medioambiental.

Mejor colaboración entre humanos e IA: Una IA con mejores capacidades de aprendizaje o deductivas podría aumentar el trabajo humano, dando lugar a una colaboración más eficaz en la investigación, la innovación y las tareas cotidianas.

Avances en la automatización: ‘Q*’ podría dar lugar a tecnologías de automatización más sofisticadas, mejorando la productividad y creando potencialmente nuevas industrias y oportunidades de empleo.

Riesgos y preocupaciones:

Cuestiones éticas y de seguridad: A medida que los sistemas de IA se vuelven más avanzados, garantizar que funcionan de forma ética y segura resulta cada vez más difícil. Existe el riesgo de que se produzcan consecuencias no deseadas, especialmente si las acciones de la IA no están perfectamente alineadas con los valores humanos.

Privacidad y seguridad: Con una IA más avanzada, aumentan los problemas de privacidad y seguridad de los datos. Los sistemas de IA capaces de comprender e interactuar más profundamente con los datos podrían ser mal utilizados. Imagínese una IA que llame a su pareja romántica cuando la está engañando porque sabe que el engaño es malo.

Impactos económicos: El aumento de la automatización y de las capacidades de la IA podría provocar el desplazamiento de puestos de trabajo en determinados sectores, lo que requeriría ajustes sociales y nuevos enfoques para el desarrollo de la mano de obra. Si una IA puede hacerlo casi todo, ¿para qué tener trabajadores humanos?

Desajuste de la IA: El riesgo de que los sistemas de IA desarrollen objetivos o métodos de funcionamiento que no se ajusten a las intenciones o el bienestar humanos, lo que podría dar lugar a resultados perjudiciales. ¿Imagina un robot de limpieza obsesionado con el orden y que no para de tirar papeles importantes? ¿O que elimina por completo a los creadores de desorden?

El mito de la AGI

¿Qué lugar ocupa el rumoreado Q* de OpenAI en la búsqueda de la Inteligencia Artificial General (IAG), el santo grial de la investigación en IA?

La AGI se refiere a la capacidad de una máquina para comprender, aprender y aplicar la inteligencia a diversas tareas, de forma similar a las capacidades cognitivas humanas. Es una forma de IA que puede generalizar el aprendizaje de un dominio a otro, demostrando una verdadera adaptabilidad y versatilidad.

Independientemente de si Q es una forma avanzada de aprendizaje Q o está relacionado con el algoritmo Q, es esencial entender que esto no equivale a alcanzar la AGI. Mientras que «Q*» puede representar un avance significativo en las capacidades específicas de la IA, la AGI abarca una gama más amplia de habilidades y conocimientos.

Alcanzar la AGI significaría desarrollar una IA capaz de realizar cualquier tarea intelectual que pueda realizar un ser humano, un hito difícil de alcanzar.

Una máquina que ha logrado Q no es consciente de su propia existencia y aún no puede razonar más allá de los límites de sus datos de preentrenamiento y algoritmos establecidos por el ser humano. Así que no, a pesar de los rumores, «Q» no es todavía el precursor de nuestros señores de la IA; es más como una tostadora inteligente que ha aprendido a untar su propio pan con mantequilla.

En cuanto a que la inteligencia artificial marque el fin de la civilización, puede que estemos sobrestimando nuestra importancia en el orden jerárquico cósmico. La Q* de OpenAI podría estar un paso más cerca de la IA de nuestros sueños (o pesadillas), pero no es exactamente la AGI que reflexionará sobre el sentido de la vida o sobre su propia existencia de silicio.

Recordemos que se trata de la misma OpenAI que ha estado observando cautelosamente su ChatGPT como un padre que vigila a un niño pequeño con un rotulador: orgullosa, pero siempre preocupada de que dibuje en los muros de la humanidad. Aunque «Q*» es un salto, AGI sigue estando a otro paso, y el muro de la humanidad está a salvo por ahora.