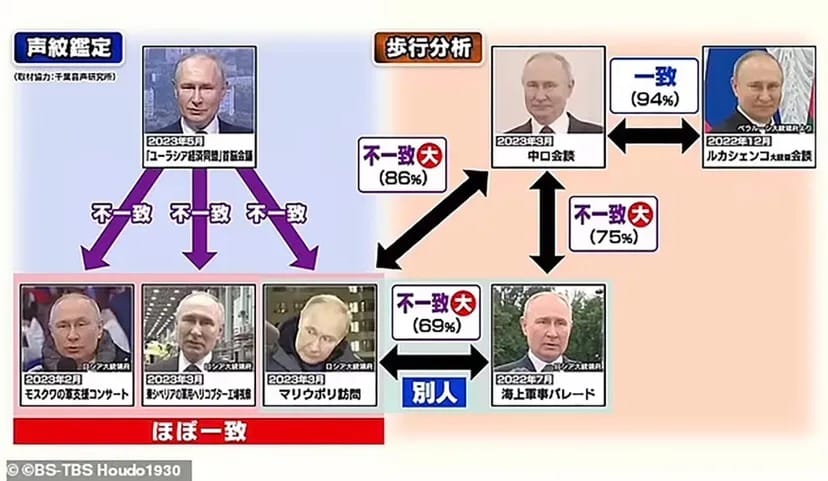

Artykuł w mediach informacyjnych na nowo rozpalił plotki o tym, że Władimir Putin korzysta z usług dublera podczas publicznych wystąpień.

DailyMail donosi, że to uporczywe i bezpodstawne twierdzenie pojawiło się ponownie w Japonii po tym, jak krążyło przez kilka miesięcy. Japońscy badacze przeanalizowali nagrania wideo i zdjęcia przedstawiające Putina podczas różnych wydarzeń i zasugerowali, że grały go co najmniej trzy osoby. Podczas gdy takie twierdzenia są natychmiast obalane przez Kreml, historia ta ilustruje efekt uboczny szybkiego postępu sztucznej inteligencji – rozwój deepfake’ów.

AI deepfaking to technologia, która wykorzystuje algorytmy do zamiany twarzy w filmach, obrazach i innych treściach cyfrowych, aby podróbka wyglądała na prawdziwą. Deepfakes są uznawane za nowe, niebezpieczne narzędzie manipulacji politycznej. Wykrywanie deepfake’ów stało się rozwijającą się branżą, a lider generatywnej sztucznej inteligencji OpenAI twierdzi, że jest w stanie zidentyfikować deepfake’i z 99% dokładnością.

Jednak według naukowców nie jest to łatwe i będzie coraz trudniejsze

Japońska stacja telewizyjna TBS poinformowała o badaniu opartym na sztucznej inteligencji sugerującym, że prezydent Rosji Władimir Putin zatrudnia sobowtórów, aby uczestniczyć w różnych wydarzeniach. Image from: Daily Mail

Prezes i dyrektor generalny Digimark, Riley McCormack, powiedział TCN: „Próbowane są techniki probabilistyczne w celu ustalenia, czy jest to sztuczna inteligencja, czy nie”. Jak widać po przyjrzeniu się wielu z tych metod, najlepsze z nich są dość niedokładne”.

Założona w 1994 roku firma Digimarc zapewnia cyfrowe znaki wodne, które pomagają identyfikować i chronić zasoby cyfrowe oraz właścicieli praw autorskich. Cyfrowy znak wodny jest jedną z najczęściej proponowanych metod identyfikacji głębokich podróbek, a firmy takie jak Google badają to podejście.

Podczas Google Cloud Next w San Francisco, Alphabet i dyrektor generalny Google Sundar Pichai zaprezentowali możliwości znakowania wodnego platformy Google Vertix AI.

Pichai powiedział: „Korzystając z technologii dostarczonej przez Google Deepmind, obrazy generowane przez Vertex AI mogą być oznaczone znakiem wodnym w sposób niewidoczny dla ludzkiego oka, bez uszczerbku dla jakości obrazu”.

Jako strategia, znak wodny ma jednak szereg słabości. McCormack powiedział, że aby znak wodny mógł powstrzymać głębokie podróbki sztucznej inteligencji, wszyscy musieliby przyjąć tę samą metodę, aby pokazać, czy został wygenerowany przez sztuczną inteligencję, czy jest prawdziwy.

„Problem z generatywną sztuczną inteligencją wykorzystującą tylko znak wodny polega na tym, że nie wszystkie silniki generatywnej sztucznej inteligencji ją przyjmą. „Każdy system autentyczności, o ile nie jest wszechobecny, jest bezużyteczny, jeśli po prostu oznaczysz go w ten czy inny sposób.

Ponieważ generatory obrazów sztucznej inteligencji pobierają ogólnodostępne obrazy z Internetu i mediów społecznościowych, inni eksperci zalecają stosowanie trujących pigułek poprzez dołączenie kodu do degradacji obrazów w generatorze lub błędne oznaczanie danych.

Deepfake

AI został stworzony, aby podszyć się pod prezydenta USA Joe Bidena, papieża Franciszka i byłego prezydenta Donalda Trumpa. Technologia deepfake poprawia się z dnia na dzień, a detektory AI grają w whack-a-mole w wyścigu, aby nadrobić zaległości.

Dodatkowym zagrożeniem związanym z deepfake’ami AI jest wzrost liczby generowanych przez AI materiałów dla dorosłych przedstawiających dzieci w celach seksualnych (CSAM). Według raportu opublikowanego w październiku przez brytyjską organizację Internet Watch Foundation, pornografia dziecięca szybko rozprzestrzenia się w Internecie przy użyciu modeli AI typu open source, które mogą być używane i rozpowszechniane za darmo.

IWF zasugerowała, że głęboka fałszywa pornografia sprawia, że coraz trudniej jest odróżnić obrazy dzieci generowane przez sztuczną inteligencję od rzeczywistych obrazów dzieci, co prowadzi organy ścigania do ścigania fantomów online, a nie rzeczywistych ofiar nadużyć.

Dan Sexton, CTO Internet Watch Foundation, powiedział TCN: „Nie jestem pewien, ile z nich jest prawdziwych”. „Nic nie mówi nam w 100%, czy coś jest prawdziwe, czy nie”.

Inną kwestią poruszoną przez McCormacka jest to, że wiele modeli sztucznej inteligencji dostępnych na rynku ma charakter open source i może być używanych, modyfikowanych i udostępnianych bez ograniczeń.

„Kiedy wprowadzasz technologię bezpieczeństwa do systemu open source, nakładasz na niego blokadę. „Umieszczasz tam zamek, a tuż obok niego umieszczasz plan, jak go otworzyć, więc nie ma to zbyt dużej wartości”.

W miarę jak większe modele, takie jak Stability Diffusion, Mid Journey i Dall-E, stają się coraz lepsze i utrzymują mocniejsze poręcze, starsze modele, które mogą lokalnie tworzyć CSAM, będą rzadziej używane. Łatwiej będzie również stwierdzić, który model stworzył obraz, mówi.

„Trudniej będzie robić tego typu rzeczy, będą one bardziej niszowe”.

Podczas gdy przywódcy rządowi są głównymi celami deepfake’ów AI, coraz więcej hollywoodzkich celebrytów wykorzystuje swoją podobiznę w oszustwach internetowych i reklamach wykorzystujących deepfake’i AI.

Hollywoodzka aktorka Scarlett Johansson oświadczyła, że podejmuje kroki prawne przeciwko firmie Lisa AI, która wykorzystała wygenerowane przez sztuczną inteligencję obrazy gwiazdy Avengers w reklamie, aby powstrzymać nieautoryzowane wykorzystanie jej wizerunku. W zeszłym miesiącu potentat YouTube Mr Beast ostrzegł swoich zwolenników przed oszustwem internetowym wykorzystującym jego podobiznę, a nawet Tom Hanks stał się ofiarą kampanii deepfake AI wykorzystującej jego podobiznę.

We wrześniu papież Franciszek, będący przedmiotem wielu deepfake’ów AI, umieścił tę technologię w centrum swojego świątecznego kazania z okazji Światowego Dnia Pokoju. Przywódca religijny wezwał do otwartego dialogu na temat sztucznej inteligencji i jej znaczenia dla ludzkości.

„Niezwykłe postępy w dziedzinie sztucznej inteligencji szybko wpływają na ludzką działalność, życie osobiste i społeczne, politykę i ekonomię” – powiedział Franciszek.

McCormack powiedział, że wraz z poprawą narzędzi do wykrywania sztucznej inteligencji, narzędzia do generowania deepfake’ów również się poprawią, co doprowadzi do nowego frontu w wyścigu zbrojeń sztucznej inteligencji, który rozpoczął się wraz z uruchomieniem ChatGPT w zeszłym roku.

„Generatywna sztuczna inteligencja nie stworzyła problemu deepfake ani problemu dezinformacji. powiedział McCormack.