Agárrense: La IA puede provocar la extinción de la humanidad.

El martes, cientos de líderes e investigadores de la industria de la inteligencia artificial, entre ellos ejecutivos de Microsoft, Google y OpenAI, lanzaron una advertencia aleccionadora. Afirman que la tecnología de inteligencia artificial que están desarrollando podría suponer algún día un peligro real y presente para la existencia de la humanidad. Junto a los horrores de las pandemias y las guerras nucleares, consideran la IA un riesgo social de magnitud similar.

En una carta publicada por el Center for AI Safety, los especialistas en IA ofrecían esta declaración caracterizada por su cruda brevedad: «Mitigar el riesgo de extinción de la IA debería ser una prioridad mundial junto a otros riesgos de escala social como las pandemias y la guerra nuclear».

Eso es todo lo que dicen.

Fuente: Center for AI Safety

La declaración describe la IA como una amenaza inminente, similar a un desastre nuclear o una pandemia mundial. Pero los firmantes, estos magos de la industria tecnológica, no ampliaron su ominosa advertencia.

¿Cómo se supone exactamente que se desarrollará este escenario del fin de los días? ¿Cuándo debemos marcar en el calendario la llegada de nuestros señores robots? ¿Por qué la IA, un invento de la innovación humana, se volvería contra sus creadores? El silencio de estos arquitectos de la inteligencia artificial fue rotundo, y no dieron ninguna respuesta.

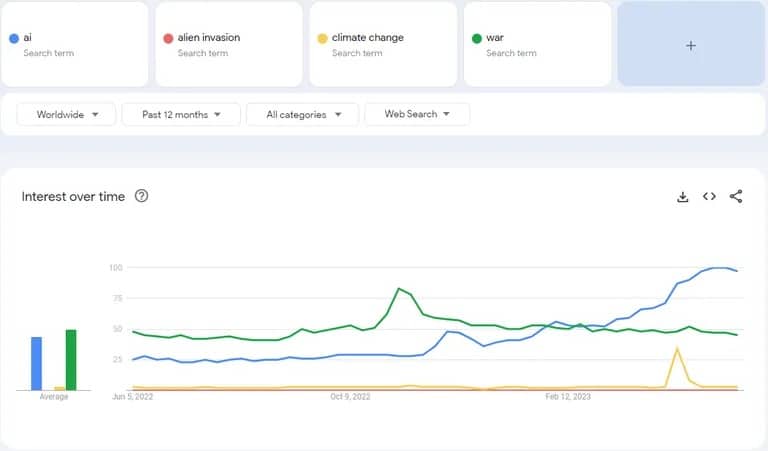

De hecho, esos líderes de la industria no fueron más informativos que un chatbot con una respuesta enlatada. En el ámbito de las amenazas globales, la IA parece haber saltado de repente a la cola, superando al cambio climático, los conflictos geopolíticos e incluso las invasiones alienígenas en términos de búsquedas de palabras clave en Google.

Búsquedas en Google sobre IA, comparadas con otras preocupaciones globales como la guerra, las invasiones alienígenas y el cambio climático. Imagen: Google

Es interesante observar que las empresas tienden a defender las normativas cuando coinciden con sus intereses. Podría considerarse su forma de decir: «Queremos participar en la elaboración de esta normativa». Es como si el zorro pidiera nuevas normas en el gallinero.

También es destacable que Sam Altman, consejero delegado de OpenAI, ha estado presionando para que se establezcan normativas en Estados Unidos. Aun así, amenazó con abandonar Europa si los políticos del continente seguían intentando regular la IA. «Vamos a intentar cumplir», dijo Altman en un panel en el University College de Londres. «Si podemos cumplir, lo haremos. Y si no podemos, dejaremos de operar».

Es justo decir que, un par de días después, dio marcha atrás y afirmó que OpenAI no tenía planes de abandonar Europa. Esto, por supuesto, ocurrió después de que tuviera la oportunidad de hablar con los reguladores sobre el tema en una «semana muy productiva».

Semana muy productiva de conversaciones en Europa sobre la mejor manera de regular la IA. Estamos encantados de seguir operando aquí y, por supuesto, no tenemos planes de irnos.

– Sam Altman (@sama) 26 de mayo de 2023

La IA es arriesgada, pero ¿tanto?

Los peligros potenciales de la inteligencia artificial no han pasado desapercibidos entre los expertos. Una carta abierta anterior firmada por 31.810 adhesiones, entre ellas las de Elon Musk, Steve Wozniak, Yuval Harari y Andrew Yang, pedía una pausa en el entrenamiento de modelos de IA potentes.

«Estos protocolos deben garantizar que los sistemas que se adhieran a ellos sean seguros más allá de toda duda razonable», dice la carta, aclarando que «esto no significa una pausa en el desarrollo de la IA en general, simplemente un paso atrás en la peligrosa carrera hacia modelos de caja negra impredecibles cada vez más grandes con capacidades emergentes».

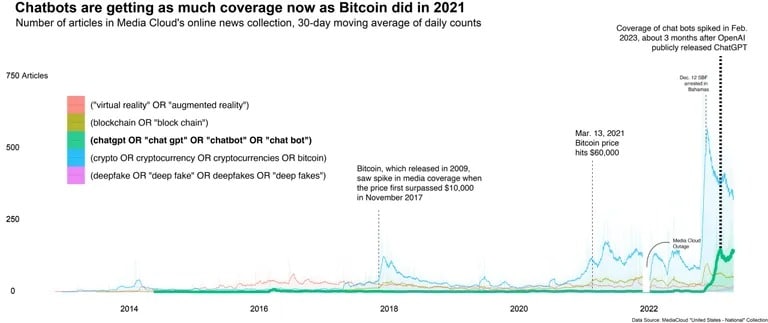

La cuestión de un posible Foom de la IA, (en el que una IA llegue a ser capaz de mejorar sus propios sistemas, aumentando sus capacidades hasta el punto de superar la inteligencia humana), lleva años debatiéndose. Sin embargo, el rápido ritmo de cambio actual, unido a la gran cobertura mediática, ha puesto el debate en el punto de mira mundial.

Fuente: Columbia Journalism Review

Esto ha generado diversas opiniones sobre cómo afectará (no sólo podría afectar) la IA al futuro de las interacciones sociales.

Algunos imaginan una era utópica en la que la IA y los humanos interactúan alineados, y el avance tecnológico reina supremo. Otros creen que la humanidad se adaptará a la IA y que se crearán nuevos puestos de trabajo en torno a la tecnología, de forma similar al crecimiento del empleo que siguió a la invención del automóvil. Sin embargo, otros sostienen que la IA tiene muchas posibilidades de madurar y volverse incontrolable, lo que supondría una amenaza real para la humanidad.

Hasta entonces, todo seguirá igual en el mundo de la IA. No pierdas de vista tu ChatGPT, tu Bard o tu Siri: podrían estar a una actualización de software de dominar el mundo. Pero por ahora, parece que la mayor amenaza de la humanidad no son nuestros inventos, sino nuestro talento ilimitado para la hipérbole.