Meta hat am Donnerstag einen ersten Blick auf seine beiden neuesten KI-Tools, Emu Video und Emu Edit, geworfen und damit die auf der Meta Connect im September angekündigte Technologie zum ersten Mal wirklich vorgestellt. Emu Video ist ein Tool, mit dem Benutzer Videos aus reinen Textanweisungen erstellen können, während Emu Edit einen anderen Ansatz für die Bildbearbeitung vorstellt, der als Inpainting bekannt ist.

Heute stellen wir zwei neue Fortschritte in unserer generativen KI-Forschung vor: Emu Video & Emu Edit.

Details ➡️ https://t.co/qm8aejgNtd

Diese neuen Modelle liefern aufregende Ergebnisse im Bereich der qualitativ hochwertigen, diffusionsbasierten Text-zu-Video-Generierung & kontrollierte Bildbearbeitung mit Textanweisungen.

– AI at Meta (@AIatMeta) November 16, 2023

Die Einführung von Emu Video und Emu Edit ist ein strategischer Schritt für Meta, der nach eigenen Angaben mit der breiteren Vision für das Metaverse übereinstimmt. Nach Angaben des Unternehmens bieten diese Tools neue kreative Möglichkeiten, die ein breites Spektrum von Nutzern ansprechen sollen, von professionellen Content-Erstellern bis hin zu jenen, die einfach nur nach neuen Möglichkeiten suchen, ihre Ideen auszudrücken.

Insbesondere Emu Video demonstriert das Engagement des Unternehmens, die KI-gesteuerte Inhaltserstellung voranzutreiben – und könnte zu einem wichtigen Konkurrenten für bekannte Namen wie Runway und Pika Labs werden, die diesen Bereich bisher dominiert haben.

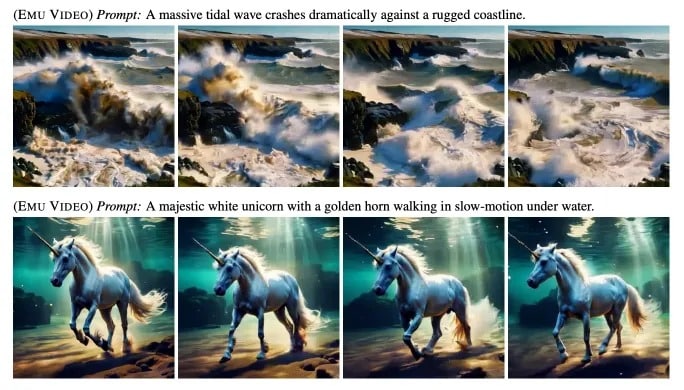

Emu Video: Text-zu-Video-Erstellung

Emu Video verwendet einen zweistufigen Prozess für die Erstellung von Videos aus Textanweisungen. Zunächst wird ein Bild auf der Grundlage des eingegebenen Textes generiert, dann ein Video, das sowohl aus dem Text als auch aus dem generierten Bild besteht. Dieser Ansatz vereinfacht den Prozess der Videoerstellung und vermeidet die komplexeren Multimodell-Methoden, die in Metas früherem Make-A-Video-Tool verwendet wurden.

Die von Emu Video erstellten Videos sind auf eine Auflösung von 512×512 Pixeln beschränkt, weisen aber eine bemerkenswerte Kohärenz mit den bereitgestellten Textanweisungen auf. Die genaue Umwandlung von Text in visuelle Erzählungen unterscheidet Emu Video von den meisten existierenden Modellen und kommerziellen Lösungen:

Obwohl die Modelle selbst nicht öffentlich zugänglich sind, können die Benutzer mit einer Reihe vorgegebener Aufforderungen experimentieren, und die Ergebnisse sind ziemlich glatt, mit minimalen Diskrepanzen zwischen den Frames.

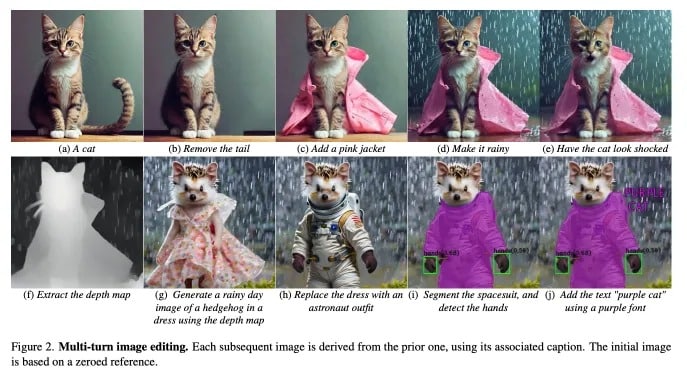

Emu Edit: Bildbearbeitung mit Inpainting

Neben Emu Video präsentierte Meta auch die Fähigkeiten von Emu Edit, einem KI-gesteuerten Tool, das verschiedene Bildbearbeitungsaufgaben auf der Grundlage der KI-Interpretation von Anweisungen in natürlicher Sprache durchführen kann. Emu Edit ermöglicht es den Benutzern, Bilder mit einem hohen Maß an Präzision und Flexibilität zu bearbeiten.

„Emu Edit [ist] ein Multitasking-Bildbearbeitungsmodell, das den neuesten Stand der Technik in der anweisungsbasierten Bildbearbeitung darstellt“, heißt es in Metas Forschungspapier für das Tool, das seine Fähigkeit unterstreicht, komplexe Bearbeitungsanweisungen präzise auszuführen.

Die Präzision von

Emu Edit wird durch die Verwendung von Diffusoren verbessert, einer fortschrittlichen KI-Technologie, die durch Stable Diffusion bekannt wurde. Dieser Ansatz stellt sicher, dass Bearbeitungen die visuelle Integrität der Originalbilder erhalten.

Metas Fokus auf die Entwicklung von KI-Tools wie Emu Video und Emu Edit verkörpert seine Strategie, Technologien zu entwickeln, die für die Schaffung des Metaverse entscheidend sind. Dazu gehört auch die Entwicklung von Meta AI, einem persönlichen Assistenten, der auf dem großen Sprachmodell LLaMA-2 basiert, und die Einführung von Multimodalität in AR-Geräten.