Po pozornym czajeniu się na uboczu przez większość ubiegłego roku, Apple zaczyna wstrząsać sytuacją w dziedzinie sztucznej inteligencji – a w szczególności sztucznej inteligencji typu open source.

Gigant technologiczny z Cupertino nawiązał współpracę z Uniwersytetem Santa Barbara w celu opracowania modelu sztucznej inteligencji, który może edytować obrazy w oparciu o język naturalny, w taki sam sposób, w jaki ludzie wchodzą w interakcję z ChatGPT. Apple nazywa to Multimodal Large-Language Model-Guided Image Editing (MGIE).

MGIE interpretuje instrukcje tekstowe dostarczane przez użytkowników, przetwarzając je i udoskonalając w celu wygenerowania precyzyjnych poleceń edycji obrazu. Integracja modelu dyfuzyjnego usprawnia ten proces, umożliwiając MGIE stosowanie zmian w oparciu o charakterystykę oryginalnego obrazu.

Multimodalne duże modele językowe (MLLM), które mogą przetwarzać zarówno tekst, jak i obrazy, stanowią podstawę metody MGIE. W przeciwieństwie do tradycyjnych, jednomodowych sztucznej inteligencji skupiających się wyłącznie na tekście lub obrazach, MLLM mogą przetwarzać złożone instrukcje i pracować w szerszym zakresie sytuacji. Przykładowo, model może zrozumieć instrukcję tekstową, przeanalizować elementy konkretnego zdjęcia, a następnie usunąć coś z obrazu i stworzyć nowy obraz bez tego elementu.

Aby wykonać te działania, system sztucznej inteligencji musi mieć różne możliwości, w tym generowanie tekstu, generowanie obrazu, segmentację i analizę CLIP, wszystko w tym samym procesie.

Wprowadzenie MGIE przybliża Apple do osiągnięcia możliwości podobnych do ChatGPT Plus OpenAI, umożliwiając użytkownikom angażowanie się w interakcje konwersacyjne z modelami AI w celu tworzenia niestandardowych obrazów na podstawie wprowadzanego tekstu. Dzięki MGIE użytkownicy mogą przekazywać szczegółowe instrukcje w języku naturalnym – „usuń pachołek drogowy z pierwszego planu” – które są tłumaczone na polecenia edycji obrazu i wykonywane.

Innymi słowy, użytkownicy mogą zacząć od zdjęcia blondynki i zmienić ją w rudowłosą, mówiąc „zrób z tej osoby rudzielca”. Pod maską model zrozumie instrukcję, posegmentuje włosy osoby, wygeneruje polecenie typu „rude włosy, bardzo szczegółowe, fotorealistyczne, rudy odcień”, a następnie wykona zmiany za pomocą malowania.

Podejście Apple jest zgodne z istniejącymi narzędziami, takimi jak Stable Diffusion, które można rozszerzyć o podstawowy interfejs do edycji obrazu sterowanej tekstem. Wykorzystując narzędzia innych firm, takie jak Pix2Pix, użytkownicy mogą wchodzić w interakcje z interfejsem Stable Diffusion za pomocą poleceń w języku naturalnym, obserwując efekty w czasie rzeczywistym na edytowanych obrazach.

Podejście Apple okazuje się jednak dokładniejsze niż jakakolwiek inna podobna metoda.

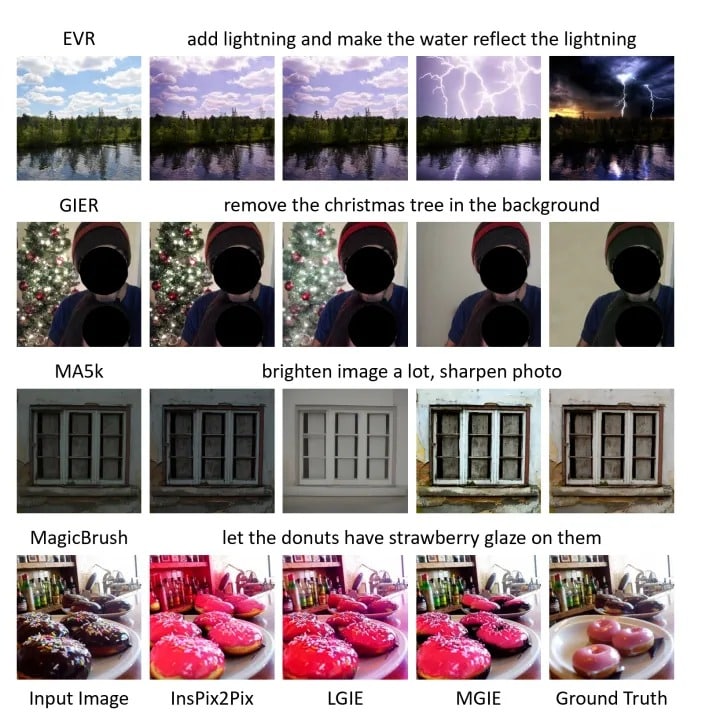

Wyniki edycji obrazu za pomocą języka naturalnego przy użyciu Instruct Pix2Pic, LGIE, Apple MGIE i Ground Truth Image: Apple

Besidesides generative AI, Apple MGIE can perform other conventional image editing tasks like color grading, resizing, rotations, style changes, and sketching.

Dlaczego Apple uczyniłoby go open source?

Apple’s open-source forays are a clear strategic move – with a scope beyond merere licensing requirements.

Aby zbudować MGIE, Apple używa modeli open-source, takich jak Llava i Vicuna. Ze względu na wymogi licencyjne tych modeli, które ograniczają komercyjne wykorzystanie przez duże podmioty korporacyjne, Apple było prawdopodobnie zmuszone do otwartego udostępniania swoich ulepszeń w serwisie GitHub.

Pozwala to jednak również Apple wykorzystać ogólnoświatową pulę programistów w celu zwiększenia swojej siły i elastyczności. Ten rodzaj współpracy posuwa sprawy do przodu znacznie szybciej niż Apple pracujące całkowicie samodzielnie i zaczynające od zera. Ponadto otwartość inspiruje szersze spektrum pomysłów i przyciąga różnorodne talenty techniczne, umożliwiając szybszy rozwój MGIE.

Zaangażowanie Apple w społeczność open-source z projektami takimi jak MGIE daje również marce impuls wśród programistów i entuzjastów technologii. Ten aspekt nie jest tajemnicą, ponieważ zarówno Meta, jak i Microsoft intensywnie inwestują w sztuczną inteligencję typu open source.

Możliwe, że wydanie MGIE jako oprogramowania open-source da Apple przewagę w ustanawianiu wciąż ewoluujących standardów branżowych w zakresie sztucznej inteligencji, a w szczególności edycji obrazu opartej na sztucznej inteligencji. Dzięki MGIE Apple prawdopodobnie dało artystom i programistom AI solidne podstawy do zbudowania kolejnej wielkiej rzeczy, zapewniając większą dokładność i wydajność niż to, co jest dostępne gdzie indziej.

MGIE z pewnością sprawi, że produkty Apple będą lepsze: nie byłoby zbyt trudno zsyntetyzować polecenie głosowe wysłane do Siri i użyć tego tekstu do edycji zdjęcia na smartfonie, komputerze lub zestawie słuchawkowym innersive użytkownika.

Doświadczeni technicznie programiści AI mogą korzystać z MGIE już teraz. Wystarczy odwiedzić repozytorium GitHub projektu.