Dans une scène technologique en plein essor dominée par des géants comme OpenAI et Google, NExT-GPT – un modèle de langage multimodal d’IA à code source ouvert – pourrait avoir ce qu’il faut pour rivaliser dans la cour des grands.

ChatGPT a pris le monde d’assaut grâce à sa capacité à comprendre les requêtes en langage naturel et à générer des réponses semblables à celles d’un être humain. Mais alors que l’IA continue de progresser à une vitesse fulgurante, les gens ont exigé plus de puissance. L’ère du texte pur est déjà révolue, et les LLM multimodaux arrivent.

Développé dans le cadre d’une collaboration entre l’université nationale de Singapour (NUS) et l’université Tsinghua, NExT-GPT peut traiter et générer des combinaisons de textes, d’images, de sons et de vidéos. Cela permet des interactions plus naturelles que les modèles uniquement textuels tels que l’outil ChatGPT de base.

L’équipe qui l’a créé présente NExT-GPT comme un système « any-to-any », c’est-à-dire qu’il peut accepter des entrées dans n’importe quelle modalité et fournir des réponses sous la forme appropriée.

Le potentiel de progrès rapide est énorme. En tant que modèle à source ouverte, NExT-GPT peut être modifié par les utilisateurs pour répondre à leurs besoins spécifiques. Cela pourrait conduire à des améliorations spectaculaires par rapport à l’original, à l’instar de ce qui s’est passé avec Stable Diffusion par rapport à sa version initiale. La démocratisation de l’accès permet aux créateurs de façonner la technologie pour qu’elle ait un impact maximal.

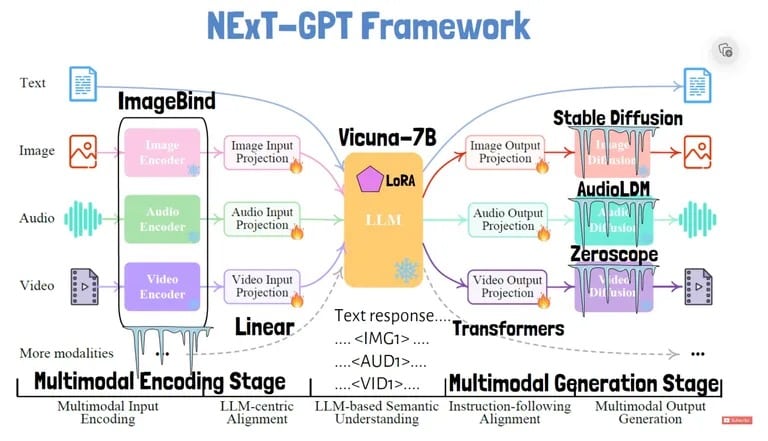

Comment fonctionne NExT-GPT ? Comme l’explique le document de recherche du modèle, le système comporte des modules distincts pour coder les entrées telles que les images et les sons en représentations textuelles que le modèle de langage principal peut traiter.

Les chercheurs ont introduit une technique appelée « modality-switching instruction tuning » pour améliorer les capacités de raisonnement multimodal, c’est-à-dire sa capacité à traiter différents types d’entrées comme une structure cohérente. Ce réglage apprend au modèle à passer de manière transparente d’une modalité à l’autre au cours d’une conversation.

Pour traiter les entrées, NExT-GPT utilise des jetons uniques, comme pour les images, l’audio et la vidéo. Chaque type d’entrée est converti en encastrements que le modèle de langage comprend. Le modèle de langage peut alors produire un texte de réponse, ainsi que des jetons de signal spéciaux pour déclencher la génération dans d’autres modalités.

Un jeton dans la réponse indique au décodeur vidéo de produire une sortie vidéo correspondante, par exemple. L’utilisation par le système de jetons adaptés à chaque modalité d’entrée et de sortie permet une conversion souple de tout à tout.

Le modèle linguistique produit ensuite des jetons spéciaux pour signaler les sorties non textuelles, comme les images, qui doivent être générées. Différents décodeurs créent alors les sorties pour chaque modalité : Stable Diffusion comme décodeur d’images, AudioLDM comme décodeur audio et Zeroscope comme décodeur vidéo. Il utilise également Vicuna comme LLM de base et ImageBind pour encoder les entrées.

NExT-GPT est essentiellement un modèle qui combine la puissance de différentes IA pour devenir une sorte de super IA tout-en-un.

Capture d’écran avec l’aimable autorisation de : AI Papers Academy via YouTube

NExT-GPT réalise cette conversion flexible « de tout à tout » en n’entraînant que 1 % de l’ensemble des paramètres. Le reste des paramètres sont des modules figés et préformés, ce qui a valu aux chercheurs les éloges d’une conception très efficace.

Un site de démonstration a été mis en place pour permettre aux utilisateurs de tester NExT-GPT, mais sa disponibilité est intermittente.

À l’heure où des géants de la technologie comme Google et OpenAI lancent leurs propres produits d’IA multimodale, NExT-GPT représente une alternative open source sur laquelle les créateurs peuvent s’appuyer. La multimodalité est la clé des interactions naturelles. En mettant NExT-GPT en open source, les chercheurs offrent un tremplin à la communauté pour faire passer l’IA au niveau supérieur.