La technologie a fait beaucoup pour faciliter les moments où l’on a la langue bien pendue et où l’on doit nommer une chanson. Grâce à l’IA, il n’est plus nécessaire de chanter ou de fredonner une chanson, il suffit d’y penser.

C’est l’avenir que les scientifiques envisagent après qu’une étude révolutionnaire a utilisé avec succès l’intelligence artificielle (IA) pour recréer de la musique simplement à partir de l’analyse de l’activité cérébrale pendant qu’ils pensaient à une chanson.

Dans un article publié dans PLOS Biology, des chercheurs dirigés par l’université de Californie à Berkeley ont réussi à générer un son reconnaissable de la chanson « Another Brick in the Wall, Part 1 » des Pink Floyd en utilisant uniquement des données cérébrales.

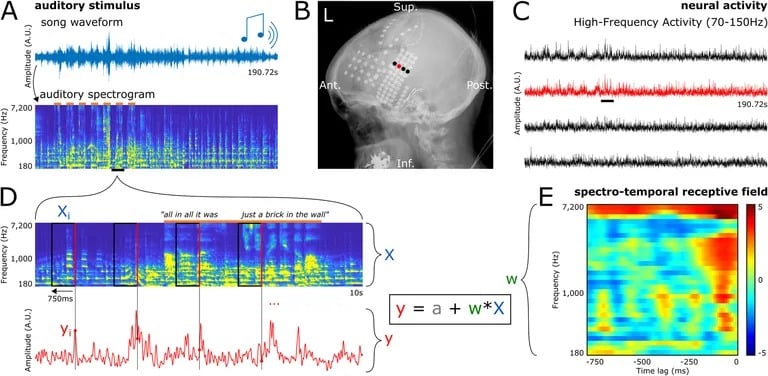

L’étude a consisté à enregistrer des signaux électriques directement à partir du cerveau de patients épileptiques déjà sous surveillance pour le traitement des crises. Pendant que les patients écoutaient passivement la chanson de rock classique, des électrodes placées à la surface de leur cerveau ont capté l’activité des régions de traitement auditif.

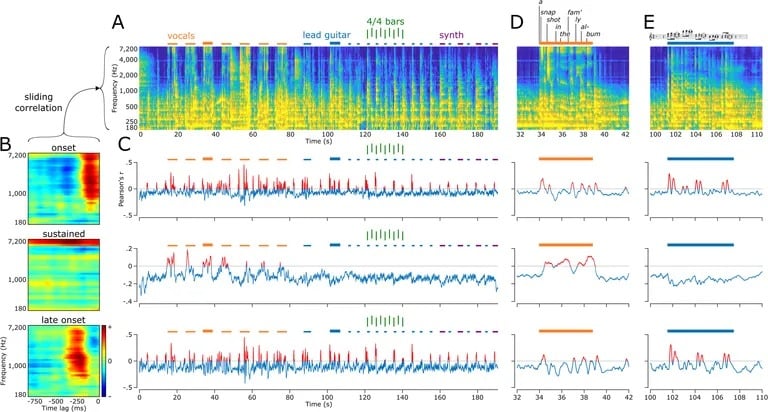

Les chercheurs ont ensuite introduit cet ensemble de données cérébrales dans des algorithmes d’apprentissage automatique. En analysant les schémas de réaction des différentes zones du cortex auditif à des éléments tels que la hauteur, le tempo, les voix et les instruments, les modèles d’IA ont appris à associer une activité neuronale spécifique à des caractéristiques acoustiques particulières.

Une fois formés à ces paires entrée-réponse, les modèles ont pu générer de nouvelles représentations spectrographiques à partir des seules données cérébrales. Les chercheurs ont ensuite converti ces visualisations en formes d’ondes, produisant un son qui, bien que brouillé, ressemblait clairement à « Another Brick in the Wall, Part 1 ».

Non seulement la mélodie et les paroles étaient identifiables, mais le décodage neuronal indiquait même quels instruments suscitaient certaines réponses dans différentes régions du cerveau. Par exemple, l’activité dans certaines parties du gyrus temporal supérieur fluctuait spécifiquement en réaction aux syllabes vocales. En revanche, d’autres régions s’activaient davantage en réponse aux motifs de guitare du rythme régulier de la chanson.

Cela démontre la capacité de décomposer un stimulus musical complexe en ses éléments constitutifs en se basant uniquement sur le traitement du cerveau. Si elle est confirmée par de futures recherches, elle représente une avancée considérable dans le décodage des pensées, les techniques précédentes se limitant à des mots ou des lettres individuels.

L’auteur principal, le Dr Robert Knight, neuroscientifique à l’université de Berkeley, a expliqué que l’équipe avait choisi la chanson de Pink Floyd en raison de son instrumentation riche et complexe. Mais l’approche pourrait être appliquée à n’importe quelle musique, ou même à la capture des propriétés mélodiques de la parole naturelle.

Les chercheurs suggèrent que cette technologie pourrait éventuellement être utilisée pour aider les patients gravement paralysés ou les victimes d’accidents vasculaires cérébraux à retrouver la capacité de parler simplement par la pensée. Des interfaces cerveau-ordinateur sont déjà en cours de développement pour décoder des mots ou des textes à partir de scanners cérébraux non invasifs. L’ajout de la dimension mélodique et prosodique permettrait de reconstruire des pensées plus complètes et des discours intentionnels.

Les chercheurs progressent depuis des années dans le domaine de la lecture de l’esprit, et l’essor de puissants modèles d’IA (et de matériel informatique) a permis de réaliser des percées majeures dans ce domaine.

Pas plus tard qu’en mai, une équipe de chercheurs a réussi à transformer des pensées en texte. « Nous avons été un peu choqués que cela fonctionne aussi bien. Cela fait 15 ans que je travaille sur ce sujet… c’était donc à la fois choquant et excitant de voir que cela fonctionnait enfin », a déclaré l’auteur principal, le Dr Alexander Huth, neuroscientifique à l’université du Texas à Austin.

Par ailleurs, TCN a récemment rapporté qu’une équipe médicale avait réussi à implanter des micropuces dans le cerveau d’un homme tétraplégique et qu’elle avait pu utiliser l’IA pour retrouver des sensations et des mouvements en « (reliant) son cerveau à son corps et à sa moelle épinière. «

Par ailleurs, Neuralink, la société d’Elon Musk, a obtenu le feu vert pour commencer les essais sur l’homme de ses implants cérébraux, afin de faire progresser ce domaine de recherche vers de nouvelles frontières. Neuralink a déjà affirmé être capable de lire les pensées d’un animal et de permettre à un singe de contrôler un ordinateur et de jouer à Pong en utilisant uniquement son cerveau.

La traduction de ces résultats en applications concrètes reste un défi. Mais les auteurs espèrent qu’avec les progrès rapides des appareils d’enregistrement et des capacités d’intelligence artificielle, leur approche pourrait un jour évoluer vers des interfaces pensée-parole qui redonneraient la parole aux personnes souffrant de troubles de l’élocution.

« Aujourd’hui, nous avons reconstitué une chanson », a déclaré Robert T. Knight, l’un des chercheurs, au Scientific American. « Demain, nous pourrons peut-être reconstituer l’intégralité de l’album de Pink Floyd.

Au-delà des utilisations cliniques, ces techniques de décodage neuronal ouvrent également des perspectives passionnantes pour l’étude de phénomènes tels que la mémoire, l’apprentissage et la créativité, en lisant littéralement les pensées avec une grande fidélité. L’étude de l’équipe de l’UC Berkeley marque un tournant, car elle nous rapproche de l’accès à la riche expérience intérieure de l’esprit.