Това беше история за корпоративен шпионаж, която дори истински сценарист не би могъл да измисли. Компанията OpenAI, която миналата година предизвика глобалната мания по изкуствения интелект, се озова в заглавията на вестниците с внезапното уволнение и евентуалното възстановяване на Сам Алтман, главен изпълнителен директор на компанията.

Дори след като Алтман се върна там, откъдето е тръгнал, остава облак от въпроси, включително какво се е случило зад кулисите.

Някои описват хаоса като битка от типа на „Наследство“ или „Игра на тронове“ по HBO. Други предполагат, че това е станало, защото Олтман е изместил фокуса си към други компании като Worldcoin.

Но най-новата и най-убедителна теория гласи, че той е бил уволнен заради едно-единствено писмо: Q.

Неназовани източници съобщиха на Ройтерс, че главният технически директор на OpenAI Мира Мурати е заявила, че голямо откритие – описано като „Q Star“ или „Q*“ – е дало тласък на хода срещу Олтман, който е бил извършен без участието на председателя на борда на директорите Грег Брокман, който впоследствие подаде оставка от OpenAI в знак на протест.

Какво, по дяволите, представлява „Q*“ и защо трябва да ни интересува? Става въпрос за най-вероятните пътища, по които може да поеме развитието на изкуствения интелект оттук нататък.

Разкриване на тайната на Q*

Загадъчният Q*, посочен от главния технически директор на OpenAI Мира Мурати, доведе до бурни спекулации в общността на ИИ. Този термин би могъл да се отнася до една от две различни теории: Q-обучение или алгоритъма Q* от Системата за опровергаване на доказателствени процедури на Мериленд (MRPPS). Разбирането на разликата между тях е от решаващо значение за разбирането на потенциалното въздействие на Q*.

Теория 1: Q-обучение

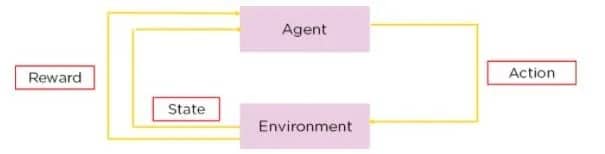

Q-обучението е вид обучение с подсилване, метод, при който ИИ се учи да взема решения чрез проби и грешки. При Q-обучението агентът се научава да взема решения, като оценява „качеството“ на комбинациите от действия и състояния.

Източник: Simplilearn

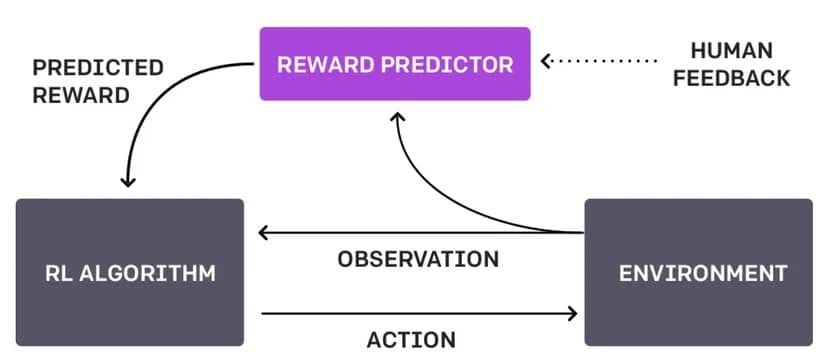

Разликата между този подход и настоящия подход на OpenAI – известен като Reinforcement Learning Through Human Feedback (Усилващо обучение чрез човешка обратна връзка) или RLHF – е, че той не разчита на човешкото взаимодействие и прави всичко сам.

Схема на RLHF. Изображение: OpenAI

Представете си робот, който се движи в лабиринт. С помощта на Q-обучение той се научава да намира най-бързия път към изхода, като опитва различни маршрути, получавайки положителни награди, определени от собствения му дизайн, когато се приближава към изхода, и отрицателни награди, когато попадне в задънена улица. С течение на времето, чрез опити и грешки, роботът разработва стратегия („Q-таблица“), която му показва най-доброто действие, което да предприеме от всяка позиция в лабиринта. Този процес е автономен, като се разчита на взаимодействието на робота с околната среда.

Ако роботът използва RLHF, вместо да открива нещата сам, човек може да се намеси, когато роботът достигне кръстопът, за да покаже дали изборът на робота е бил разумен или не.

Тази обратна връзка може да бъде под формата на директни команди („завий наляво“), предложения („опитай пътя с повече светлина“) или оценки на избора на робота („добър робот“ или „лош робот“).

В Q-обучението Q* представлява желаното състояние, в което агентът знае точно най-доброто действие, което да предприеме във всяко състояние, за да максимизира общата си очаквана награда във времето. На математически език то удовлетворява уравнението на Белман.

През май OpenAI публикуваха статия, в която се казва, че са „обучили модел да постигне ново ниво в решаването на математически задачи, като възнаграждават всяка правилна стъпка на разсъждение, вместо просто да възнаграждават правилния краен отговор“. Ако са използвали Q-обучение или подобен метод за постигане на това, това би отключило цял набор от нови проблеми и ситуации, които ChatGPT ще може да решава по естествен начин.

Теория 2: Алгоритъм Q* от MRPPS

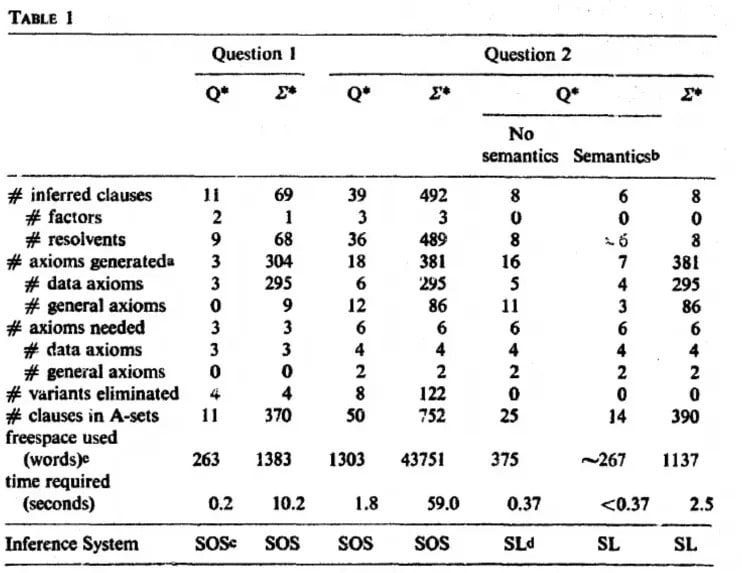

Алгоритъмът Q* е част от Системата за процедури за опровергаване на доказателства на Мериленд (MRPPS). Това е сложен метод за доказване на теореми в изкуствения интелект, особено в системите за отговаряне на въпроси.

„Алгоритъмът Q∗ генерира възли в пространството за търсене, като прилага семантична и синтактична информация, за да насочи търсенето. Семантиката позволява да се прекратяват пътища и да се изследват плодотворни пътища“, се казва в изследователския документ.

Изображение: Jack Minker

Един от начините да обясните процеса е да разгледате измисления детектив Шерлок Холмс, който се опитва да разреши сложен случай. Той събира улики (семантична информация) и ги свързва логически (синтактична информация), за да стигне до заключение. Алгоритъмът Q* работи по подобен начин в изкуствения интелект, като комбинира семантична и синтактична информация, за да се ориентира в сложни процеси на решаване на проблеми.

Това би означавало, че OpenAI е една стъпка по-близо до наличието на модел, способен да разбира своята реалност отвъд обикновените текстови подсказки и по-скоро в съответствие с измисления J.A.R.V.I.S (за GenZers) или Bat Computer (за бумърите).

Така че, докато Q-ученето е свързано с това да се научи ИИ да се учи от взаимодействието със заобикалящата го среда, Q-алгоритъмът е по-скоро за подобряване на дедуктивните способности на ИИ. Разбирането на тези различия е от ключово значение за оценяване на потенциалните последици от „Q“ на OpenAI. И двата метода имат огромен потенциал за развитие на ИИ, но техните приложения и последици се различават значително.

Всичко това, разбира се, са само спекулации, тъй като OpenAI не е обяснила концепцията и дори не е потвърдила или отрекла слуховете, че Q* – каквото и да е то – действително съществува.

Потенциални последици от „Q „*

Съобщенията за „Q*“ на OpenAI биха могли да имат огромно и разнообразно въздействие. Ако става въпрос за усъвършенствана форма на Q-учене, това може да означава скок в способността на ИИ да се учи и адаптира автономно в сложна среда, като по този начин се решават цял набор от нови проблеми. Подобен напредък би могъл да подобри приложенията на ИИ в области като автономните превозни средства, където вземането на решения за части от секундата въз основа на постоянно променящите се условия е от решаващо значение.

От друга страна, ако „Q“ се отнася до алгоритъма Q от MRPPS, това би могло да отбележи значителна стъпка напред в дедуктивното мислене и възможностите на ИИ за решаване на проблеми. Това би имало особено въздействие в области, изискващи задълбочено аналитично мислене, като например правен анализ, интерпретация на сложни данни и дори медицинска диагностика.

Независимо от точното му естество, „Q*“ потенциално представлява значителна крачка в развитието на ИИ, така че фактът, че е в основата на екзистенциалния дебат на OpenAI, звучи правдоподобно. Той би могъл да ни доближи до системи за ИИ, които са по-интуитивни, по-ефективни и способни да се справят със задачи, които понастоящем изискват високи нива на човешки опит. С подобен напредък обаче се появяват въпроси и опасения относно етиката на ИИ, безопасността и последиците от все по-мощните системи на ИИ в нашето ежедневие и в обществото като цяло.

Доброто и лошото на Q*

Потенциални ползи от Q*:

По-добро решаване на проблеми и ефективност: Ако Q* е усъвършенствана форма на Q-обучението или на алгоритъма Q*, това може да доведе до системи с изкуствен интелект, които решават по-ефективно сложни проблеми, което ще бъде от полза за сектори като здравеопазването, финансите и управлението на околната среда.

По-добро сътрудничество между хората и ИИ: ИИ с подобрени възможности за учене или дедукция би могъл да допълни работата на хората, което ще доведе до по-ефективно сътрудничество в областта на научните изследвания, иновациите и ежедневните задачи.

Напредък в автоматизацията: „Q*“ може да доведе до по-усъвършенствани технологии за автоматизация, като подобри производителността и потенциално създаде нови индустрии и възможности за работа.

Риск и опасения:

Етични въпроси и въпроси, свързани с безопасността: С усъвършенстването на системите с изкуствен интелект гарантирането на етичното и безопасното им функциониране става все по-голямо предизвикателство. Съществува риск от непреднамерени последици, особено ако действията на ИИ не са напълно съгласувани с човешките ценности.

Поверителност и сигурност: С по-напредналите ИИ ескалират опасенията за неприкосновеността на личния живот и сигурността на данните. Системите на ИИ, способни на по-дълбоко разбиране и взаимодействие с данните, могат да бъдат използвани неправомерно. И така, представете си ИИ, който се обажда на вашия романтичен партньор, когато му изневерявате, защото знае, че изневярата е лоша.

Икономически въздействия: Повишената автоматизация и възможностите на ИИ могат да доведат до изместване на работни места в определени сектори, което ще наложи обществени корекции и нови подходи към развитието на работната сила. Ако ИИ може да прави почти всичко, защо да има човешки работници?

Несъответствие на ИИ: Рискът системите на ИИ да развият цели или методи на работа, които не съответстват на човешките намерения или благосъстояние, което може да доведе до вредни резултати. Представете си робот за почистване на дома, който е обсебен от чистотата и продължава да изхвърля важните ви документи? Или пък изцяло елиминира създателите на бъркотия?

Митът за AGI

Какво място заема слуховете за Q* на OpenAI на фона на стремежа към изкуствен общ интелект (AGI) – свещения граал на изследванията на ИИ?

AGI се отнася до способността на машината да разбира, да се учи и да прилага интелигентност в различни задачи, подобно на човешките когнитивни способности. Това е форма на ИИ, която може да обобщава обучението от една област в друга, демонстрирайки истинска адаптивност и гъвкавост.

Независимо дали Q е усъвършенствана форма на Q-учене или се отнася до алгоритъма Q, важно е да се разбере, че това не е равнозначно на постигане на AGI. Макар че „Q*“ може да представлява значителна стъпка напред в специфичните възможности на ИИ, AGI обхваща по-широк спектър от умения и разбирания.

Постигането на AGI би означавало да се разработи изкуствен интелект, който може да изпълнява всяка интелектуална задача, която може да изпълни човек – недостижим крайъгълен камък.

Машината, която е постигнала Q, не осъзнава собственото си съществуване и все още не може да разсъждава отвъд границите на своите предварително обучени данни и зададени от човека алгоритми. Така че не, въпреки шума, „Q“ все още не е предвестник на нашите господари на изкуствения интелект; по-скоро прилича на умен тостер, който се е научил сам да си маже хляба.

Що се отнася до това, че изкуственият интелект ще доведе до края на цивилизацията, може би надценяваме значението си в космическата йерархия. Q* на OpenAI може да е стъпка по-близо до изкуствения интелект от нашите мечти (или кошмари), но не е съвсем AGI, който ще се замисли за смисъла на живота или за собственото си силициево съществуване.

Не забравяйте, че това е същият OpenAI, който предпазливо наблюдава своя ChatGPT като родител, който наблюдава малко дете с маркер – горд, но постоянно притеснен, че ще рисува по стените на човечеството. Макар че „Q*“ е скок, AGI остава на още една крачка разстояние, а стената на човечеството засега е в безопасност.