Ciekawość dotycząca kolejnego dużego ruchu Mety rośnie w wyścigu o dominację w sztucznej inteligencji, a wraz z lipcową premierą generatywnego modelu tekstowego Llama 2 mocno ugruntowanego na rynku, obserwatorzy sztucznej inteligencji z niecierpliwością wypatrują oznak Llamy 3

Jeśli wierzyć branżowym szeptom, gigant technologiczny może ogłosić kontynuację swojego sukcesu open source na początku 2024 roku.

Chociaż Meta oficjalnie nie potwierdziła tej plotki, Mark Zuckerberg niedawno rzucił nieco światła na przyszłość LLM (Large Language Model) Mety, zaczynając od przyznania, że Llama 3 jest w fazie rozwoju. Powiedział jednak

, że podczas gdy priorytetem jest dopracowanie Llamy 2 w coś bardziej przyjaznego dla konsumenta, nowy podstawowy model sztucznej inteligencji jest nadal na drugim planie.

„Nieustannie trenujemy różne modele” – powiedział w wywiadzie podcastowym poświęconym interfejsowi między sztuczną inteligencją a metaverse. „Wyszkoliliśmy Llamę 2 i udostępniliśmy ją jako model open source”.

Kontynuował: „Ale tak, pracujemy również nad przyszłym modelem fundacji i nie ma żadnych nowych informacji ani wiadomości na ten temat”. Nie wiem dokładnie, kiedy zostanie ukończony”.

Meta nie potwierdziła oficjalnie tej plotki, ale schemat cykli rozwojowych i znacznych inwestycji w sprzęt sugeruje, że premiera jest bliska; Llama 1 i Llama 2 trenują w sześciomiesięcznych odstępach, a jeśli ten cykl zostanie utrzymany, OpenAI GPT-4 i Llama 2 będą miały szansę na wprowadzenie na rynek. Nowa Llama 3, która jest uważana za równoważną, może zostać uruchomiona w pierwszej połowie 2024 roku.

Użytkownik Reddit llamaShill zapewnia kompleksową analizę poprzednich cykli rozwoju modeli Meta.

Stwierdza on, że rozsądne jest założenie, że szkolenie Llama 1 trwa od lipca 2022 r. do stycznia 2023 r., Llama 2 trwa do lipca 2023 r., a szkolenie Llama 3 od lipca 2023 r. do stycznia 2024 r. Te spostrzeżenia są zgodne z meta narracją nieustannego dążenia do doskonałości AI i chęci zaprezentowania kolejnej ewolucji, która może rywalizować z możliwościami GPT-4

Tymczasem fora techniczne i media społecznościowe są pełne dyskusji na temat tego, w jaki sposób ta nowa iteracja przywróci przewagę konkurencyjną meta. Społeczność techniczna układa również prawdopodobne ramy czasowe na podstawie dostępnych informacji

Co usłyszeliśmy na MetaGenAI social:

„Mamy komputery do trenowania Llamy-3 i Llamy-4, Llama-3 będzie porównywalna z GPT-4”.

„Kiedy Llama-3 będzie tak dobra jak GPT-4, czy udostępnicie ją na zasadach open source?”.

„Tak, zrobimy to.

– jason (@agikoala) 25 sierpnia 2023

’

Tymczasem partnerstwo z Dell w celu zaoferowania Llama 2 na miejscu dla użytkowników korporacyjnych jest strategicznym i aktualnym posunięciem, które pokazuje zaangażowanie firmy w zarządzanie danymi osobowymi i bezpieczeństwo. Zaangażowanie to ma kluczowe znaczenie, ponieważ Meta jest gotowa iść łeb w łeb z gigantami takimi jak OpenAI i Google.

Meta wdraża również sztuczną inteligencję w wielu swoich produktach i sensowne jest zapewnienie, że nie pozostanie w tyle za duchem czasu; Llama 2 zasila sztuczną inteligencję Meta i inne usługi, takie jak chatbot Meta, usługi generatywne Meta i okulary Meta AI.

Wśród tych wszystkich spekulacji Mark Zuckerberg wydał kilka intrygujących i enigmatycznych oświadczeń na temat Llama 3 jako open source. W niedawnym podcaście z informatykiem Rexem Friedmanem, Zuckerberg powiedział: „Potrzebujemy procesu, aby to zrobić i uczynić bezpiecznym”.

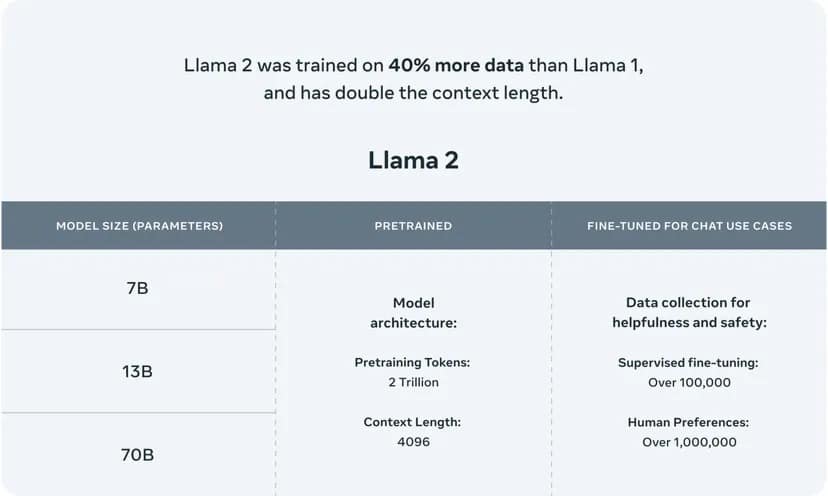

Llama 2 może pochwalić się wielowarstwową architekturą z wersjami oferującymi 7 miliardów, 13 miliardów i solidne 70 miliardów parametrów, z których każdy jest odpowiedni dla różnych poziomów złożoności i mocy obliczeniowej Parametry LLM działają jak neuronowe bloki konstrukcyjne, które definiują zdolność modelu do rozumienia i generowania języka, Liczba parametrów często koreluje z poziomem zaawansowania modelu i potencjalną jakością wyników.

Ta potężna sztuczna inteligencja została przeszkolona na ogromnym korpusie 2 bilionów tokenów, co stanowi podstawę jej zdolności do nawigacji i generowania tekstu podobnego do ludzkiego w szerokim zakresie tematów i kontekstów

Image courtesy of Meta

Częściowo wynika to z podstaw sprzętowych: jak donosi TCN, Meta przechowuje w swoim centrum danych jeden z najpotężniejszych urządzeń do treningu AI – Nvidia H100.

Jednak mimo całej ekscytacji i spekulacji, prawda pozostaje owiana zasłoną tajemnic handlowych.

Zamiary firmy Meta dotyczące konkurowania w dziedzinie sztucznej inteligencji zależą w dużej mierze od wymaganego czasu szkolenia, inwestycji w sprzęt i pytań dotyczących otwartego oprogramowania. Z drugiej strony, oczekiwania rosną, podobnie jak prawdopodobieństwo premiery Rama 3 w 2024 roku.