OpenAIは本日、テキストベースの指示を受け、長く魅力的なビデオを作成できる新しい人工知能モデル、Soraを発表した。まあ、1分の長い動画だが。

これは現在、招待された開発者のみが利用できるクローズド・ベータ版で、AIの世界的リーダーによるやや遅めの参入となる。テキストから動画への変換は、必ずしも未知の領域ではない。RunwayMLやPika Labsのような企業は、このゲームにしばらく前から参入しており、現在、数秒で見事なビジュアルを作成できるモデルでシーンを席巻している。

しかし、これらの動画は短くなりがちで、長くなればなるほどストーリーの焦点と一貫性が失われていく。

Soraによって、OpenAIは一貫性を達成し、シームレスな流れと進化が可能な、非常に詳細で分単位の動画を生成することを目指しています。AIモデルはすべてのフレームをゼロから即興で作成するため、これは単純な目標ではない。たった1フレームの小さな欠陥が、幻覚や非現実的なイメージの連鎖へと雪だるま式に広がっていくのだ。

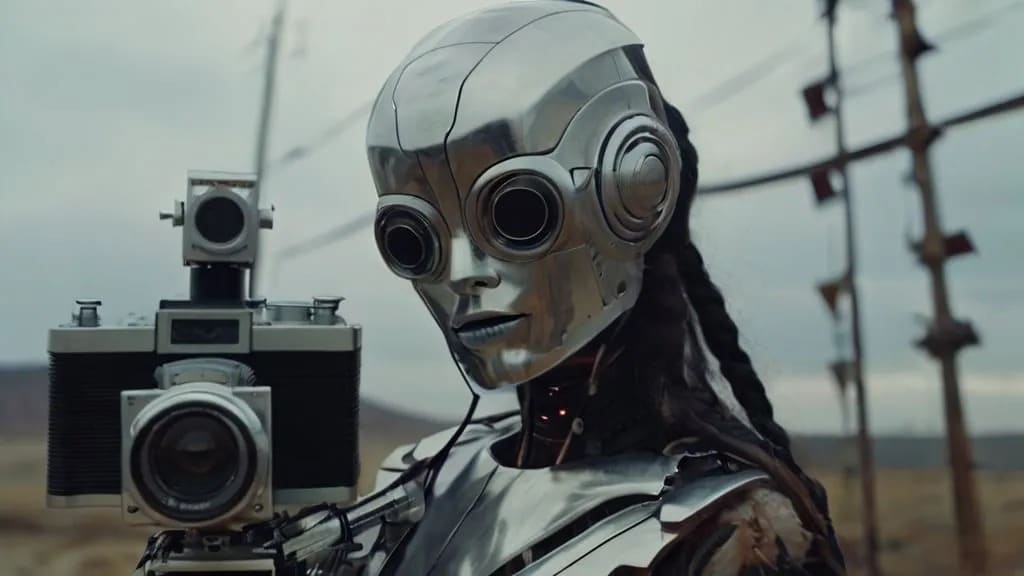

しかし、OpenAIは一歩前進したようで、Soraはスムーズで魅惑的なビジュアルを披露している。サンプル動画はOpenAIによってオンラインに投稿され、一部はYouTubeで非公式に再公開されている

。

OpenAIは、ジェネレーティブ・ビデオの水を試している他のAI企業と真っ向勝負を挑んでいる。人気のあるテキストから画像へのジェネレーターMidjourneyは最近、テキストから動画へのジェネレーターに取り組んでいると発表したが、リリース日は明らかにしていない。また、Stability AIは最近、解像度576×1024で25フレームの動画を生成できるStable Video Diffusionをオープンソースで提供し、話題を呼んだ。

Meta社も、ソーシャルメディアやメタバースにAIを組み込もうとする動きの一環として、EMUビデオ・ジェネレーターを披露している。

オープンAIが「ビジュアルアーティスト、デザイナー、映画制作者」にフィードバックを提供し、今のところ限定公開されているSoraは、言語をどのように理解するかによって差別化されている。文字で書かれたプロンプトのニュアンスを解釈しながら、鮮やかで非常に詳細な画像を生成する。特定のカメラモーションが必要か?リアルな感情を持った複数のキャラクターが必要?問題ありません。

Soraは、同じビデオ内の異なるショット間のシームレスなトランジションさえも生成する。今日YouTubeに投稿された、もうひとつの熱狂的なビデオを紹介しよう。

それでも、AIによるクリエイティビティには癖がある。ソラはまだ映画のような巨匠ではない。言い換えれば、物理学や複雑な因果関係で苦労することもあるだろうし、すでに最も安定したビデオジェネレーターの1つではあるが、絶対的な忠実度を達成しているわけではないので、幻覚も予想される。

また、OpenAIが提供するSoraは、間違いなく検閲の厳しいモデルになるだろう。同社は、潜在的に有害で誤解を招くコンテンツにフラグを立てるための安全テストと検出ツールに重点を置いていることを強調した。OpenAIはレッドチームと協力してモデルを磨き上げており、その早期リリース戦略が、今後数年間でますます安全なAIを構築するための協力につながることを期待している。

Soraの広範な実装に関する即時リリース日は発表されていない。