L’entreprise de cybersécurité Avast dénonce un outil de longue date qui a hanté des applications de rencontres populaires et qui a été amélioré par l’intelligence artificielle, acquérant ainsi la capacité de créer de faux profils et de manipuler des utilisateurs peu méfiants.

Bien qu’Avast ait donné à l’application le surnom de « LoveGPT », ce n’est pas le nom du logiciel en question. Il n’a pas non plus de lien avec plusieurs sites web et applications nommés LoveGPT, qui n’ont pas non plus les capacités qu’Avast met en avant.

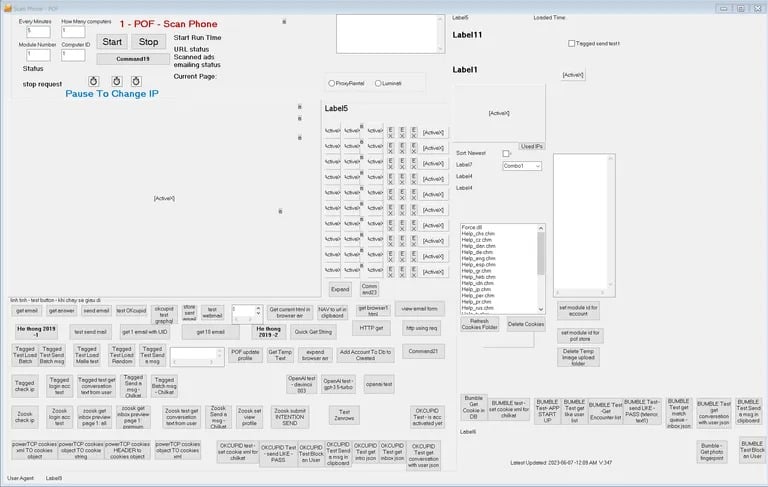

L’outil doit être installé et exécuté localement sur une machine Windows et est codé en Visual Basic, un langage de programmation de Microsoft qui existe depuis les années 1990. Malgré ses racines anciennes, l’application « LoveGPT » a évolué au fil des ans, avec des fonctions supplémentaires et des modules d’extension lui permettant d’engager – et d’escroquer – les utilisateurs de l’application de rencontres avec une compétence croissante.

« Nous avons découvert un outil qui offre de vastes fonctionnalités sur plusieurs plateformes de rencontres différentes, permettant de créer de faux comptes, d’interagir avec les victimes, de contourner les CAPTCHA, d’anonymiser l’accès à l’aide de proxys et d’outils d’anonymisation du navigateur, et bien d’autres choses encore », a indiqué Avast.

Cette application n’est pas pour les débutants. Elle nécessite une certaine expertise technique pour installer et utiliser correctement tous ses modules. Lorsqu’elle est en cours d’exécution, l’application scrute plusieurs plateformes de rencontres, se dissimule derrière des techniques d’anonymisation et interagit avec des utilisateurs peu méfiants sur différents canaux. Récemment, elle a été améliorée grâce à l’IA afin d’être encore plus efficace dans la création du profil parfait pour attirer les rencontres – et attirer les gens dans des escroqueries.

À l’heure actuelle, l’application utilise les modèles DaVinci et GPT-3.5 turbo LLM d’OpenAI pour générer ses interactions. Ces modèles sont moins sophistiqués que le GPT-4, mais ils sont aussi beaucoup moins chers.

Selon Avast, « LoveGPT » peut créer de faux profils convaincants sur au moins 13 sites de rencontres différents, tout en récupérant les photos, les textes et les données des utilisateurs. Il classe les utilisateurs par tranches d’âge, ce qui devrait faciliter la création de faux profils réalistes en vue d’une manipulation ciblée. L’outil utilise plusieurs bases de données pour stocker des détails tels que les profils, les conversations, les adresses électroniques et un journal de bord des messages générés par l’IA.

« LoveGPT » utilise des services proxy, des numéros de téléphone virtuels et des outils anti-empreintes digitales pour rester indétectable et anonyme. Il peut également contourner les CAPTCHA et envoyer des courriels à partir de faux comptes. En résumé, il dispose d’une vaste boîte à outils qu’il peut utiliser pour tromper les utilisateurs d’applications de rencontres et les piéger.

Cette révélation tombe à point nommé, d’autant plus qu’une récente enquête menée par AttractionTruth a révélé que 20 % des utilisateurs masculins d’applications de rencontres se tournent vers l’IA pour améliorer leurs perspectives de rencontres. En outre, comme TCN l’a précédemment rapporté, certaines personnes sont prêtes à payer pour des fantasmes alimentés par l’IA, car elles trouvent l’illusion personnalisée et personnalisable convaincante.

Selon la société de recherche en cybersécurité Trend Micro, les escroqueries romantiques sont une tactique courante parmi les criminels, se classant parmi les cinq principales escroqueries de 2023. Même si les outils d’IA comme « LoveGPT » progressent dans le monde de la tromperie en ligne, ce sont toujours les escroqueries à la crypto-monnaie à l’ancienne qui tiennent le haut du pavé. Ces tromperies sur les monnaies numériques sont devenues les plus rentables de l’année, malgré la nature volatile et spéculative des marchés des crypto-monnaies.

OpenAI n’a pas répondu à une demande de commentaire de TCN. Mais il convient de noter que l’année dernière, l’entreprise a introduit un outil de modération pour aider les développeurs à contrer l’utilisation abusive de vastes modèles de langage tels que ChatGPT. Alors que les célibataires en mal d’amour font appel à l’IA pour les aider à flirter et que les escrocs utilisent l’IA pour les tromper, les utilisateurs d’applications de rencontres seraient bien avisés de se méfier des Casanovas artificielles et numériques. La confiance et l’authenticité pourraient bien devenir l’aphrodisiaque ultime.