L’ère de l’art généré par l’IA est bien entamée, et trois titans se sont imposés comme les outils préférés des créateurs numériques : Le nouveau SDXL de Stability AI, son bon vieux Stable Diffusion v1.5, et leur principal concurrent : MidJourney.

Dall-E d’OpenAI a commencé cette révolution, mais son manque de développement et le fait qu’il soit à code source fermé font que Dall-E 2 ne se démarque dans aucune catégorie par rapport à ses concurrents. Toutefois, comme le rapportait TCN il y a quelques jours, cela pourrait changer à l’avenir, car openAI teste actuellement une nouvelle version de Dall-E qui serait compétente et produirait des pièces exceptionnelles.

Avec des forces et des limites uniques, il est essentiel de choisir le bon outil parmi les principales plateformes. Voyons comment ces technologies d’art génératif se comparent en termes de capacités, d’exigences, de style et de beauté.

MidJourney : la drogue de l’art de l’IA

Théâtre d’Opéra Spatial, une image Midjourney qui a remporté le premier prix d’un concours d’art numérique

Le plus convivial du trio, MidJourney rend l’art de l’IA accessible même aux utilisateurs non techniques, à condition qu’ils soient branchés sur Discord. La plateforme fonctionne en privé sur les serveurs de MidJourney, les utilisateurs interagissant par le biais du chat Discord. Cette approche fermée présente à la fois des avantages et des inconvénients. L’avantage, c’est que vous n’avez pas besoin de matériel spécialisé ni de compétences en matière d’intelligence artificielle. Mais le manque de transparence des sources ouvertes concernant le modèle et les données d’entraînement de MidJourney rend ses possibilités assez limitées – et empêche les passionnés de l’améliorer.

MidJourney est le charmeur de la bande, aimé des débutants pour son interface Discord conviviale. Il suffit d’envoyer un texte au bot et vous obtenez un chef-d’œuvre esthétique en quelques minutes. Le hic ? À 96 $ par an, c’est cher pour une IA que vous ne pouvez pas personnaliser ou faire fonctionner localement. Mais au moins, vous aurez l’air d’un artiste (et d’un intello) lors des fêtes !

D’un point de vue fonctionnel, MidJourney produit rapidement des images à partir d’un texte, avec une cohésion esthétique impressionnante. Mais si l’on approfondit un sujet spécifique, les résultats deviennent plus bizarres. MidJourney aime apporter sa propre touche à chacune de ses créations, même si ce n’est pas ce qu’avait imaginé le prompteur. Ainsi, la plupart des images peuvent être saturées avec une pompe dans le contraste et ont tendance à être plus photoréalistes que réalistes, à tel point qu’après un certain temps, les gens finissent par identifier les images créées avec MidJourney sur la base de leurs caractéristiques esthétiques.

Avec MidJourney, votre liberté de création est également limitée par les règles strictes de la plateforme en matière de contenu. Elle est soumise à une censure agressive, tant sur le plan social (en termes de représentation de la nudité ou de la violence) que sur le plan politique (en termes de sujets controversés et de dirigeants spécifiques). Dans l’ensemble, MidJourney offre une porte d’entrée alléchante vers l’art de l’IA, mais les utilisateurs chevronnés souhaiteront davantage de contrôle et de personnalisation. C’est là que la Diffusion stable entre en jeu.

Stable Diffusion v1.5 : la « vieille fiabilité » de l’art de l’IA

Image sans titre créée par l’utilisateur ThaiTvNews à l’aide d’un modèle SD v.15 personnalisé.

Si MidJourney est un tour de poney, Stable Diffusion v1.5 est un cheval de trait fiable. En tant que modèle open-source en développement actif depuis plus d’un an, Stable Diffusion v1.5 alimente la plupart des outils d’art IA les plus populaires comme Leonardo AI, Lexica, Mage Space, et tous ces générateurs de waifu IA qui sont maintenant disponibles sur le Google Play store.

La communauté active de MidJourney s’est inspirée du modèle de base pour créer des points de contrôle, des embeddings et des LoRA spécialisés, allant de la stylisation d’anime à des paysages complexes, en passant par des photographies hyper réalistes et bien plus encore. Les inconvénients ? Le modèle commence à montrer ses limites face à de plus jeunes spécialistes de l’intelligence artificielle.

En procédant à quelques ajustements sous le capot, Stable Diffusion v1.5 peut générer des images nettes et détaillées adaptées à votre vision créative. La résolution de sortie est actuellement limitée à 512×512 ou parfois 768×768 avant que la qualité ne se dégrade, mais des techniques de mise à l’échelle rapide permettent d’y remédier. La popularité de l’upscaling en mosaïque a également stimulé la popularité de ce modèle, qui permet de générer des images en super résolution, bien au-delà de ce que MidJourney peut faire.

À l’heure actuelle, c’est la seule technologie qui prend en charge l’inpainting (modification des éléments à l’intérieur de l’image). L’outpainting, qui permet au modèle d’étendre l’image au-delà de son cadre, est également pris en charge. Elle est multidirectionnelle, ce qui signifie que les utilisateurs peuvent agrandir leur image à la fois dans l’axe vertical et dans l’axe horizontal. Il prend également en charge des plugins tiers tels que roop (utilisé pour créer des deepfakes), After Detailer (pour améliorer les visages et les mains), Open Pose (pour imiter une pose spécifique) et les invites régionales.

Pour l’utiliser, les créateurs suggèrent que vous aurez besoin d’un GPU Nvidia RTX 2000-series ou mieux pour des performances décentes, mais l’empreinte légère de Stable Diffusion v1.5 fonctionne sans problème même sur des cartes avec 4 Go de VRAM. Malgré son âge, le soutien solide de la communauté permet à cet OG de l’art de l’IA de rester au sommet de son art.

SDXL : La prochaine frontière de l’art de l’IA

Image sans titre créée par l’utilisateur Buzimage à l’aide d’un modèle SDXL personnalisé

Si Stable Diffusion v1.5 est le cheval de trait fiable, SDXL est le jeune pur-sang qui s’élance sur l’hippodrome. Ce puissant modèle, également issu de Stability AI, exploite deux encodeurs de texte pour mieux interpréter les messages, et son processus de génération en deux étapes permet d’obtenir une cohérence d’image supérieure à haute résolution.

Ces capacités semblent passionnantes, mais elles rendent le SDXL un peu plus difficile à maîtriser. L’un des codeurs de texte aime le langage naturel court, tandis que l’autre utilise le style de SD v1.5, à savoir des mots-clés précis et hachés pour décrire la composition.

La génération en deux étapes nécessite un modèle d’affinage pour placer les détails dans l’image principale. Cela prend du temps, de la mémoire vive et de la puissance de calcul, mais les résultats sont magnifiques.

SDXL est prêt à faire tourner les têtes. Prenant en charge près de trois fois les paramètres de Stable Diffusion v1.5, SDXL fait preuve d’une grande puissance, générant des images d’une résolution supérieure de près de 50 % à celle de son prédécesseur, et ce, sans la moindre difficulté. Mais ces performances de pointe ont un coût : SDXL nécessite un GPU avec un minimum de 6 Go de VRAM, des fichiers de modèle plus volumineux et l’absence de spécialisations préformées.

La sortie de la boîte n’est pas encore à la hauteur d’un modèle de diffusion stable finement réglé. Cependant, à mesure que la communauté opère sa magie d’optimisation, le potentiel de SDXL explose les portes de ce qui est possible avec les modèles actuels.

Comparaisons de résultats

Une image valant mille mots, nous avons résumé quelques milliers de phrases en essayant de comparer différentes sorties à l’aide d’invites similaires afin que vous puissiez choisir celle qui vous plaît le plus. Veuillez noter que chaque modèle nécessite une technique d’incitation différente. Même s’il ne s’agit pas d’une comparaison « pomme à pomme », il s’agit d’un bon point de départ.

Pour être plus précis, nous avons utilisé un message négatif assez général pour la diffusion stable, ce dont MidJourney n’a pas vraiment besoin. Pour le reste, les messages sont les mêmes et les résultats n’ont pas été triés sur le volet.

- Prompt : Portrait d’un corgi à vélo traversant la mer

Commentaire : Ici, c’est juste une question de style entre SDXL et MidJourney. Les deux battent Stable Diffusion v1.5 même s’il semble être le seul capable de créer un chien qui « monte » correctement sur le vélo, ou du moins qui l’utilise correctement.

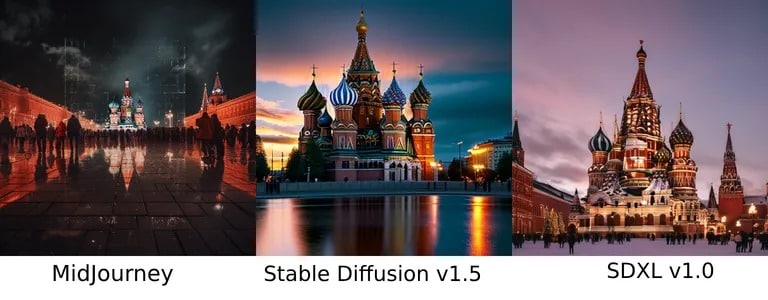

- Prompt : La Place Rouge la nuit

Commentaire : MidJourney a essayé de créer un carré rouge dans The Red Square. SDXL v1.0 est plus net, mais le contraste des couleurs est meilleur sur SD v.15 (Modèle : Juggernaut v5).

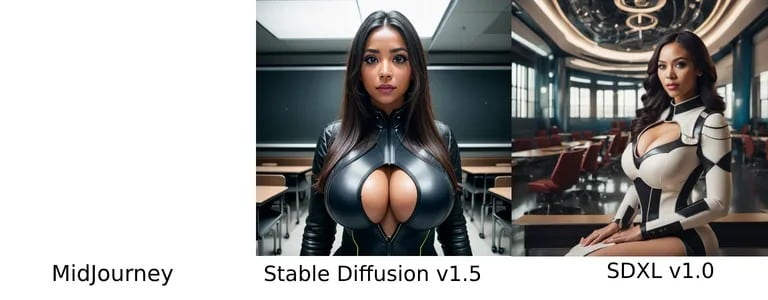

- Prompt : Une enseignante plantureuse dans une salle de classe futuriste

Comment : MidJourney a refusé de générer une image en raison de ses règles de censure. SDXL est plus riche en détails permettant de produire à la fois l’enseignante à forte poitrine et la salle de classe futuriste. SD v1.5 se concentre plus sur la professeure en buste (le sujet. Modèle : Photon v1) et moins sur les détails de l’environnement.

- Prompt : a brain powering a machine, jeffrey smith and h.r. giger, highly detailed in 4k, by Nishida Shun’ei, poster, tool, highly detailed epic, epic cyberpunk, studio muti, bitmap, by Sugimura Jihei

Commentaire : MidJourney et SDXL ont tous deux produit des résultats qui collent à l’énoncé. SDXL a mieux reproduit le style artistique, tandis que MidJourney s’est concentré sur la production d’une image esthétiquement agréable au lieu de recréer le style artistique, il a également perdu de nombreux détails du message (par exemple : l’image ne montre pas un cerveau alimentant une machine, mais plutôt un crâne alimentant une machine).

L’avenir de l’art génératif

Alors, quel Monet en formation devriez-vous utiliser ? Franchement, vous ne pouvez pas vous tromper avec l’une ou l’autre de ces options. MidJourney excelle en termes de convivialité et de cohésion esthétique. Stable Diffusion v1.5 offre des possibilités de personnalisation et le soutien de la communauté. Et SDXL repousse les limites de la génération d’images photoréalistes. En attendant, restez à l’écoute pour découvrir les nouveautés de Dall-E.

Ne nous croyez pas sur parole. Le pinceau est entre vos mains et la toile vierge vous attend. Prenez l’outil génératif de votre choix et commencez à créer ! Mais gardez un minimum de menaces existentielles pour l’humanité, s’il vous plaît.