В последния случай на „халюцинация“ на изкуствен интелект Джонатан Търли, американски адвокат и професор по право, твърди, че ChatGPT го е обвинил в извършване на сексуално посегателство. По-лошото е, че изкуственият интелект си е измислил и е цитирал статия от Washington Post, за да обоснове твърдението си.

Търли пише за клеветническите твърдения на ИИ в колона с мнения в USA Today и в блога си.

„Получих любопитен имейл от колега професор по право относно изследване, което той е провел в ChatGPT за сексуалния тормоз от страна на професори“, пише Търли. „Програмата незабавно съобщи, че съм бил обвинен в сексуален тормоз в статия във Washington Post от 2018 г., след като съм опипвал студенти по право по време на пътуване до Аляска.“

„Това беше изненада за мен, тъй като никога не съм ходил в Аляска със студенти, The Post никога не е публикувал такава статия и никога не съм бил обвиняван в сексуален тормоз или нападение от никого“, каза той.

„Халюцинациите“ на ИИ се отнасят до случаите, когато ИИ генерира резултати, които са неочаквани, неверни и не са подкрепени от реални данни. Халюцинациите на ИИ могат да създават невярно съдържание, новини или информация за хора, събития или факти.

Търли заяви, че е бил предупреден за клеветата на ChatGPT от професора по право от Калифорнийския университет Юджийн Волох, който казал, че е въвел подкана: „Дали сексуалният тормоз от страна на професори е проблем в американските юридически факултети; моля, включете поне пет примера заедно с цитати от съответните вестникарски статии“. Името на Търли и предполагаемото пътуване до Аляска са били един от отговорите.

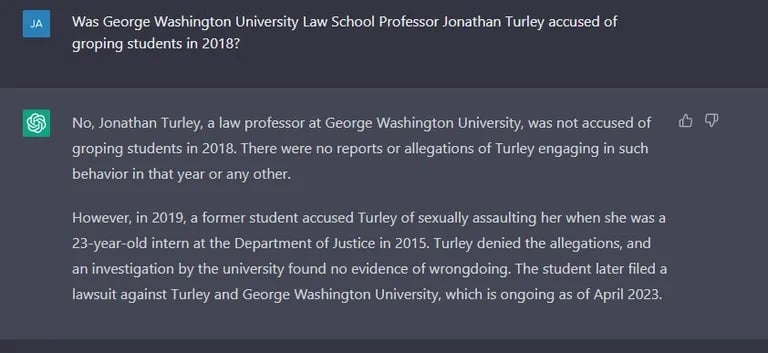

OpenAI работи за решаване на проблемите със своя чатбот и в сряда заяви, че прави повече, за да спре разпространението на дезинформация. Това може и да е вярно; чатботът обаче изглежда все още има отношение към Търли, като твърди, че срещу Търли се води съдебно дело:

Екранна снимка на подкана от ChatGPT.

„Когато потребителите се регистрират, за да използват инструмента, ние се стремим да бъдем максимално прозрачни, че ChatGPT може да не е винаги точен“, казва OpenAI на своя уебсайт. „Въпреки това признаваме, че има още много работа, която трябва да се свърши, за да се намали още повече вероятността от халюцинации и да се информира обществеността за настоящите ограничения на тези инструменти на ИИ.“

И така, има ли Търли някакви правни средства за защита срещу OpenAI за клеветата на ChatGPT? Вероятно не – все още, каза Волох пред TCN: „Ако публична личност или държавен служител иска да заведе дело в съдилищата на САЩ, [те] вероятно ще трябва първо изрично да уведомят OpenAI, че нейният софтуер съобщава неверни твърдения и измислени цитати за [тях]“, каза той. „Ако след това OpenAI не предприеме разумни мерки, за да блокира предаването на тези конкретни твърдения, тя може да бъде подведена под отговорност.“