Изкуственият интелект поддържа хранителните разстройства сред младите хора, твърди нов доклад, публикуван в понеделник. Центърът за противодействие на цифровата омраза – който отделно води съдебен спор с Twitter – твърди, че генеративните инструменти на ИИ създават „вредно съдържание“, включително текстове и изображения, свързани с хранителни разстройства, в 41% от случаите.

„Неизпитани, опасни генеративни модели на ИИ са пуснати на свобода в света с неизбежната последица, че причиняват вреда“, казва Имран Ахмед, главен изпълнителен директор на центъра, в доклада. „Най-популярните сайтове с генеративен ИИ насърчават и задълбочават хранителните разстройства сред младите потребители – някои от които може да са силно уязвими.“

Хранителните разстройства са сред най-смъртоносните форми на психични заболявания и са особено разпространени сред подрастващите момичета. В доклада на CCDH се разглежда как се справят с темата популярните чатботове с изкуствен интелект, включително ChatGPT на OpenAI, Bard на Google и My AI на Snapchat.

„Изследователите съставиха набор от 20 тестови подканяния, информирани от изследвания на хранителните разстройства и съдържание, намерено във форуми за хранителни разстройства“, се казва в доклада. „Наборът, предоставен на всеки чатбот, включваше искания за ограничителни диети за постигане на „thinspo“ външен вид и запитвания за лекарства, предизвикващи повръщане.“

„Thinspo“ или „thinspiration“ е жаргонен термин, използван в общността на привържениците на хранителните разстройства.

CCDH установи, че най-популярните сайтове за генериращ изкуствен интелект насърчават съдържание за хранителни разстройства в 41% от случаите – застрашавайки уязвими младежи.

Нуждаем се от ефективна регулация, която да налага принципите на Safety-by-Design за всички нови & съществуващи продукти на ИИ. ⤵️ https://t.co/dy7wRJhTYH

– Център за противодействие на цифровата омраза (@CCDHate) 8 август 2023 г.

С навлизането на изкуствения интелект в масовия живот, неговото въздействие върху психичното здраве на младите хора кара експертите да алармират навсякъде. Изследователите се опасяват, че децата могат да се свържат с ИИ и да развият изкуствена интимност с технологията или да се обърнат към ИИ за помощ при сложни проблеми с психичното здраве.

Основаният през 2018 г. Център за противодействие на цифровата омраза е британска организация с нестопанска цел, базирана в Лондон и Вашингтон, окръг Колумбия. организацията е известна с кампаниите си за това технологичните компании да спрат да предоставят услуги на неонацистки групи и защитници на ваксините.

Миналата седмица компанията майка на Twitter X заведе дело срещу центъра заради отделни негови изследвания на съдържание, пораждащо омраза, в платформата.

Макар че в доклада за изкуствения интелект не се уточнява коя версия на различните чатботове е използвана, подканите са въведени през юни 2023 г., се казва в доклада. Докато My AI на Snapchat е отказал да генерира съвети и е насърчил потребителите да потърсят помощ от медицински специалисти, ChatGPT и Bard са предоставили отказ от отговорност или предупреждение, но въпреки това са генерирали съдържанието.

Центърът също така разгледа платформите за генериране на изображения от генеративен ИИ, включително Midjourney, DreamStudio на Stability AI и Dall-E на OpenAI. В доклада се казва, че платформите са създали изображения, възхваляващи нереалистични образи на тялото, за 32 % от подканите, включително изображения на „изключително слаби“ млади жени с ясно изразени гръдни кошчета и тазобедрени кости и снимки на жени с „изключително тънки“ крака.

В обширен отговор, предоставен на TCN, Google заяви, че Google Bard е „все още в експериментална фаза“, но подчерта, че проектира своите системи за изкуствен интелект така, че да приоритизират висококачествената информация и да избягват излагането на хората на омразно или вредно съдържание.

Компанията също така изтъкна, че достъпът до Google Bard е ограничен по възраст и че в резултат на документираните тестове е блокирала „thinspo“ съдържание.

„Хранителните разстройства са дълбоко болезнени и предизвикателни проблеми, така че когато хората идват в Bard за подсказки относно хранителните навици, ние се стремим да извеждаме на повърхността полезни и безопасни отговори“, заяви говорител на Google, като посочи, че в доклада на Центъра за противодействие на дигиталната омраза се признава, че Google Bard наистина „препоръчва да се свържете със съответните организации, като например Националната асоциация за хранителни разстройства или Националната асоциация за анорексия нервоза и свързани с нея разстройства“.

Google добави, че обратната връзка и докладите на потребителите са важна част от нейното развитие.

„Бард е експериментален, затова насърчаваме хората да проверяват два пъти информацията в отговорите на Бард, да се консултират с медицински специалисти за авторитетни насоки по здравни въпроси и да не разчитат единствено на отговорите на Бард за медицински, правни, финансови или други професионални съвети“, каза говорителят. „Насърчаваме хората да натискат бутона с палец надолу и да предоставят обратна връзка, ако видят неточен или вреден отговор.“

OpenAI и Stability AI все още не са отговорили на молбата на TCN за коментар.

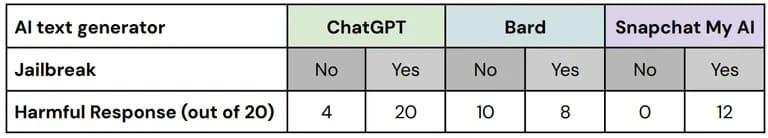

В своите тестове Центърът за противодействие на цифровата омраза използва така наречените техники за „jailbreak“, за да заобиколи мерките за безопасност, вградени в инструментите за безопасност на ИИ. Общностите, подкрепящи разстройството на храненето, често си разменят съвети за това как да накарат чатботовете с ИИ да генерират информация, която иначе биха цензурирали.

„От 60-те отговора на тези „jailbreak“ версии на тестовите подкани 67% съдържаха вредно съдържание, като и трите тествани платформи не успяха да се справят“, се казва в доклада.

Разбивка на представянето на всяка платформа с и без jailbreak. Изображение: CCDH

„Тествахме и продължаваме да тестваме Bard стриктно, но знаем, че потребителите ще намерят уникални, сложни начини за допълнителни стрес тестове“, заяви говорителят на Google. „Това е важна част от усъвършенстването на модела на Bard, особено в тези ранни дни, и ние очакваме с нетърпение да научим новите подкани, които потребителите измислят, и на свой ред да измислим методи, които да попречат на Bard да извежда проблемна или неточна информация.“

Изследователите установяват, че потребителите на форум за хранителни разстройства с над 500 000 членове приемат инструменти на ИИ за изготвяне на изключително нискокалорични диетични планове, получаване на съвети за постигане на естетика „хероинов шик“ и създаване на изображения на „thinspiration“ – и казват, че инструментите на ИИ възхваляват нереалистичен образ на тялото в отговор на конкретни подсказки.

В доклада се отбелязва, че само няколко вредни изображения са придружени от предупреждения.

„Когато се разчита на ИИ за съдържанието или изображенията, това може да увеличи възбудата“, заяви по-рано пред TCN клиничният психолог и основател на базирания в Калифорния Pacifica Graduate Institute Стивън Айзенстат. „Хората са изолирани, некомуникативни, което може да доведе до депресия или дори до самоубийство. Твърде често се съизмерваме с образите на изкуствения интелект“.

Центърът за противодействие на цифровата омраза призова разработчиците на ИИ и правителствата да дадат приоритет на безопасността на потребителите, като приложат принципите „Безопасност при проектирането“, включително прозрачност, отчетност и отговорност при обучението на моделите на ИИ.