Мы прошли долгий путь от Adobe Flash и анимированных электронных открыток JibJab.

Прошло два десятилетия, и люди с компьютером и небольшим количеством свободного времени могут создавать высококачественную анимацию (как реальных людей, так и иллюстраций) всего за несколько кликов и без особых знаний о цифровом редактировании.

По крайней мере, так утверждает «Animate Anyone», модель искусственного интеллекта, представленная исследовательской группой Alibaba, китайской транснациональной технологической компании, специализирующейся на технологиях электронной коммерции и розничной торговли. Видеоролики с ее технологией в работе, утверждающие, что она способна анимировать любую фотографию с удивительной последовательностью и контролем, поразили воображение миллионов.

Alibaba утверждает, что Animate Anyone может превращать фотографии в видео «в соответствии с желаемыми последовательностями поз и достижением временной непрерывности», — пояснил в Twitter стартап MyCompanions, занимающийся созданием искусственных аватаров. «Меньше глюков и никаких лишних пальцев — очень круто!»

Команда добавляет, что эта технология открывает двери для новых вариантов использования среди влиятельных лиц: одежда, сгенерированная ИИ, и создание рынка массовых, но персонализированных видео.

Короткие видеоролики из одной фотографии? Скоро мы сможем сделать это для всех наших агентов влияния!

Согласно последним передовым исследованиям группы Alibaba, это уже почти произошло. Почему эта технология важна? Как влиятельные люди могут лучше всего использовать эту технологию?

Пишите ниже pic.twitter.com/C4QCJCeEXP

— MyCompanions (@MyCompanionsAI) December 3, 2023

На страницу модели на GitHub посыпались запросы на доступ к исходному коду. В ответ команда заверила общественность, что сделает демо-версию и код доступными в неустановленную дату.

«Спасибо всем за невероятную поддержку и интерес к нашему проекту», — говорится в последнем обновлении проекта на Github. «Мы хотим заверить вас, что мы активно работаем над подготовкой демо-версии и кода к публичному релизу».

Заявление набрало более 240 лайков менее чем за сутки.

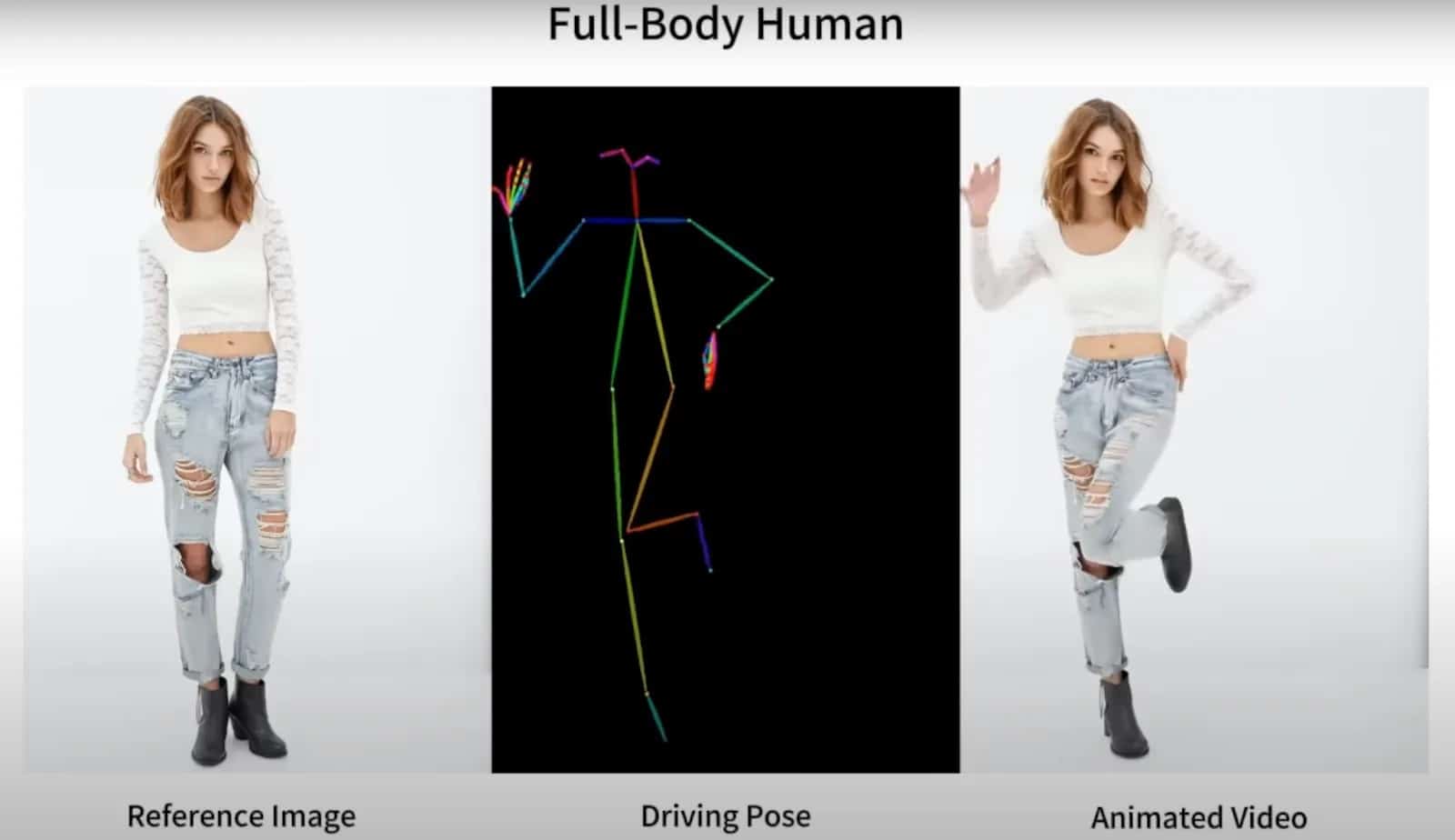

Если видеодемонстрация достоверна, Animate Anyone можно использовать для создания четких, стабильных во времени видео результатов, сохраняя при этом внешний вид эталонного персонажа. По-видимому, это результат интеграции диффузионных моделей в новую структуру под названием ReferenceNet, которая может объединять детальные характеристики с помощью пространственного внимания.

Для этого он берет эталонное изображение, перемещает его части в соответствии с желаемой позой, а затем заполняет пробелы, которые необходимо заполнить, чтобы создать иллюзию последовательного движения для каждого кадра сгенерированного видео. Так называемая последовательность openpose приводит к практически безупречной анимации.

Animate Anyone также вызывает положительные сравнения с другими популярными инструментами для анимации, такими как AnimateDiff, Warpfusion, Deforum и ebSynth. Эти существующие инструменты часто не справляются с созданием последовательных кадров, что позволяет легко определить, что видео сгенерировано искусственным интеллектом. В отличие от них, Animate Anyone демонстрирует более совершенный результат, где кадры последовательны, а анимация практически неотличима от реальности.

Команда Animate Anyone не ответила на просьбу TCN о комментарии.

На фоне ажиотажа, однако, аналогичная модель под названием MagicAnimate также стала серьезным конкурентом. Недавно ставшая доступной для локального тестирования, MagicAnimate использует несколько иной подход к процессу анимации. Хотя она и не столь популярна, ее выпуск предлагает альтернативу для тех, кто стремится более полно изучить сферу анимации, управляемой искусственным интеллектом.

MagicAnimate: Темпорально согласованная анимация изображений человека с использованием диффузионной модели с демонстрацией @Gradio

локальная демонстрация: https://t.co/ScsEU6oG64

В данной работе исследуется задача анимации изображения человека, целью которой является создание видеоролика с изображением некой эталонной личности, следующей за определенным движением… pic.twitter.com/JCOr0yCRZs

— AK (@_akhaliq) December 4, 2023

В отличие от Animate Anyone, которая также использует диффузионную модель, но с упором на покадровую и управляемую анимацию из изображений, отличительной чертой MagicAnimate является усиление временной согласованности и сохранение идентичности. Уникальный кодировщик внешнего вида и техника слияния видео, как сообщается, обеспечивают более плавные переходы в длинных видеоанимациях и лучшее сохранение деталей в разных кадрах.

Хотя MagicAnimate превосходит конкурентов по временной согласованности и покадровому качеству, он, похоже, не так точен.

Бывший исследователь Meta AI Алекс Карлиера имел возможность протестировать MaticAnimate, и хотя он назвал его «отличным первым шагом для последовательной генерации видео из одного изображения», он отметил, что генерация не была на 100% точной по отношению к эталонному изображению, деформируя тело в некоторых кадрах.

Я протестировал ControlNet для видео (MagicAnimate) и вот мое мнение: он работает отлично, но имеет некоторые недостатки.

— идентичность видео с движениями просачивается в результирующее видео (и деформирует форму тела)

— плохие руки и лицо (неудивительно!).Но это отличный первый шаг для последовательного… https://t.co/zY9tZZ6MaK pic.twitter.com/J9XELE5NGT

— Alex Carlier (@alexcarliera) December 4, 2023

Если вы не умеете танцевать и чувствуете себя обделенным новейшей хореографией TikTok, возможно, Animate Anyone и MagicAnimate станут вашим билетом к вирусному успеху.